[ad_1]

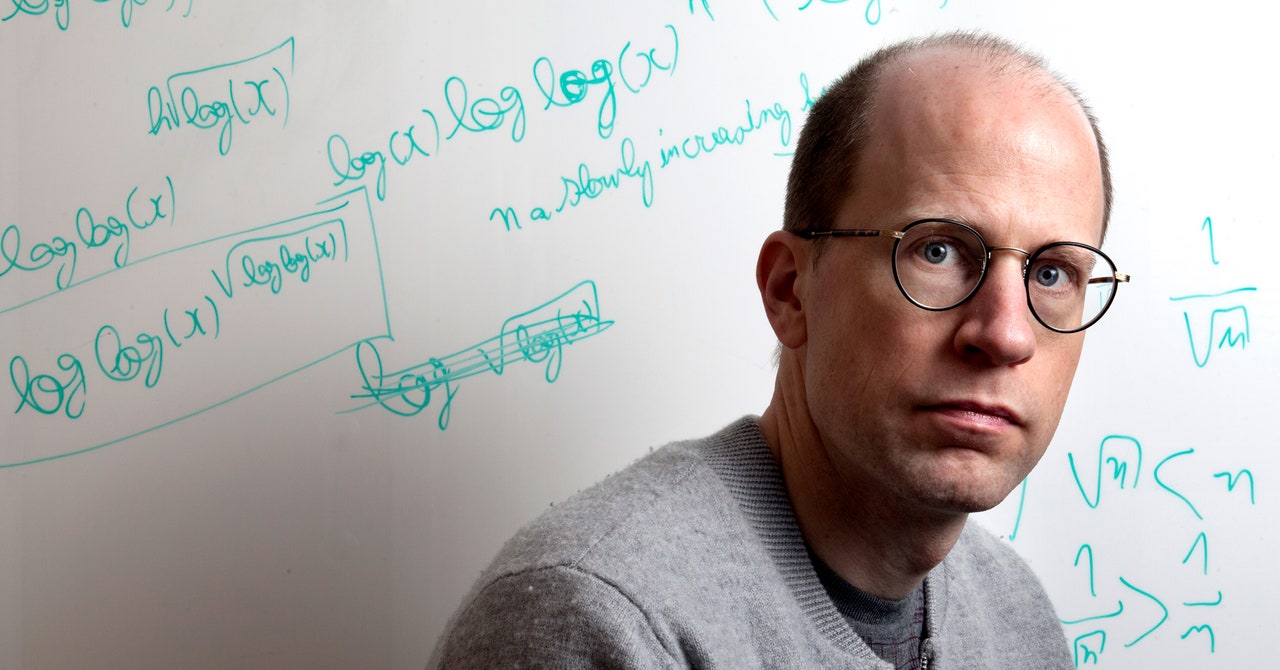

El filósofo Nick Bostrom está sorprendentemente alegre para alguien que ha pasado tanto tiempo pensando en cómo la humanidad podría destruirse a sí misma. En las fotografías, a menudo parece tremendamente serio, tal vez apropiadamente atormentado por los peligros existenciales que se arremolinan alrededor de su cerebro. Cuando hablamos por Zoom, se le ve relajado y sonriente.

Bostrom se ha dedicado a pensar en los avances tecnológicos distantes y los riesgos existenciales para la humanidad. Con la publicación de su último libro Superinteligencia: caminos, peligros, estrategias.En 2014, Bostrom llamó la atención del público sobre lo que entonces era una idea marginal: que la IA avanzaría hasta el punto en que podría volverse contra la humanidad y eliminarla.

Para muchos dentro y fuera de la investigación de la IA, la idea parecía fantasiosa pero influyente. incluido Elon Musk citó los escritos de Bostrom. El libro desató una serie de preocupaciones apocalípticas sobre la IA en ebullición que estallaron recientemente tras el lanzamiento de ChatGPT. La preocupación por el riesgo de la IA no sólo es generalizada, sino también un problema en los círculos políticos gubernamentales de IA.

El nuevo libro de Bostrom adopta un enfoque completamente diferente. En lugar de tocar los éxitos fatales, Utopía profunda: vida y significado en un mundo disuelto, considera un futuro en el que la humanidad haya desarrollado con éxito máquinas superinteligentes pero haya evitado una catástrofe. Todas las enfermedades son erradicadas y la gente puede vivir en infinita abundancia indefinidamente. El libro de Bostrom explora qué significado tendría la vida en una tecn-utopía y se pregunta si podría ser más bien vacía. Habló con WIRED a través de Zoom en una conversación que ha sido ligeramente editada para mayor extensión y claridad.

Will Knight: ¿Por qué pasar de escribir sobre la IA superinteligente que amenaza a la humanidad a pensar en un futuro en el que se utilizará para hacer el bien?

Nick Bostrom: Ahora se presta mucha más atención a las diversas cosas que pueden salir mal en el desarrollo de la IA. Es un gran cambio en los últimos 10 años. Todos los principales laboratorios de investigación de IA cuentan ahora con grupos de investigación que intentan desarrollar métodos de focalización escalables. Y en los últimos años, también estamos viendo cómo los líderes políticos empiezan a prestar atención a la IA.

No ha habido un aumento correspondiente en profundidad y sofisticación cuando se trata de pensar hacia dónde van las cosas si no caemos en uno de estos pozos. Las reflexiones sobre este tema fueron bastante superficiales.

cuando escribiste superinteligenciaPocos habrían esperado que los riesgos existenciales de la IA se convirtieran en un debate generalizado tan rápidamente. ¿Necesitamos abordar los temas de su nuevo libro antes de lo que la gente piensa?

Creo que estas conversaciones comenzarán y eventualmente se profundizarán a medida que veamos la adopción de la automatización y esperemos que el progreso continúe.

Las aplicaciones para compañeros sociales son cada vez más importantes. La gente tendrá todo tipo de puntos de vista diferentes y es un gran lugar para tal vez tener una pequeña guerra cultural. Podría ser fantástico para las personas que no encuentran satisfacción en la vida normal, pero ¿qué pasa si hay un segmento de la población que disfruta abusando de ellos?

En el sector político y de la información, podríamos ver el uso de la IA en campañas políticas, marketing y sistemas automatizados de propaganda. Pero si tenemos un nivel suficiente de sabiduría, estas cosas realmente podrían fortalecer nuestra capacidad de ser ciudadanos democráticos constructivos, con asesoramiento personalizado que explique lo que las propuestas políticas significan para usted. Habrá toda una gama de dinámicas sociales.

¿Sería realmente tan malo un futuro en el que la IA haya resuelto muchos problemas como el cambio climático, las enfermedades y la necesidad de trabajar?

[ad_2]

New Comments