[ad_1]

//php echo do_shortcode(‘[responsivevoice_button voice=»US English Male» buttontext=»Listen to Post»]’) ?>

En la última ronda de resultados de pruebas comparativas de inferencia de MLPerf, los fabricantes de chips y servidores y los proveedores de nube demostraron el mejor rendimiento de hardware de su clase para la prueba comparativa de inferencia (LLM) GPT-J de parámetros 6B recientemente lanzada para modelos de lenguajes grandes. Esto tiene como objetivo mostrar el rendimiento del sistema en LLM como Chat-GPT.

Nvidia demostró el rendimiento de su superchip CPU-GPU Grace Hopper y Habana Labs de Intel demostró la inferencia LLM en su hardware acelerador Gaudi2. Google también mostró una vista previa del rendimiento de su chip TPU v5e recientemente anunciado para cargas de trabajo LLM.

NVIDIA

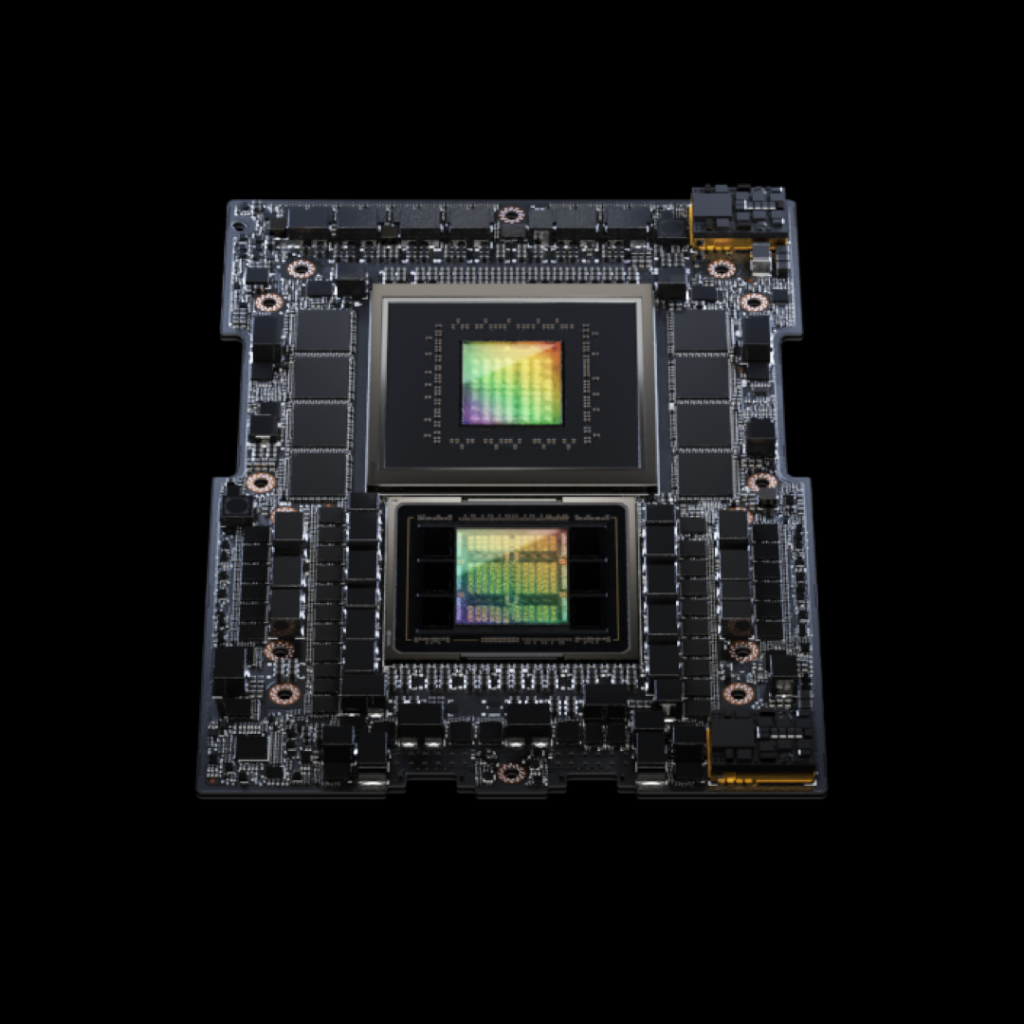

El superchip CPU-GPU de Nvidia, Grace Hopper (GH200), hizo su debut en esta ronda. Grace Hopper presenta la CPU Grace Neoverse v2-core de 72 brazos de Nvidia conectada a un chip Hopper H100 a través de la conexión C2C Link patentada de Nvidia. Según Nvidia, C2C es siete veces más rápido que PCIe, lo que ha sido un cuello de botella en el pasado. Una novedad de Grace Hopper en comparación con los sistemas H100 existentes es un diseño coherente de memoria que le brinda a la GPU acceso directo a 512 GB de memoria de CPU LPDDR5X de bajo consumo. Este es también el primer superchip de Nvidia que utiliza HBM3e, que es un 50% más rápido que el HBM3, y hay más (96 GB).

Las puntuaciones de inferencia de Grace Hopper mejoraron entre un 2% y un 17% en todas las cargas de trabajo en comparación con el H100 presentado con el sistema Intel Xeon. La mayor ventaja fue la recomendación, mientras que la más pequeña fue la nueva prueba comparativa LLM, donde la ventaja de Grace Hopper fue marginal (solo el 2 % en el escenario del servidor fuera de línea) sobre el sistema H100 e Intel Xeon.

«En lo que respecta a los LLM, es un LLM bastante pequeño», dijo Dave Salvator de Nvidia a EE Times. “Porque no supera los 80 GB [of HBM] Con el H100, el delta de potencia fue relativamente modesto”.

Grace Hopper puede generar 10,96 consultas por segundo en modo servidor o 13,34 en modo fuera de línea para el punto de referencia GPT-J LLM.

Una nueva característica llamada “Dirección asistida automática” permite que el cabezal Hopper funcione dinámicamente a una frecuencia de reloj más rápida cuando hay energía disponible.

«Si la GPU está muy ocupada y la CPU está relativamente silenciosa, podemos trasladar el presupuesto de energía a la GPU para proporcionar rendimiento adicional», dijo Salvator. «Este margen de rendimiento nos permite mantener una mejor residencia de frecuencia durante toda la carga de trabajo, ofreciendo así un mayor rendimiento».

Nvidia también presentó la L4 en esta ronda. Se basa en la arquitectura Ada Lovelace, que está diseñada para acelerar cargas de trabajo de gráficos e inteligencia artificial, como el análisis de video. Esta es una tarjeta PCIe con una potencia de diseño térmico (TDP) de GPU de 72 W y no requiere un conector de alimentación secundario. En los LLM, el L4 tuvo aproximadamente una décima parte del rendimiento del H100, pero mejoró a aproximadamente una quinta parte de los números del H100 para cargas de trabajo de visión como ResNet.

Intel

Habana Labs de Intel mostró resultados competitivos con su acelerador de entrenamiento Gaudi2 en el benchmark LLM en comparación con Hopper de Nvidia. Para GPT-J con una precisión de 99,0, los valores de Gaudi2 estaban dentro del 10% de los valores de Grace Hopper para el escenario del servidor y del 22% para el escenario fuera de línea. Gaudi2 tiene 96 GB de almacenamiento HBM2e, la misma capacidad que Grace Hopper, pero con la generación anterior de HBM, por lo que no es tan rápido y con menos ancho de banda. Habana ingresó Gaudi2, su chip de entrenamiento, para que pueda usar su capacidad de punto flotante para la inferencia LLM (el chip de inferencia Greco de Havana es solo de números enteros).

Intel también ha presentado resultados de inferencia LLM para sus CPU. Doble Intel

Google ha presentado resultados preliminares de su última generación de silicio acelerador de IA, el TPUv5e. Se dice que el v5e mejora el rendimiento por dólar en comparación con el TPUv4, según Google, y ahora está disponible en la nube de Google en módulos con hasta 256 chips. Cada chip ofrece 393 TOPS en INT8 y el módulo utiliza la interconexión entre chips (ICI) patentada por Google.

Cuatro TPUv5 pueden obtener 9,81 muestras fuera de línea por segundo, en comparación con 13,07 para una Nvidia H100; Al normalizar la potencia por acelerador, el rendimiento del H100 es aproximadamente cinco veces mayor.

Los propios cálculos de rendimiento por dólar de Google basados en estos números muestran una mejora de 2,7 veces para TPUv5e en comparación con la generación anterior, hasta una pila de software de inferencia optimizada basada en SAX de DeepMind y el compilador XLA de Google. Entre otras cosas, Google ha trabajado en la fusión de operadores de transformadores y la cuantificación de peso posterior al entrenamiento con INT8 y estrategias de fragmentación.

[ad_2]