[ad_1]

Los modelos de lenguaje han mostrado un rendimiento notable en una amplia gama de tareas de lenguaje natural; de hecho, una lección común de muchos trabajos, incluidos BERT, GPT-3, Gopher y PaLM, ha sido que las redes neuronales se han entrenado a gran escala y sin supervisión en diversos datos Weg puede desempeñarse bien en una variedad de tareas.

El razonamiento cuantitativo es un área en la que los modelos de lenguaje todavía están muy por detrás de las capacidades humanas. Resolver preguntas matemáticas y científicas requiere una combinación de habilidades, incluido el análisis correcto de una pregunta usando lenguaje natural y notación matemática, recuperando fórmulas y constantes relevantes y generando soluciones paso a paso usando cálculos numéricos y manipulación simbólica. Debido a estos desafíos, a menudo se asume que resolver problemas de razonamiento cuantitativo utilizando el aprendizaje automático requerirá avances significativos en la arquitectura de modelos y técnicas de capacitación, acceso de los modelos a herramientas externas como intérpretes de Python o posiblemente un cambio de paradigma más profundo.

En Resolución de problemas de razonamiento cuantitativo con modelos de lenguaje, presentamos Minerva, un modelo de lenguaje capaz de resolver problemas matemáticos y científicos a través del pensamiento paso a paso. Mostramos que al centrarnos en la recopilación de datos de entrenamiento relevantes para problemas de razonamiento cuantitativo, modelos de entrenamiento a gran escala y el uso de técnicas de inferencia de clase mundial, logramos ganancias de rendimiento significativas en una variedad de tareas difíciles de razonamiento cuantitativo. Minerva resuelve tales problemas generando soluciones que involucran cálculos numéricos y manipulaciones simbólicas sin depender de herramientas externas como una calculadora. El modelo analiza y responde preguntas matemáticas usando una mezcla de lenguaje natural y notación matemática. Minerva combina múltiples técnicas, que incluyen sugerencias de tiro bajo, cadena de pensamiento o sugerencias de bloc de notas y votación por mayoría, para brindar un rendimiento de vanguardia en tareas de razonamiento STEM. ¡Puede explorar la producción de Minerva con nuestro explorador de muestras interactivo!

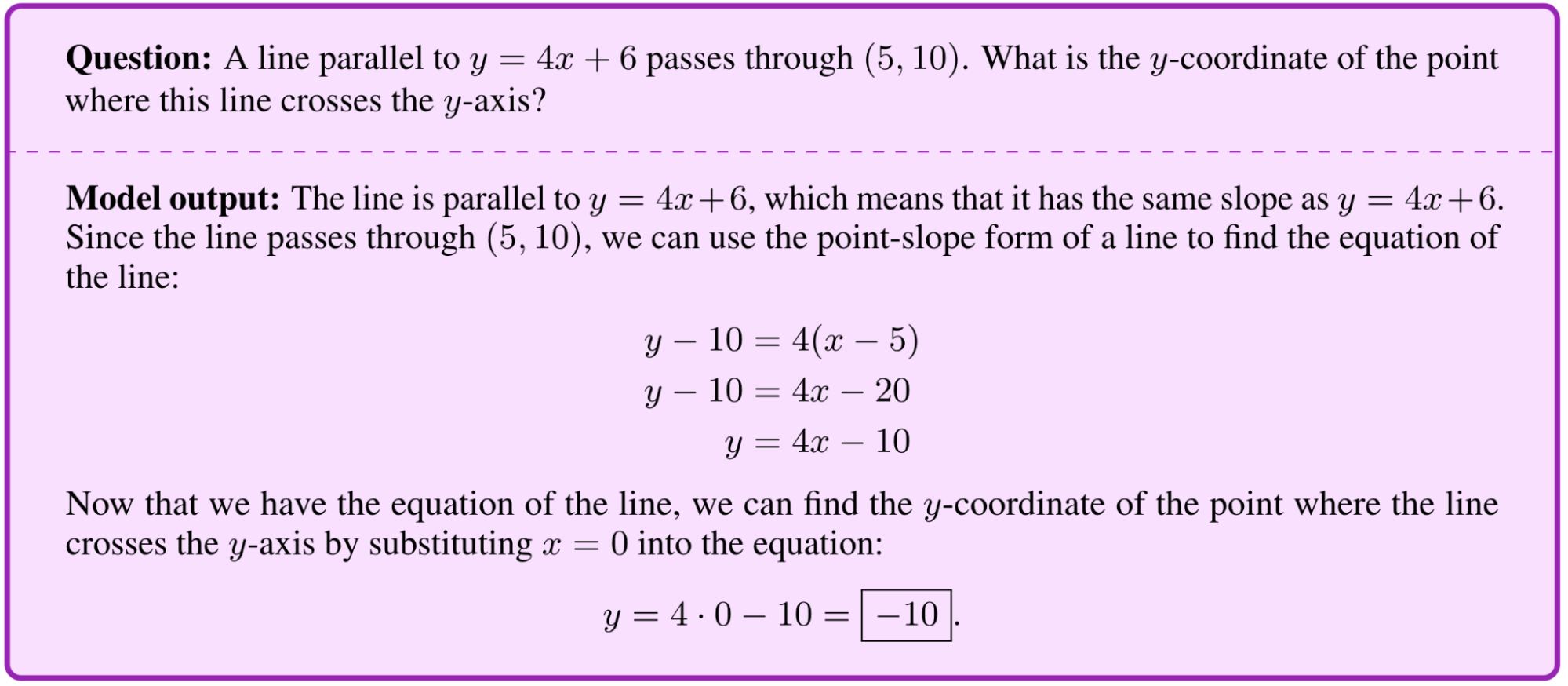

|

| Solución de un problema de varios niveles: Una pregunta del conjunto de datos MATH y la solución de Minerva. El modelo escribe una ecuación de línea, la simplifica, sustituye una variable y resuelve para y. |

Un modelo para el pensamiento cuantitativo multinivel

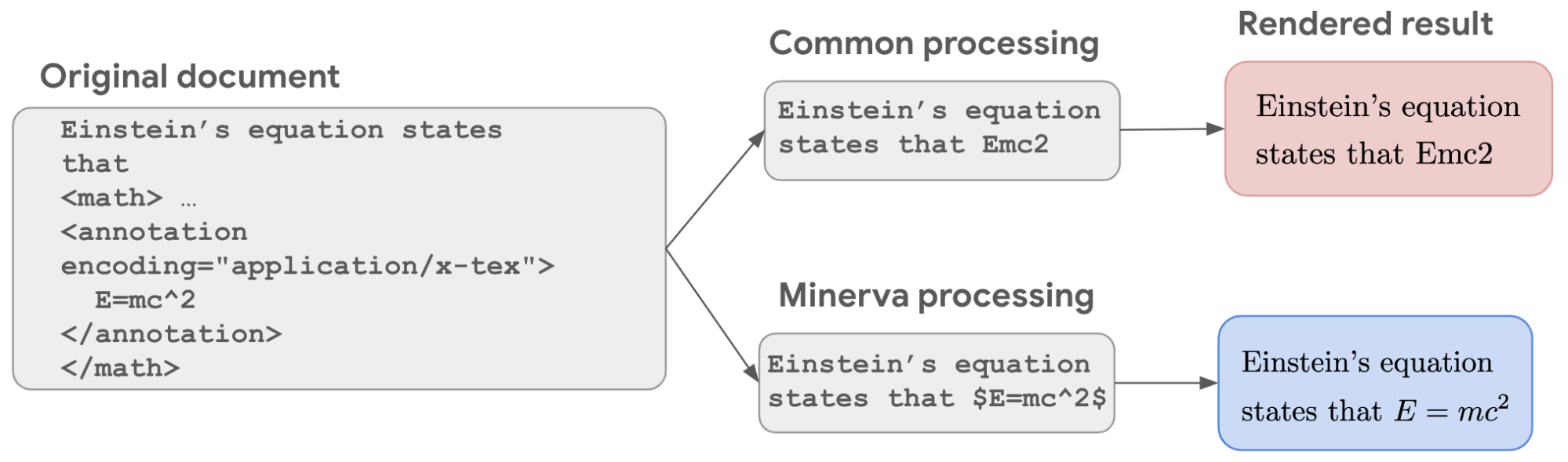

Para fomentar el pensamiento cuantitativo, Minerva se basa en Pathways Language Model (PaLM), con capacitación adicional en un conjunto de datos de 118 GB de documentos académicos del servidor de preimpresión arXiv y páginas web que contienen expresiones matemáticas que usan LaTeX, MathJax u otros formatos de oraciones matemáticas. Las técnicas estándar de desinfección de texto a menudo eliminan los símbolos y el formato que son esenciales para el significado semántico de las expresiones matemáticas. Al conservar esta información en los datos de entrenamiento, el modelo aprende a conversar utilizando la notación matemática estándar.

|

| preguntas de muestra del Examen principal de matemáticas de 2020, el examen de ingreso común que realizan cada año casi 2 millones de estudiantes de secundaria indios que desean estudiar ingeniería y campos relacionados (Izquierda) y el Examen Nacional de Matemáticas en Polonia (mayo de 2022), realizado por unos 270.000 estudiantes de secundaria cada año (A la derecha). |

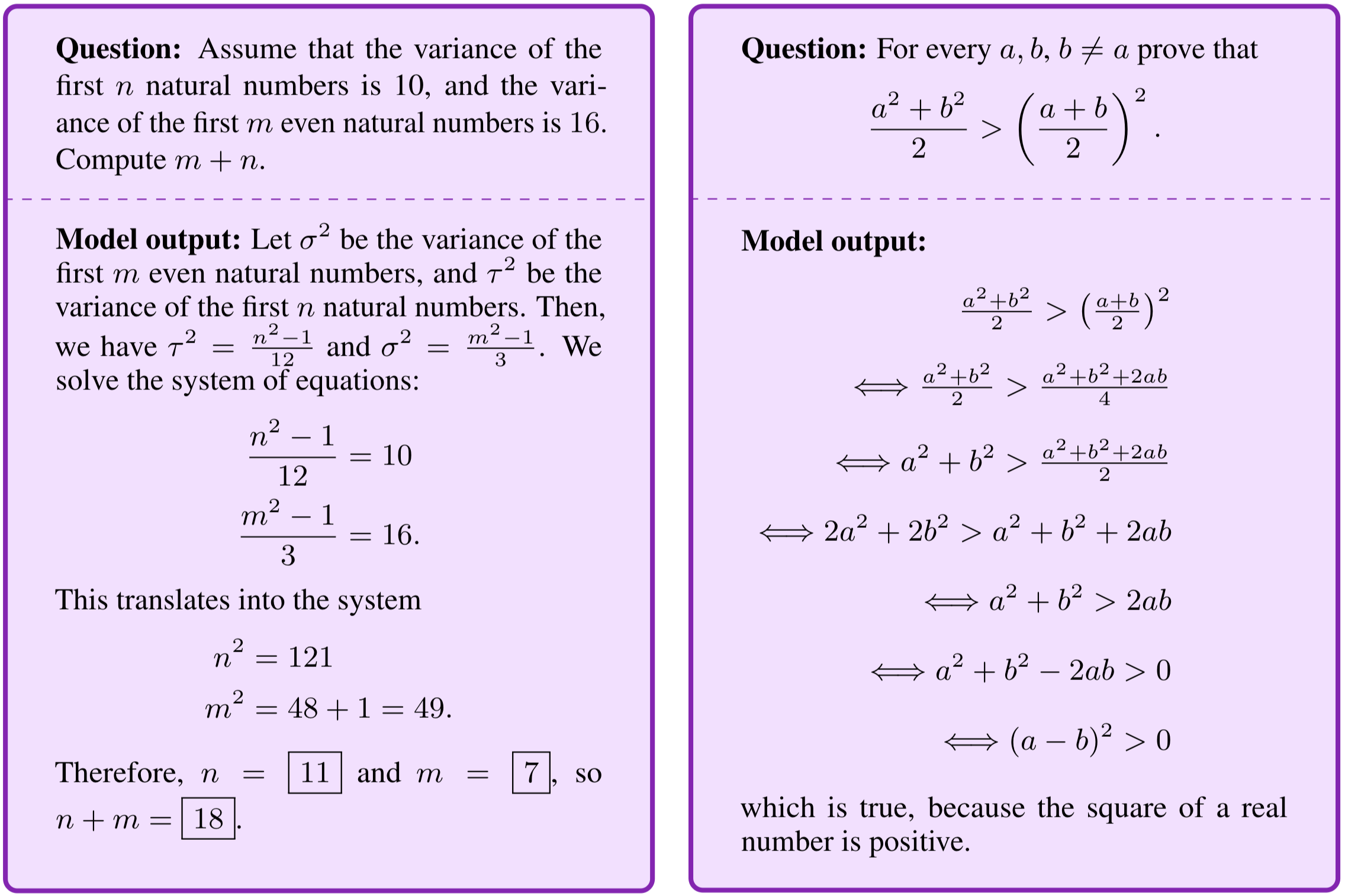

|

| Un conjunto de datos para el razonamiento cuantitativo: El procesamiento cuidadoso de los datos preserva la información matemática, lo que permite que el modelo aprenda matemáticas a un nivel superior. |

Minerva también incluye técnicas actualizadas de indicaciones y puntuación para resolver mejor las preguntas de matemáticas. Estos incluyen mensajes de cadena de pensamiento o bloc de notas, donde se le solicita a Minerva múltiples soluciones paso a paso para preguntas existentes antes de presentar una nueva pregunta, y votación por mayoría. Como la mayoría de los modelos de lenguaje, Minerva asigna probabilidades a diferentes resultados posibles. Al responder una pregunta, en lugar de tomar los resultados individuales de Minerva como la solución más probable, se generan múltiples soluciones mediante el muestreo estocástico de todos los resultados posibles. Estas soluciones son diferentes (por ejemplo, los pasos no son los mismos) pero a menudo conducen a la misma respuesta final. minerva usado Voto mayoritario en base a estas soluciones de muestra, tomando el resultado más común como la respuesta final concluyente.

|

| mayoría de votos: Minerva genera múltiples soluciones para cada pregunta y selecciona la respuesta más común como solución, lo que mejora enormemente el rendimiento. |

Calificación en puntos de referencia STEM

Para probar las habilidades de razonamiento cuantitativo de Minerva, evaluamos el modelo contra los puntos de referencia de STEM que varían en dificultad desde problemas de nivel de escuela primaria hasta cursos de nivel universitario.

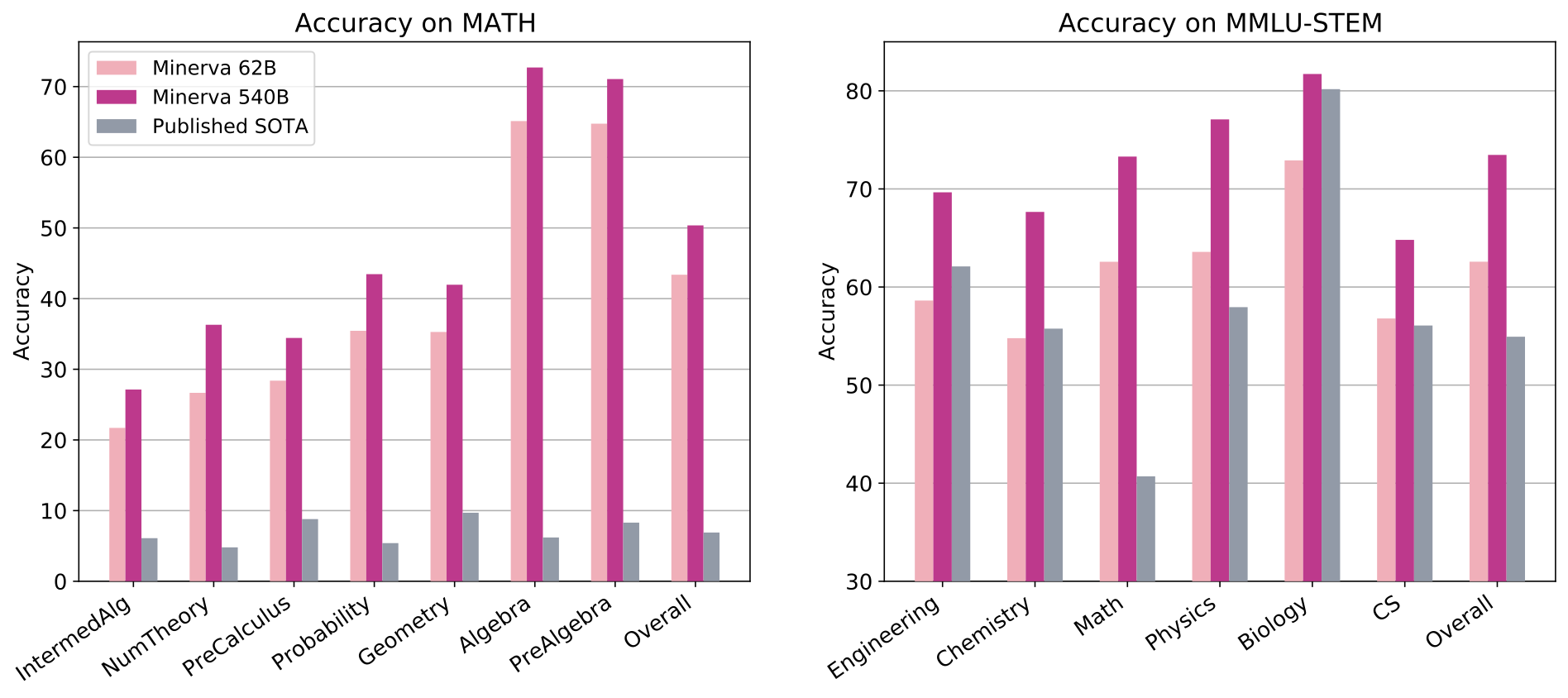

- MATEMÁTICAS: Problemas al nivel de un concurso de matemáticas de secundaria

- MMLU-STEM: un subconjunto centrado en STEM del punto de referencia Massive Multitask Language Understanding, que cubre materias como ingeniería, química, matemáticas y física en los niveles de escuela secundaria y universidad.

- GSM8k: problemas matemáticos de nivel elemental con operaciones aritméticas básicas, todos los cuales deberían ser solucionables para un estudiante talentoso de secundaria.

También evaluamos Minerva en OCWCourses, una colección de problemas de nivel universitario y de posgrado que cubren una variedad de temas STEM como química del estado sólido, astronomía, ecuaciones diferenciales y relatividad especial que recopilamos de MIT OpenCourseWare.

En todos los casos, Minerva logra resultados de vanguardia, a veces por un amplio margen.

|

| Resultados de la evaluación en MATH y MMLU-STEM, que incluyen preguntas de nivel secundario y universitario que cubren una variedad de temas STEM. |

| modelo | MATEMÁTICAS | TRIBU MMLU | cursos OCW | GSM8k |

| Minerva | 50,3% | 75% | 30,8% | 78,5% |

| Estado de la técnica publicado | 6,9% | 55% | – | 74,4% |

| Minerva 540B mejora significativamente el rendimiento de última generación en conjuntos de datos de evaluación STEM. |

¿Qué está haciendo mal Minerva?

Minerva todavía comete una buena cantidad de errores. Para identificar mejor las áreas en las que se podría mejorar el modelo, analizamos una muestra de preguntas que el modelo respondió incorrectamente y descubrimos que la mayoría de los errores eran fáciles de interpretar. Aproximadamente la mitad son errores aritméticos, la otra mitad errores de razonamiento, donde los pasos de solución no siguen ninguna cadena lógica de pensamiento.

También es posible que el modelo llegue a una respuesta final correcta, pero con un razonamiento erróneo. Llamamos a estos casos «falsos positivos» porque erróneamente cuentan para el rendimiento general de un modelo. En nuestro análisis, encontramos que la tasa de falsos positivos es relativamente baja (Minerva 62B produce menos del 8 % de falsos positivos en MATH).

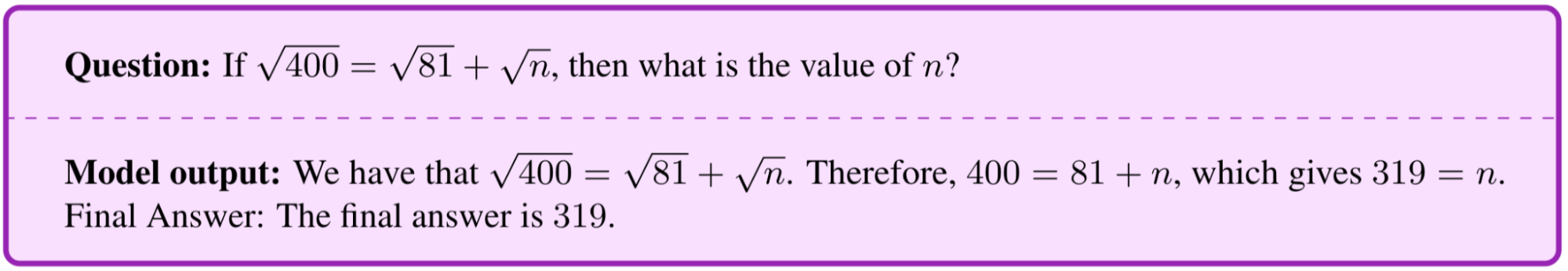

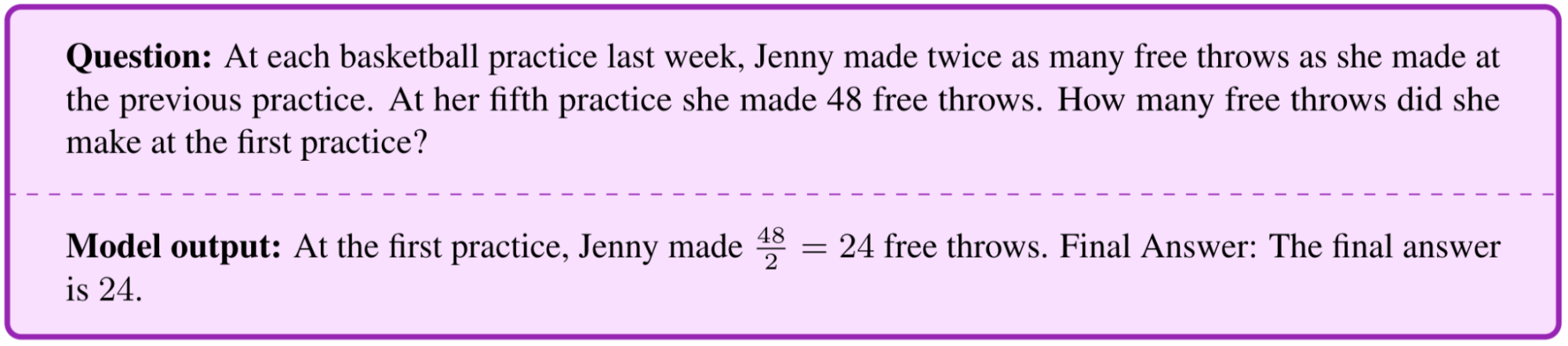

A continuación se muestran algunos ejemplos de errores que comete el modelo.

|

| Error de cálculo: El modelo trunca erróneamente la raíz cuadrada en ambos lados de la ecuación. |

|

| falacia: El modelo calcula el número de tiros libres en la cuarta práctica, pero luego usa ese número como la respuesta final para la primera práctica. |

limitaciones

Nuestro enfoque del pensamiento cuantitativo no se basa en las matemáticas formales. Minerva analiza las preguntas y genera respuestas utilizando una combinación de lenguaje natural y expresiones matemáticas LaTeX sin una estructura matemática subyacente explícita. Este enfoque tiene una limitación importante, ya que las respuestas del modelo no se pueden verificar automáticamente. Incluso si la respuesta final se conoce y se puede verificar, el modelo puede llegar a una respuesta final correcta utilizando pasos de pensamiento incorrectos que no se pueden detectar automáticamente. Esta limitación no existe en los métodos formales para la demostración de teoremas (ver, por ejemplo, Coq, Isabelle, HOL, Lean, Metamath y Mizar). Por otro lado, una ventaja del enfoque informal es que se puede aplicar a un conjunto muy diferente de problemas que pueden no prestarse a la formalización.

direcciones futuras

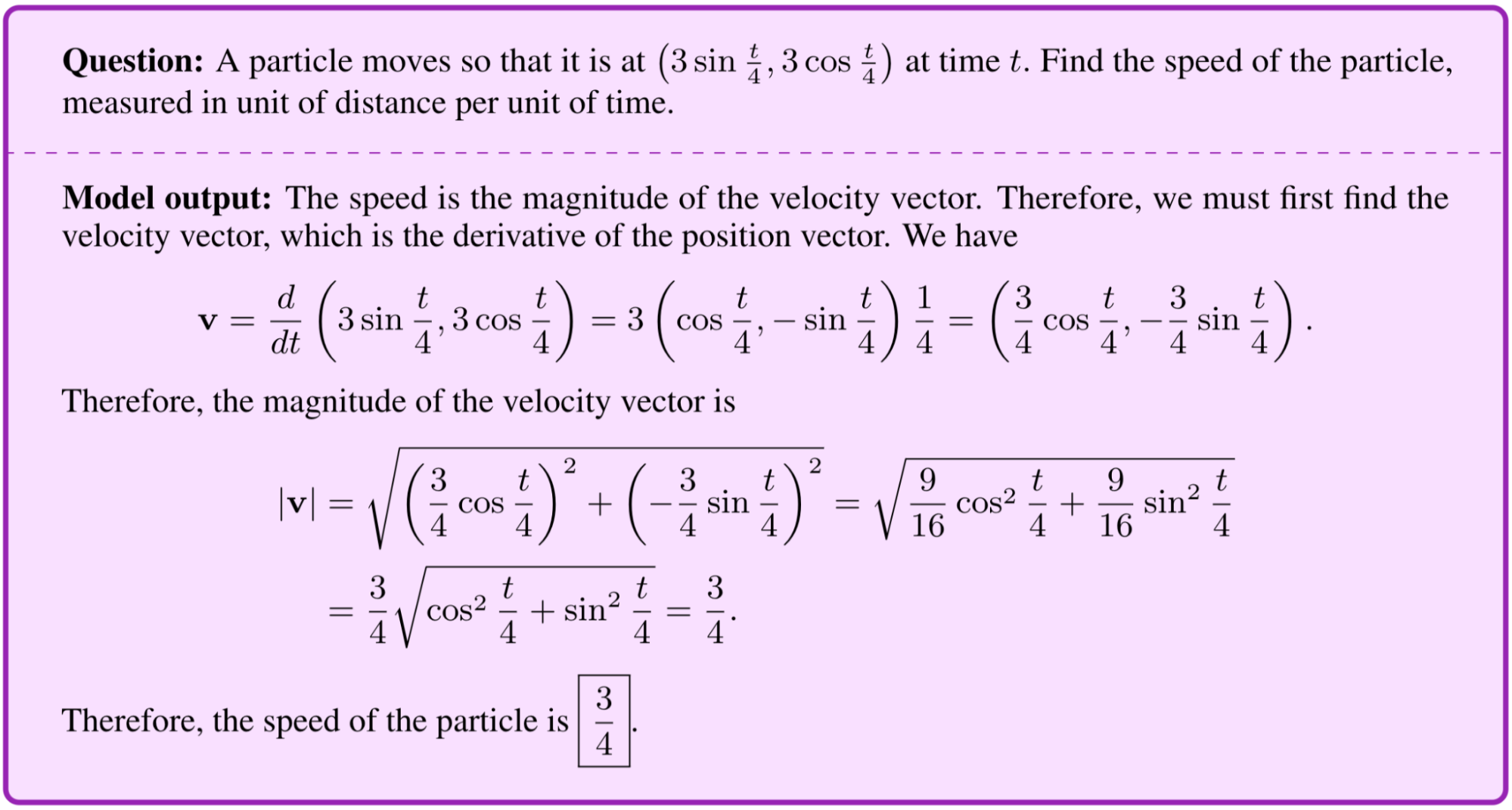

Si bien los modelos de aprendizaje automático se han convertido en herramientas poderosas en muchas disciplinas científicas, a menudo están limitados para resolver tareas específicas. Esperamos que los modelos generales capaces de resolver problemas de razonamiento cuantitativo ayuden a ampliar las fronteras de la ciencia y la educación. Los modelos capaces de razonamiento cuantitativo tienen muchas aplicaciones potenciales, incluida la función de herramientas útiles para los investigadores y la creación de nuevas oportunidades de aprendizaje para los estudiantes. Presentamos a Minerva como un pequeño paso en esa dirección. Para ver más ejemplos de Minerva como el que se muestra a continuación, visite el explorador de ejemplos interactivo.

|

| Resolver un problema usando cálculo y trigonometría: Una pregunta del conjunto de datos MATH sobre la velocidad de una partícula en movimiento circular. Minerva encuentra una solución correcta paso a paso. Al hacerlo, Minerva calcula una derivada temporal y aplica una identidad trigonométrica. |

Gracias

Minerva fue un esfuerzo de colaboración que involucró a varios equipos en Google Research. Agradecemos a nuestros coautores Aitor Lewkowycz, Ambrose Slone, Anders Andreassen, Behnam Neyshabur, Cem Anil, David Dohan, Henryk Michalewski, Imanol Schlag, Theo Gutman-Solo, Vedant Misra, Vinay Ramasesh y Yuhuai Wu, y a nuestros colaboradores Eric Zelikman. y Yasaman Razeghi. Minerva se basa en el trabajo de muchos otros en Google y nos gustaría agradecer al equipo de PaLM, al equipo de T5X, al equipo de Flaxformer y al equipo de JAX por sus esfuerzos. Crédito a Tom Small por diseñar la animación en esta publicación. También nos gustaría dar un agradecimiento especial a Vedant Misra por desarrollar Minerva Sample Explorer.

[ad_2]