[ad_1]

Meta ha lanzado una API profunda para Quest 3 como una función experimental para que los desarrolladores prueben la oclusión dinámica en realidad mixta.

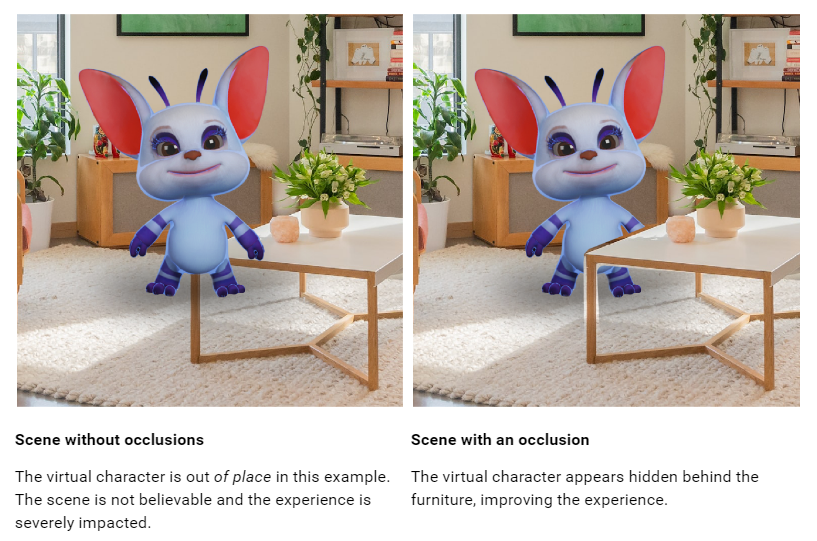

En nuestra revisión de Quest 3, criticamos duramente la falta de oclusión dinámica en la realidad mixta. Si bien los objetos virtuales pueden aparecer detrás de la malla de escena creada por el escaneo de la configuración de la habitación, siempre aparecerán frente a los objetos en movimiento, incluso si están más lejos, lo que parece distraer y antinatural.

Los desarrolladores ya pueden implementar la oclusión dinámica para sus manos usando la red de seguimiento de manos, pero pocos lo hacen porque se corta en la muñeca, por lo que no incluye el resto del brazo.

La nueva API de profundidad proporciona a los desarrolladores un mapa de profundidad aproximado por cuadro que el auricular genera desde su perspectiva. Esto se puede utilizar para implementar la oclusión, tanto para objetos en movimiento como personas, como para detalles más finos de objetos estáticos, ya que es posible que estos no hayan sido capturados en la malla de escena gruesa.

La oclusión dinámica debería hacer que la realidad mixta en Quest 3 parezca mucho más creíble. Sin embargo, la resolución de detección de profundidad de los auriculares es baja, lo que significa que no capturará detalles como los espacios entre los dedos y le permitirá ver un espacio en los bordes de los muebles.

También se recomienda explotar el mapa de profundidad solo a 4 metros, después de lo cual “la precisión cae significativamente”, por lo que es posible que los desarrolladores también quieran usar la malla de escena para la oclusión estática.

Hay dos formas en que los desarrolladores pueden implementar la oclusión: dura y blanda. Difícil es un poco más fácil de implementar pero tiene bordes irregulares, mientras que Suave es más difícil y tiene un costo de GPU pero se ve mucho mejor. Al observar el clip de muestra de Meta, es difícil imaginar que un desarrollador elija Difícil.

Sin embargo, en ambos casos, la oclusión requiere el uso de sombreadores de oclusión especiales de Meta o una implementación específica en sus sombreadores personalizados. Está lejos de ser una solución de un solo clic y admitirla probablemente requerirá un esfuerzo significativo por parte de los desarrolladores.

Además de la oclusión, los desarrolladores también podrían utilizar la API de profundidad para implementar efectos visuales basados en profundidad en realidad mixta, como la niebla.

El uso de Depth API actualmente requiere habilitar funciones experimentales en los auriculares Quest 3 ejecutando un comando ADB:adb shell setprop debug.oculus.experimentalEnabled 1

Los desarrolladores de Unity también deben usar una versión experimental del paquete Unity XR Oculus y usar Unity 2022.3.1 o posterior.

La documentación de Unity se puede encontrar aquí y de Unreal aquí.

Debido a que se trata de una característica experimental, las compilaciones que utilizan Depth API aún no se pueden cargar en Quest Store o App Lab, por lo que los desarrolladores tendrán que usar otros métodos de distribución, como SideQuest, para compartir sus implementaciones por ahora. Meta normalmente degrada las funciones de experimentales a producción en la versión posterior del SDK.

[ad_2]