[ad_1]

El niño interior en muchos de nosotros siente una abrumadora sensación de alegría cuando se tropieza con una pila de la mezcla fluorescente y gomosa de agua, sal y harina que pone la piel de gallina en el mapa: plastilina. (Aunque esto rara vez sucede en la edad adulta).

Mientras que manipular la plastilina es divertido y fácil para los niños de 2 años, la baba sin forma es difícil de manejar para los robots. Las máquinas se han vuelto cada vez más confiables con objetos rígidos, pero el manejo de objetos blandos y deformables trae consigo una larga lista de desafíos de ingeniería y, lo que es más importante, como con la mayoría de las estructuras flexibles, si mueve una parte, es probable que afecte todo lo demás.

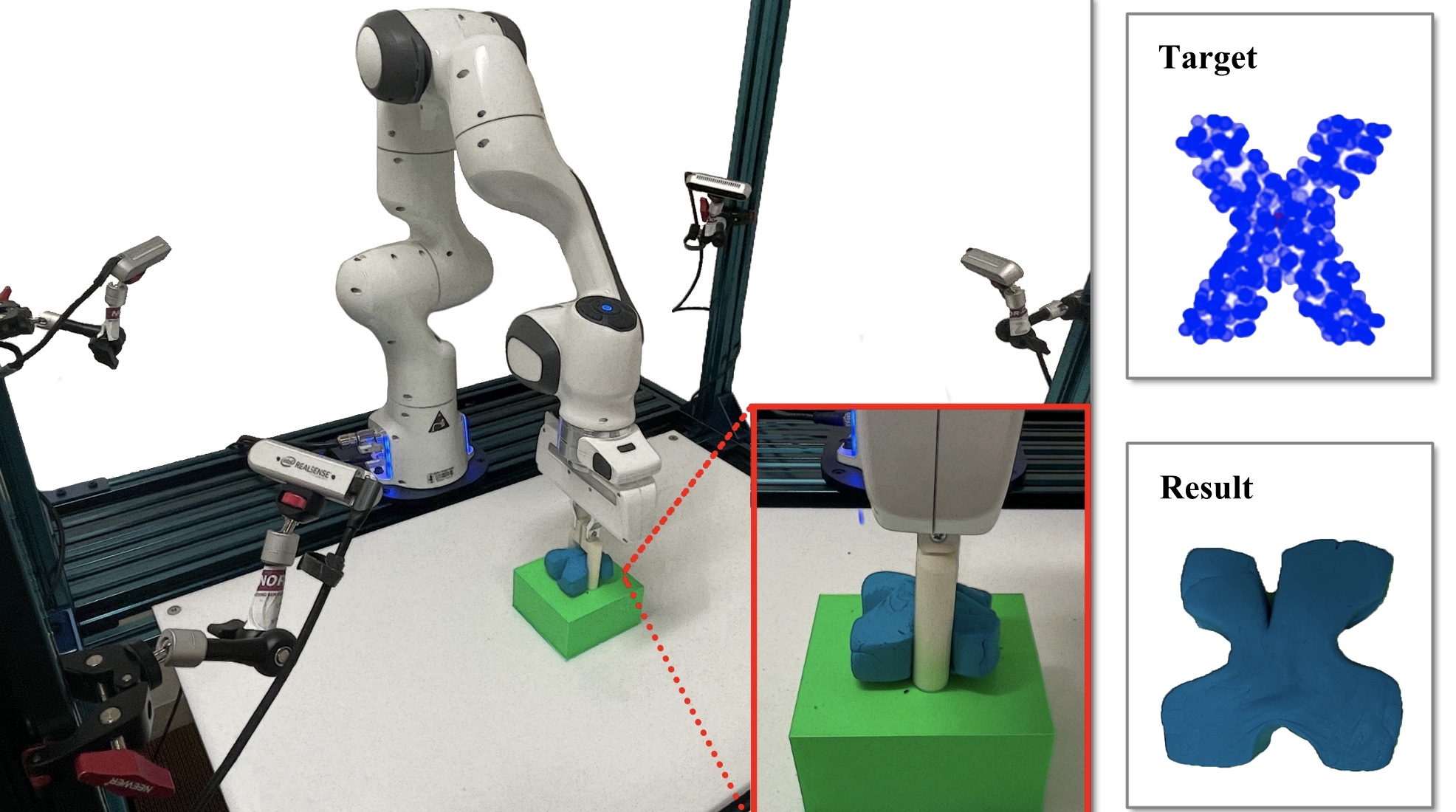

Los científicos del Laboratorio de Ciencias de la Computación e Inteligencia Artificial (CSAIL) del MIT y la Universidad de Stanford permitieron recientemente que los robots jugaran con la plastilina, pero no por razones de nostalgia. Su nuevo sistema aprende directamente de la entrada visual para permitir que un robot con una pinza de dos dedos vea, simule y dé forma a objetos pastosos. RoboCraft podía planificar de manera confiable el comportamiento de un robot, pellizcando y soltando plastilina para hacer varias letras, incluidas letras que nunca antes había visto. Con solo 10 minutos de datos, la pinza de dos dedos compitió con sus homólogos humanos que teleoperaban la máquina, con un desempeño a la par, y en ocasiones mejor, en las tareas probadas.

«Modelar y manipular objetos con altos grados de libertad son habilidades esenciales para que los robots aprendan a permitir tareas complejas de interacción industrial y doméstica, como rellenar albóndigas, enrollar sushi y hacer cerámica», dice Yunzhu Li, estudiante de doctorado de CSAIL y autor de un nuevo artículo sobre RoboCraft. «Si bien ha habido avances recientes en la manipulación de ropa y cuerdas, descubrimos que los objetos con alta plasticidad, como la masa o la plastilina, a pesar de su ubicuidad en entornos domésticos e industriales, eran en gran medida un territorio inexplorado. Con RoboCraft, aprendemos los modelos dinámicos directamente de los datos de sensores de alta dimensión, lo que nos brinda una forma prometedora basada en datos para realizar una planificación efectiva”.

Con material uniforme e indefinido, se debe considerar toda la estructura antes de poder realizar cualquier tipo de modelado y planificación eficiente y eficaz. Al convertir las imágenes en gráficos de partículas pequeñas, junto con algoritmos, RoboCraft hace predicciones más precisas del cambio de forma del material utilizando una red neuronal gráfica como modelo dinámico.

Por lo general, los investigadores han utilizado complejos simuladores de física para modelar y comprender la fuerza y la dinámica ejercida sobre los objetos, pero RoboCraft simplemente utiliza datos visuales. El funcionamiento interno del sistema se basa en tres partes para formar material blando en una «R», por ejemplo.

La primera parte, la percepción, se trata de aprender a «ver». Utiliza cámaras para recopilar datos de sensores visuales sin procesar del entorno, que luego se convierten en pequeñas nubes de partículas para representar las formas. Luego, una red neuronal basada en gráficos usa estos datos de partículas para aprender a «simular» la dinámica del objeto, o cómo se mueve. Luego, los algoritmos ayudan a planificar el comportamiento del robot para que aprenda a «dar forma» a una bola de masa, armado con los datos de entrenamiento de los muchos pellizcos. Si bien las letras están un poco sueltas, sin duda son representativas.

Además de lindas formas, el equipo (en realidad) está trabajando en hacer albóndigas con masa y un relleno preparado. En este momento, con solo una pinza de dos dedos, es una gran pregunta. RoboCraft requeriría herramientas adicionales (un panadero necesita varias herramientas para cocinar; los robots también): un rodillo, un sello y un molde.

Un área futura más que ven los científicos es el uso de RoboCraft para ayudar con las tareas domésticas y los quehaceres, lo que podría ser particularmente útil para las personas mayores o con movilidad limitada. Lograr esto requeriría una representación mucho más adaptativa de la masa o el objeto, dados los muchos obstáculos que podrían surgir, además de explorar qué clase de modelos podrían ser apropiados para capturar los sistemas estructurales subyacentes.

“RoboCraft esencialmente muestra que este modelo predictivo se puede aprender de una manera muy eficiente en datos para la planificación de movimientos. A largo plazo, estamos pensando en manipular materiales con diferentes herramientas”, dice Li. “Si piensas en hacer bolas de masa hervida o hacer masa, una pinza no resolvería eso. Ayudar al modelo a comprender y cumplir tareas de planificación durante un período de tiempo más largo, p. B. cómo se deformará la masa con la herramienta, los movimientos y las acciones actuales es el próximo paso para el trabajo futuro”.

Li coescribió el trabajo con Haochen Shi, estudiante de maestría de Stanford; Huazhe Xu, posdoctorado de Stanford; Zhiao Huang, estudiante de posgrado de la Universidad de California, San Diego; y Jiajun Wu, profesor asistente en Stanford. Presentarán los resultados de la investigación en la conferencia Robotics: Science and Systems en la ciudad de Nueva York. El trabajo cuenta con el apoyo parcial del Instituto de Stanford para la IA centrada en el ser humano (HAI), el Programa de Alcance de Investigación Global (GRO) de Samsung, el Instituto de Investigación de Toyota (TRI) y Amazon, Autodesk, Salesforce y Bosch.

[ad_2]