[ad_1]

Los desarrolladores de Quest 3 ahora pueden integrar tres nuevas características importantes para mejorar tanto la realidad virtual como la mixta.

Inside-Out Body Tracking (IOBT) y Generative Legs se anunciaron junto con Quest 3 en diciembre. La oclusión para realidad mixta a través de la API de profundidad era anteriormente una característica experimental, lo que significa que los desarrolladores podían probarla pero no incluirla en las compilaciones de Quest Store o App Lab.

Las tres funciones están disponibles como parte del SDK v60 para Unity y código nativo. Mientras tanto, la integración v60 de Unreal Engine incluye la API de profundidad, pero no IOBT ni Generative Legs.

Seguimiento de adentro hacia afuera de la parte superior del cuerpo.

Inside-Out Body Tracking (IOBT) utiliza las cámaras laterales orientadas hacia abajo del Quest 3 para rastrear su muñeca, codos, hombros y torso mediante algoritmos avanzados de visión por computadora.

IOBT evita problemas con los brazos estimados por cinemática inversa (IK), que a menudo son incorrectos y resultan incómodos porque el sistema solo hace estimaciones basadas en la posición de la cabeza y las manos. Cuando los desarrolladores integren IOBT, verán brazos y toros en sus posiciones reales, no una estimación.

Este seguimiento de la parte superior del cuerpo también permite a los desarrolladores anclar el movimiento del joystick a la dirección de su cuerpo, no solo a su cabeza o manos, y le permite realizar nuevas acciones como inclinarse sobre una repisa y mostrarlo de manera realista en su avatar.

Piernas de IA generativa

IOBT solo funciona para la parte superior del cuerpo. Meta ha lanzado Generative Legs para la parte inferior del cuerpo.

Generative Legs utiliza un modelo de inteligencia artificial de vanguardia para estimar la posición de las piernas, una tecnología que la empresa ha estado investigando durante años.

En Quest 3, Generative Legs proporciona una estimación más realista que los auriculares anteriores gracias al uso del seguimiento de la parte superior del cuerpo como entrada, pero también funciona en Quest Pro y Quest 2 cuando se usan solo la cabeza y las manos.

Sin embargo, el sistema Generative Legs es sólo un estimador y no un seguimiento. Entonces, si bien puede detectar saltos y sentadillas, no captura muchos movimientos reales como levantar las rodillas.

Juntos, el seguimiento de adentro hacia afuera de la parte superior del cuerpo y las piernas generativas permiten cuerpos completos plausibles en realidad virtual, lo que se llama síntesis de cuerpo completo, sin hardware externo.

Meta anunció previamente que Full Body Synthesis estaría disponible para Supernatural, Swordsman VR y Drunken Bar Fight.

API de profundidad para oclusión en realidad mixta

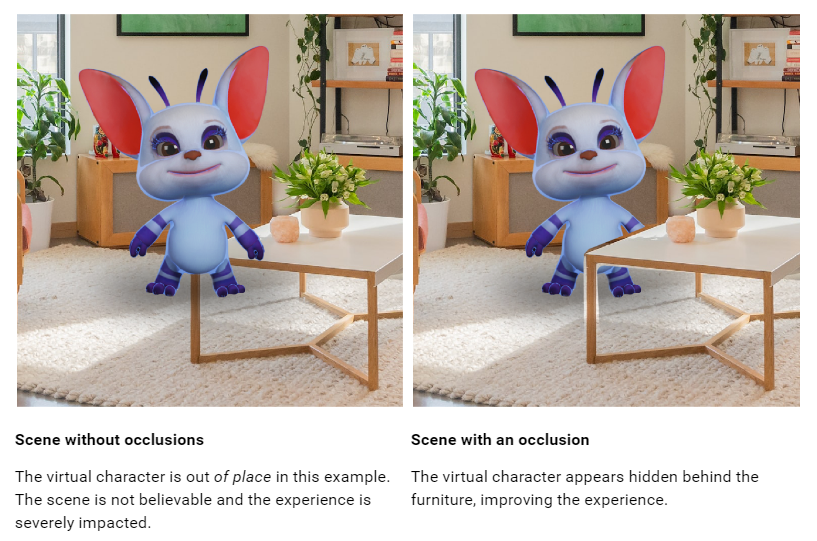

En nuestra revisión de Quest 3, criticamos duramente la falta de oclusión dinámica en la realidad mixta. Si bien los objetos virtuales pueden aparecer detrás de la malla de escena generada por el escaneo de la configuración de la habitación, siempre aparecerán frente a objetos en movimiento, como sus brazos y otras personas, incluso si están más lejos, lo que parece distraer y antinatural.

Los desarrolladores ya han podido implementar una oclusión dinámica para sus manos usando la red de seguimiento de manos, pero pocos lo han hecho porque se corta en la muñeca, por lo que no incluye el resto del brazo.

La nueva API de profundidad proporciona a los desarrolladores un mapa de profundidad aproximado por cuadro que el auricular genera desde su perspectiva. Esto se puede utilizar para implementar la oclusión, tanto para objetos en movimiento como para detalles más finos de objetos estáticos, ya que es posible que no hayan sido capturados en la malla de la escena.

La oclusión dinámica debería hacer que la realidad mixta parezca más natural en Quest 3. Sin embargo, la resolución de detección de profundidad de los auriculares es baja. muy bajo, por lo que no captura detalles como los espacios entre los dedos y ves un espacio vacío en los bordes de los objetos.

También se recomienda explotar el mapa de profundidad solo a 4 metros, después de lo cual “la precisión cae significativamente”, por lo que es posible que los desarrolladores también quieran usar la malla de escena para la oclusión estática.

Hay dos formas en que los desarrolladores pueden implementar la oclusión: dura y blanda. Hard es esencialmente gratuito pero tiene bordes irregulares, mientras que Soft tiene un costo de GPU pero se ve mejor. Al observar el clip de muestra de Meta, es difícil imaginar que un desarrollador elija Difícil.

Sin embargo, en ambos casos, la oclusión requiere el uso de sombreadores de oclusión especiales de Meta o una implementación específica en sus sombreadores personalizados. Está lejos de ser una solución de un solo clic y admitirla probablemente requerirá un esfuerzo significativo por parte de los desarrolladores.

Además de la oclusión, los desarrolladores también podrían utilizar la API de profundidad para implementar efectos visuales basados en profundidad en realidad mixta, como la niebla.

UploadVR prueba la oclusión profunda de la API.

La documentación de Unity se puede encontrar aquí y de Unreal aquí.

[ad_2]