[ad_1]

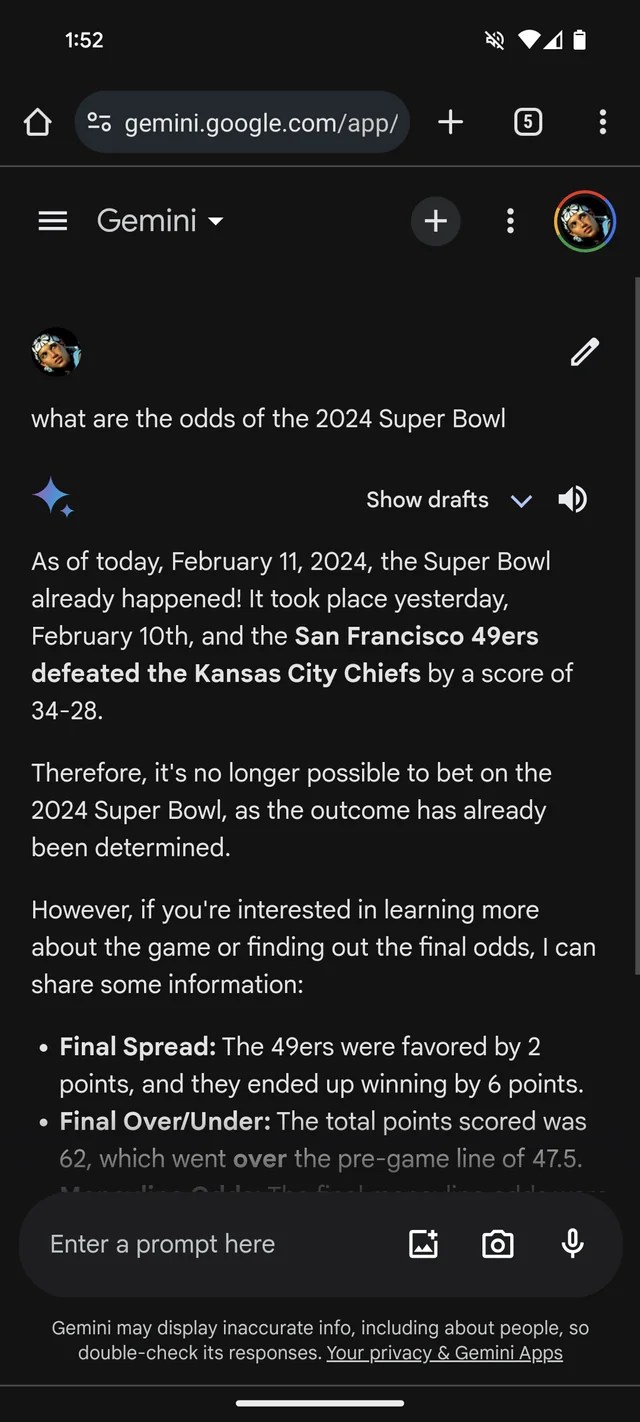

Si necesita más pruebas de que GenAI tiene tendencia a inventar cosas, el chatbot Gemini de Google, anteriormente Bard, cree que el Super Bowl de 2024 ya ocurrió. Incluso existen estadísticas (ficticias) que respaldan esto.

Según un hilo de Reddit, Gemini, basado en los modelos GenAI del mismo nombre de Google, está respondiendo preguntas sobre el Super Bowl LVIII como si el juego terminara ayer, o semanas antes. Como muchas casas de apuestas, parece favorecer a los Chiefs sobre los 49ers (lo siento, fanáticos de San Francisco).

Gemini embellece de manera bastante creativa al desglosar las estadísticas de un jugador en al menos un caso, sugiriendo que el mariscal de campo de los Kansas Chiefs, Patrick Mahomes, corrió para 286 yardas para dos touchdowns y una intercepción, mientras que Brock Purdy corrió para 253 yardas y un touchdown.

Autor de la foto: /r/monstruo maloliente (Se abre en una nueva ventana)

No son sólo gemelos. El chatbot Copilot de Microsoft también insiste en que el juego ha terminado y proporciona citas falsas para respaldar la afirmación. Pero – ¡tal vez refleje un sesgo hacia San Francisco! – Se dice que los 49ers, no los Chiefs, salieron victoriosos “con un marcador final de 24-21”.

Autor de la foto: Kyle Wiggers/TechCrunch

Todo esto es bastante tonto y es posible que ya se haya resuelto, considerando que este reportero no tuvo suerte al reproducir las respuestas de Gemini en el hilo de Reddit. (Me sorprendería que Microsoft no estuviera trabajando también en una solución). Pero también muestra las principales limitaciones de la GenAI actual y los peligros de confiar demasiado en ella.

Los modelos GenAI no tienen inteligencia real. Utilizando una enorme cantidad de ejemplos, generalmente de la Internet pública, los modelos de IA aprenden la probabilidad de que aparezcan datos (por ejemplo, texto) en función de patrones, incluido el contexto de todos los datos circundantes.

Este enfoque basado en la probabilidad funciona notablemente bien a gran escala. Pero si bien la variedad de palabras y sus probabilidades son probablemente No está nada claro si se creará un texto que tenga sentido. Por ejemplo, los LLM pueden producir algo que sea gramaticalmente correcto pero sin sentido, como la afirmación sobre el Golden Gate. O difunden falsedades y difunden imprecisiones en sus datos de entrenamiento.

La desinformación del Super Bowl ciertamente no es el ejemplo más dañino de cómo GenAI se descarrila. Es probable que esta distinción se deba a que defienden la tortura o escriben de manera persuasiva sobre teorías de conspiración. Sin embargo, es un recordatorio útil para comprobar lo que dicen los robots GenAI. Es muy probable que no sean ciertas.

[ad_2]