[ad_1]

El procesamiento en memoria (PIM) tiene un potencial prometedor para revolucionar los SoC de IA

mejoras revolucionarias en velocidad, eficiencia y sostenibilidad

Las nuevas aplicaciones de inteligencia artificial (IA) consumirán más recursos computacionales y de memoria que nunca. La arquitectura de sistema en chip (SoC) es crucial para gestionar eficientemente este tipo de aplicaciones.

Estos SoC dependen de canalizaciones de datos y organizaciones de almacenamiento para procesar la solicitud. Sin embargo, con cada nueva aplicación de IA, la cantidad de datos a procesar aumenta cientos de veces y la innovación en el diseño de SoC no puede seguir el ritmo. En algún momento, los SoC convencionales ya no podrán satisfacer las altas demandas de las aplicaciones de IA. Por lo tanto, varias empresas de IA han comenzado a centrarse en soluciones SoC personalizadas.

La aparición del SoC de IA

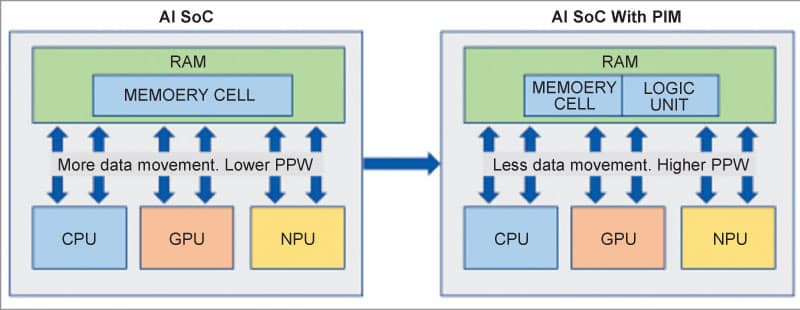

Aquí es también donde entra en juego AI SoC: un sistema en un chip para inteligencia artificial. AI SoC utiliza el método de diseño y fabricación agregado (un solo chip de silicio) o desagregado (múltiples chips, es decir, chiplets). Lo que los diferencia de los SoC tradicionales es que están diseñados para proporcionar diferentes tipos de elementos de procesamiento (PE) (CPU, GPU, NPU, etc.) para garantizar que los datos se procesen reduciendo al máximo la cantidad de tareas por ciclo determinado.

Desafíos comunes con los SoC de IA

Sin embargo, los SoC de IA todavía sufren los mismos problemas que los SoC tradicionales. Los datos deben moverse continuamente desde las memorias de nivel inferior (DRAM/SRAM) a las memorias de nivel superior (L3/L2/L1/Registros). Las aplicaciones basadas en datos de IA se esfuerzan constantemente por procesar la mayor cantidad de datos posible, lo que hace que los SoC de IA dediquen ciclos de reloj a mover datos de la memoria de nivel superior a la memoria de nivel inferior y viceversa. Todo esto conduce a un procesamiento lento y a un mayor consumo de energía.

Soluciones PIM para SoC de IA

AI SoC debería comenzar a adoptar soluciones de procesamiento en memoria (PIM) para aliviar este cuello de botella. PIM es una solución de almacenamiento que combina funciones lógicas y memoria, lo que permite el procesamiento de datos en una memoria de nivel inferior y, al mismo tiempo, permite que los datos se procesen utilizando PE con memoria de nivel superior. PIM está integrado en la memoria de alto ancho de banda (HBM), que no solo proporciona el mejor rendimiento informático (dentro de la memoria), sino también la transferencia de datos (hacia y desde la memoria).

Hasta ahora, Samsung y SK Hynix han desarrollado una solución de almacenamiento PIM. Los datos compartidos muestran una reducción del 80-85% en el consumo de energía. Esto representa un ahorro significativo teniendo en cuenta que las aplicaciones de IA están llevando la industria informática hacia TOPS: billones de operaciones por segundo. Cualquier solución que pueda aumentar los TOPS y al mismo tiempo mejorar el rendimiento por vatio será fundamental para el espacio de AI SoC.

“Cualquier solución que pueda aumentar TOPS y al mismo tiempo mejorar el rendimiento por vatio será fundamental para el espacio de AI SoC“

El camino a seguir para los SoC de IA

Actualmente no existen SoC de IA producidos en masa con funciones basadas en PIM. Con las prometedoras soluciones de Samsung y SK Hynix (y Micron también explora PIM), existen argumentos sólidos para desarrollar SoC de IA con esta nueva arquitectura de memoria. No solo acelera los requisitos de procesamiento de las aplicaciones de IA, sino que, cuando se combina con soluciones superiores a Moore, como los chiplets, puede revolucionar el diseño de los centros de datos de servidores al reducir la cantidad de bastidores de servidores, lo que hace que los centros de datos sean más eficientes energéticamente.

Los SoC de IA con PIM también requieren varios cambios a nivel de software del sistema. Las aplicaciones necesitan gestionar el procesamiento de datos con PE y también con PIM simultáneamente sin afectar el ciclo del reloj.

En resumen, una solución a nivel de memoria que pueda acelerar el flujo de datos y al mismo tiempo reducir la cantidad de ciclos de reloj necesarios para procesar billones de puntos de datos será fundamental para AI SoC. En este sentido, el SoC AI impulsado por PIM es definitivamente una de esas soluciones.

El autor, Chetan Arvind Patil, es ingeniero de producto sénior en NXP USA Inc.

[ad_2]