[ad_1]

El aprendizaje por refuerzo proporciona un marco conceptual para que los agentes autónomos aprendan de la experiencia, de forma análoga a enseñarle golosinas a una mascota. Sin embargo, las aplicaciones prácticas del aprendizaje por refuerzo suelen ser todo menos obvias: en lugar de utilizar RL para aprender mediante prueba y error intentando realmente la tarea deseada, las aplicaciones típicas de RL utilizan una fase de entrenamiento separada (generalmente simulada). Por ejemplo, AlphaGo aprendió a jugar Go no compitiendo contra miles de personas, sino jugando contra sí mismo en una simulación. Si bien este tipo de entrenamiento simulado es atractivo para juegos donde las reglas son bien conocidas, la aplicación a áreas del mundo real como la robótica puede requerir una serie de enfoques complejos, como el uso de datos simulados o la instrumentación de entornos del mundo real de diversas maneras. hacer posible la formación en condiciones de laboratorio. En cambio, ¿podemos desarrollar sistemas de aprendizaje por refuerzo para robots que les permitan aprender en el trabajo mientras realizan la tarea que deben completar? En esta publicación de blog analizamos ReLMM, un sistema que desarrollamos y que utiliza el aprendizaje continuo para aprender a limpiar una habitación directamente con un robot real.

Evaluamos nuestro método en varias tareas con diferentes niveles de dificultad. La tarea superior izquierda requiere recoger manchas blancas uniformes sin obstáculos, mientras que otras habitaciones tienen objetos de diferentes formas y colores, obstáculos que dificultan la navegación y oscurecen los objetos, y alfombras estampadas que dificultan detectar los objetos en el para reconocer el suelo.

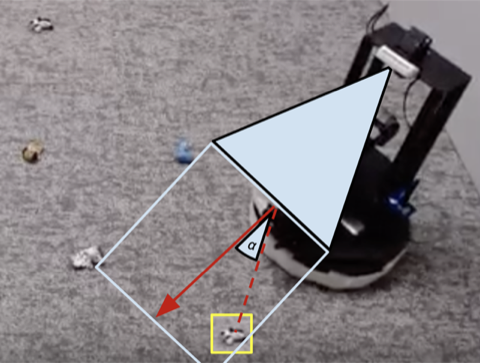

Para brindar capacitación “en el trabajo” en el mundo real, adquirir más experiencia tiene un costo prohibitivo. Si podemos facilitar la capacitación en el mundo real haciendo que el proceso de recopilación de datos sea más autónomo sin necesidad de supervisión o intervención humana, podremos beneficiarnos aún más de la simplicidad de los agentes que aprenden de la experiencia. En este trabajo diseñamos un sistema de entrenamiento de robots móviles “en el trabajo” para la limpieza aprendiendo a agarrar objetos en diferentes espacios.

La gente no nace un día y se entrevista al siguiente. Hay muchos niveles de tareas que las personas aprenden antes de solicitar un trabajo. Comenzaremos con los más simples y construiremos a partir de ahí. En ReLMM, aprovechamos este concepto al permitir que los robots entrenen habilidades comúnmente reutilizables, como agarrar, alentando primero al robot a priorizar el entrenamiento de estas habilidades antes de aprender habilidades posteriores, como la navegación. Aprender de esta forma tiene dos ventajas para la robótica. La primera ventaja es que cuando un agente se concentra en aprender una habilidad, puede recopilar datos de manera más eficiente sobre la distribución estatal local para esa habilidad.

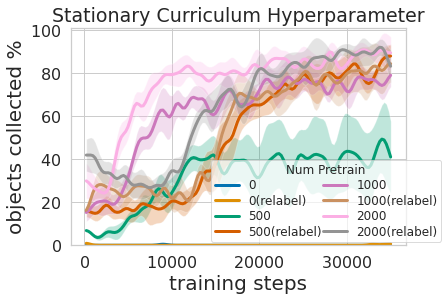

Esto se ilustra en la figura anterior, donde evaluamos la cantidad de experiencia de agarre priorizada necesaria para permitir un entrenamiento eficiente en manipulación móvil. La segunda ventaja de un enfoque de aprendizaje de múltiples etapas es que podemos examinar los modelos entrenados para diferentes tareas y hacerles preguntas, tales como: B. “¿Puedes entender algo ahora?”, que es útil para el entrenamiento de navegación que describimos a continuación.

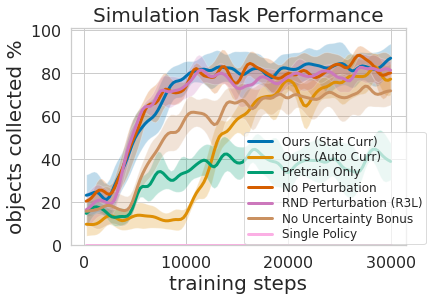

Entrenar esta política multinivel no solo fue más eficiente que aprender ambas habilidades al mismo tiempo, sino que también permitió que el controlador comprensivo influyera en la política de navegación. Tener un modelo que estime la incertidumbre de su éxito en la detección (Nuestro arriba) se puede utilizar para mejorar la exploración de navegación omitiendo áreas sin objetos tangibles, a diferencia de Bono sin incertidumbre que no utiliza esta información. El modelo también se puede utilizar para cambiar el nombre de los datos durante el entrenamiento, de modo que en el desafortunado caso de que el modelo de agarre no haya tenido éxito al intentar agarrar un objeto a su alcance, la política de agarre aún pueda proporcionar una señal indicando que un objeto estaba allí. pero no fue posible comprenderlo, los políticos aún no han aprendido a comprenderlo. Además, aprender modelos modulares ofrece ventajas técnicas. La formación modular permite la reutilización de habilidades que son más fáciles de aprender y pueden permitir la construcción de sistemas inteligentes pieza por pieza. Esto es beneficioso por muchas razones, incluida la evaluación y comprensión de la seguridad.

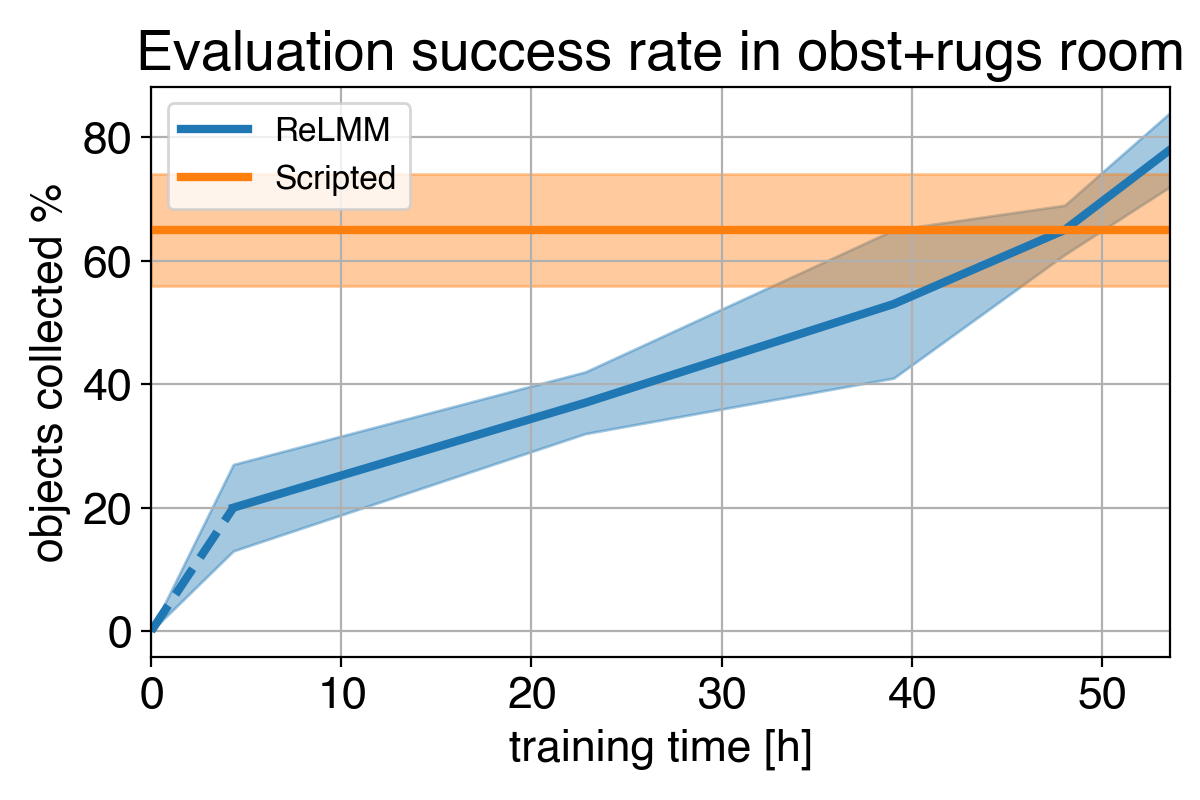

Muchas tareas robóticas que vemos hoy en día se pueden realizar con controladores hechos a mano con distintos grados de éxito. Para nuestra tarea de limpieza de habitaciones, desarrollamos un controlador artesanal que localiza objetos mediante grupos de imágenes y se mueve hasta el objeto detectado más cercano en cada paso. Este controlador diseñado por expertos funciona muy bien con los calcetines de bala visualmente llamativos y evita los obstáculos de manera sensata. Sin embargo, no puede aprender rápidamente una forma óptima de recoger los objetos y tiene problemas con habitaciones visualmente diferentes.. Como se muestra en el Video 3 a continuación, la guía del guión se distrae con la alfombra blanca estampada mientras intenta encontrar más objetos blancos para agarrar.

1)

2)

3)

4)

Mostramos una comparación entre (1) nuestra política al comienzo de la capacitación, (2) nuestra política al final de la capacitación y (3) la política del guión. En (4), podemos ver que el rendimiento del robot mejora con el tiempo y eventualmente supera la política establecida en el script para recolectar rápidamente los objetos en la habitación.

¿Cuál es el propósito de aprender si asumimos que podemos utilizar expertos para codificar este controlador hecho a mano? Una limitación importante de los controles hechos a mano es que están adaptados a una tarea específica, como agarrar objetos blancos. Al presentar una variedad de objetos que difieren en color y forma, es posible que el ambiente original ya no sea el óptimo. Nuestro método basado en el aprendizaje no requiere ningún trabajo manual adicional, sino que puede adaptarse a diferentes tareas adquiriendo su propia experiencia.

Sin embargo, la lección más importante es que incluso si el controlador hecho a mano es poderoso, el agente de aprendizaje eventualmente lo superará, si se le da suficiente tiempo. Este proceso de aprendizaje es autónomo y tiene lugar mientras el robot está en funcionamiento, lo que lo hace comparativamente económico. Esto demuestra la capacidad de los agentes de aprendizaje, que también se puede considerar como idear una forma general de llevar a cabo un “proceso de ajuste manual experto” para cualquier tipo de tarea. Los sistemas de aprendizaje son capaces de crear todo el algoritmo de control del robot y no se limitan a ajustar algunos parámetros en un script. El paso crucial de este trabajo permite que estos sistemas de aprendizaje del mundo real recopilen de forma autónoma los datos necesarios para que los métodos de aprendizaje tengan éxito.

Esta publicación se basa en el artículo “Aprendizaje por refuerzo totalmente autónomo en el mundo real con aplicaciones a la manipulación móvil” presentado en CoRL 2021. Se pueden encontrar más detalles en nuestro artículo, en nuestro sitio web y en el vídeo. Proporcionamos código para reproducir nuestros experimentos. Agradecemos a Sergey Levine por sus valiosos comentarios sobre esta publicación de blog.

[ad_2]