[ad_1]

Solicite el pronóstico del tiempo a un dispositivo doméstico inteligente y el dispositivo tardará unos segundos en responder. Una de las razones de esta latencia es que los dispositivos conectados no tienen suficiente memoria o potencia para almacenar y ejecutar los modelos de aprendizaje automático masivo necesarios para que el dispositivo comprenda lo que el usuario le pide. El modelo se almacena en un centro de datos, que puede estar a cientos de millas de distancia, donde se calcula la respuesta y se envía al dispositivo.

Investigadores del MIT han desarrollado un nuevo método para computar directamente en estos dispositivos que reduce drásticamente esta latencia. Su técnica descarga los pasos intensivos en memoria de ejecutar un modelo de aprendizaje automático en un servidor central, donde los componentes del modelo se codifican en ondas de luz.

Las ondas se transmiten a través de fibra óptica a un dispositivo conectado, lo que permite enviar toneladas de datos a través de una red a la velocidad del rayo. Luego, el receptor usa un dispositivo óptico simple que realiza cálculos rápidamente utilizando las partes de un modelo transportado por estas ondas de luz.

Esta técnica da como resultado una mejora de más de cien veces en la eficiencia energética en comparación con otros métodos. También podría mejorar la seguridad, ya que los datos de un usuario no tienen que transmitirse a una ubicación central para su cómputo.

Este método podría permitir que un automóvil autónomo tome decisiones en tiempo real mientras usa solo un pequeño porcentaje de la energía que actualmente requieren las computadoras que consumen mucha energía. También podría permitir que un usuario tenga entretenimiento de latencia cero con su dispositivo doméstico inteligente, use el procesamiento de video en vivo a través de redes celulares o incluso habilita la clasificación de imágenes de alta velocidad en una nave espacial a millones de millas de la Tierra.

«Cada vez que desee ejecutar una red neuronal, debe ejecutar el programa, y la rapidez con la que puede ejecutar el programa depende de la rapidez con la que puede inyectar el programa desde la memoria. Nuestra canalización es enorme: es más o menos equivalente a enviar un largometraje a través de Internet cada milisegundo más o menos. Así de rápido llegan los datos a nuestro sistema. Y así de rápido puede calcular», dice el autor principal Dirk Englund, profesor asociado en el Departamento de Ingeniería Eléctrica y Ciencias de la Computación (EECS) y miembro del Laboratorio de Investigación de Electrónica del MIT.

Junto a Englund, el autor principal y estudiante de EECS Alexander Sludds está involucrado en el trabajo; el estudiante de EECS Saumil Bandyopadhyay, el científico investigador Ryan Hamerly y otros del MIT, MIT Lincoln Laboratory y Nokia Corporation. El estudio se publica hoy en Ciencias.

descarga

Las redes neuronales son modelos de aprendizaje automático que utilizan capas de nodos conectados, o neuronas, para reconocer patrones en conjuntos de datos y realizar tareas como clasificar imágenes o reconocer el habla. Sin embargo, estos modelos pueden contener miles de millones de parámetros de peso, que son valores numéricos que transforman los datos de entrada cuando se procesan. Estos pesos deben almacenarse. Al mismo tiempo, el proceso de transformación de datos involucra miles de millones de cálculos algebraicos que requieren mucha potencia para realizarse.

El proceso de recuperar datos (en este caso, los pesos de la red neuronal) de la memoria y transferirlos a las partes de una computadora que realizan el cálculo real es uno de los mayores factores limitantes para la velocidad y la eficiencia energética, dice Sludds.

«Así que pensamos, ¿por qué no quitamos todo el trabajo pesado, el proceso de extraer miles de millones de pesos de la memoria, del dispositivo Edge y lo colocamos en un lugar donde tengamos un amplio acceso a la energía y el almacenamiento, qué nos da la capacidad de llevar esos pesos rápido?” dice.

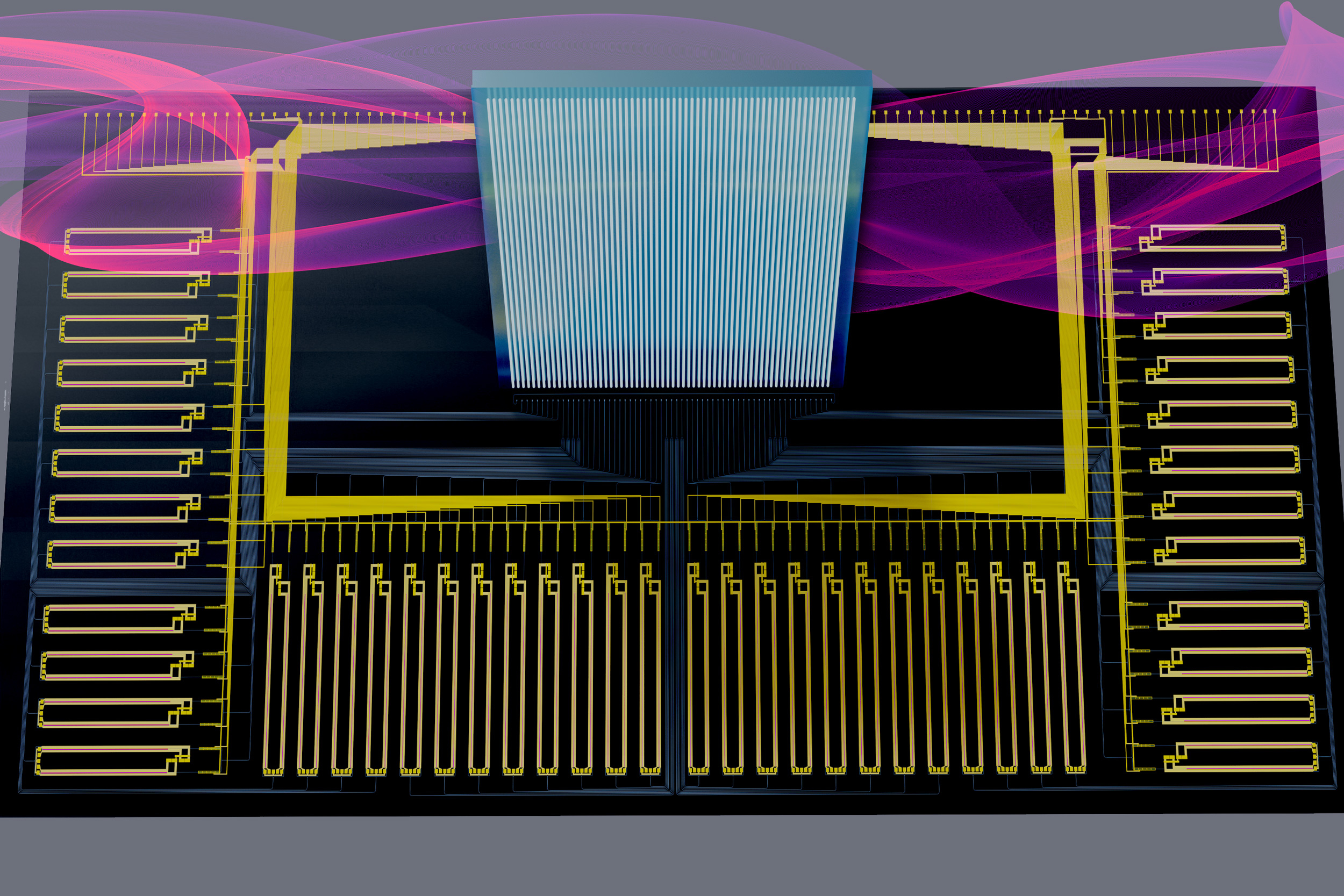

La arquitectura de red neuronal de Netcast que desarrollaron implica el almacenamiento de pesos en un servidor central conectado a un hardware novedoso llamado transceptor inteligente. Este transceptor inteligente, un chip del tamaño de un pulgar que puede recibir y enviar datos, utiliza una tecnología conocida como fotónica de silicio para extraer billones de pesos de la memoria cada segundo.

Recibe pesos como señales eléctricas y los impone a las ondas de luz. Dado que los datos de peso están codificados como bits (1 y 0), el transceptor los convierte cambiando los láseres; Un láser se enciende con un 1 y se apaga con un 0. Combina estas ondas de luz y luego las transmite periódicamente a través de una red de fibra óptica, por lo que un dispositivo cliente no tiene que sondear el servidor para recibirlas.

“La óptica es excelente porque hay muchas formas de transportar datos dentro de la óptica. Por ejemplo, puede superponer datos en diferentes colores de luz, y eso permite un rendimiento de datos y un ancho de banda mucho mayores que con la electrónica”, explica Bandyopadhyay.

trillones por segundo

Una vez que las ondas de luz llegan al dispositivo del cliente, utiliza un componente óptico simple conocido como modulador Mach-Zehnder de banda ancha para realizar cálculos analógicos súper rápidos. Los datos de entrada del dispositivo, como la información del sensor, se codifican en las pesas. Luego envía cada longitud de onda individual a un receptor, que detecta la luz y mide el resultado del cálculo.

Los investigadores idearon una forma de usar este modulador para realizar billones de multiplicaciones por segundo, lo que aumentó en gran medida la velocidad computacional en el dispositivo mientras consumía una pequeña cantidad de energía.

“Para hacer algo más rápido, tienes que hacerlo más eficiente energéticamente. Pero hay un compromiso. Hemos construido un sistema que puede funcionar con aproximadamente un milivatio de potencia, pero aún así realizar billones de multiplicaciones por segundo. Eso es una ganancia de órdenes de magnitud, tanto en términos de velocidad como de eficiencia energética”, dice Sludds.

Probaron esta arquitectura enviando pesos por una fibra de 86 kilómetros que conecta su laboratorio con el Laboratorio Lincoln del MIT. Netcast permitió el aprendizaje automático con alta precisión (98,7 % para la clasificación de imágenes y 98,8 % para el reconocimiento de dígitos) a velocidades vertiginosas.

“Tuvimos que calibrar algo, pero me sorprendió el poco trabajo que tuvimos que hacer para obtener una precisión tan alta de inmediato. Pudimos lograr una precisión comercialmente relevante”, agrega Hamerly.

En el futuro, los investigadores planean iterar el chip transceptor inteligente para lograr un rendimiento aún mejor. También quieren reducir el tamaño del receptor, que actualmente es del tamaño de una caja de zapatos, al tamaño de un solo chip para que pueda caber en un dispositivo inteligente como un teléfono celular.

«El uso de la fotónica y la luz como plataforma informática es un área de investigación realmente emocionante con implicaciones potencialmente enormes para la velocidad y la eficiencia de nuestro panorama de tecnología de la información», dice Euan Allen, investigador de la Royal Academy of Engineering en la Universidad de Bath. que no participó en este trabajo. “El trabajo de Sludds et al. es un paso emocionante hacia las implementaciones en el mundo real de tales dispositivos, que presenta un nuevo y práctico esquema de computación de borde y explora algunas de las limitaciones fundamentales de la computación a niveles de luz muy bajos (de un solo fotón)”.

La investigación está financiada en parte por NTT Research, la Fundación Nacional de Ciencias, la Oficina de Investigación Científica de la Fuerza Aérea, el Laboratorio de Investigación de la Fuerza Aérea y la Oficina de Investigación del Ejército.

[ad_2]