[ad_1]

La interpolación de cuadros es el proceso de sintetizar cuadros intermedios a partir de un conjunto dado de cuadros. La técnica se usa a menudo para el muestreo temporal para aumentar la velocidad de cuadros de video o crear efectos de cámara lenta. Hoy en día, con las cámaras digitales y los teléfonos inteligentes, a menudo tomamos varias fotos en unos pocos segundos para capturar la mejor imagen. La interpolación entre estas fotos «casi duplicadas» puede dar como resultado videos atractivos que revelan el movimiento de la escena y, a menudo, transmiten una sensación del momento aún más cómoda que las fotos originales.

La interpolación de fotogramas entre fotogramas de vídeo consecutivos, que a menudo muestran un pequeño movimiento, se ha estudiado ampliamente. Sin embargo, a diferencia de los videos, el intervalo de tiempo entre fotos casi duplicadas puede ser de varios segundos, con movimientos intermedios correspondientemente grandes, lo cual es una gran debilidad de los métodos de interpolación de cuadros existentes. Los métodos más nuevos intentan manejar grandes movimientos entrenando en conjuntos de datos de movimientos extremos, aunque con una efectividad limitada en movimientos más pequeños.

En PELÍCULA: Interpolación de cuadros para movimiento grande, lanzado en ECCV 2022, presentamos un método para crear videos en cámara lenta de alta calidad a partir de fotos casi duplicadas. FILM es una nueva arquitectura de red neuronal que logra resultados de última generación en movimientos grandes mientras maneja bien los movimientos pequeños.

|

| FILM interpola entre dos fotos casi duplicadas para crear videos en cámara lenta. |

Resumen del modelo FILM

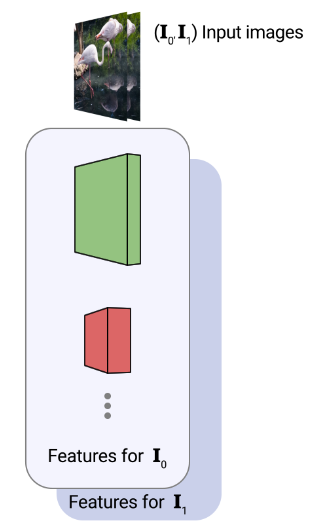

El modelo FILM toma dos imágenes como entrada y genera una imagen intermedia. En el momento de la inferencia, llamamos al modelo recursivamente para generar imágenes intermedias. FILM tiene tres componentes: (1) un extractor de características que resume cada imagen de entrada con características multiescala (pirámide) profundas; (2) un estimador de movimiento bidireccional que calcula el movimiento (es decir, los flujos) píxel por píxel en cada nivel de pirámide; y (3) un módulo de fusión que emite la imagen final interpolada. Entrenamos a FILM en trillizos de cuadros de video regulares, con el cuadro medio sirviendo como verdad de campo para la supervisión.

|

| Una extracción de pirámide de características estándar en dos imágenes de entrada. Las características se procesan en cada nivel mediante una serie de circunvoluciones, que luego se reducen a la mitad de la resolución espacial y se pasan como entrada al nivel inferior. |

Extracción de características independiente de la escala

Los movimientos grandes generalmente se manejan con una estimación de movimiento jerárquica utilizando pirámides de características de resolución múltiple (que se muestran arriba). Sin embargo, este método tiene problemas con objetos pequeños y de movimiento rápido, ya que pueden desaparecer en los niveles más profundos de la pirámide. Además, hay muchos menos píxeles disponibles para derivar una vigilancia de nivel más profundo.

Para superar estas limitaciones, utilizamos un extractor de rasgos que comparte pesos entre escalas para crear una pirámide de rasgos «independiente de la escala». Este extractor de características (1) permite utilizar un estimador de movimiento común en los niveles de la pirámide (siguiente sección), equiparando el movimiento grande en niveles poco profundos con el movimiento pequeño en niveles más profundos, y (2) crea una red compacta con menos pesos.

En particular, dadas dos imágenes de entrada, primero construimos una pirámide de imágenes reduciendo sucesivamente la resolución de cada imagen. A continuación, usamos un codificador convolucional U-Net compartido para extraer una pirámide de funciones más pequeña de cada nivel de pirámide de imagen (columnas en la figura a continuación). Como tercer y último paso, construimos una pirámide de características independiente de la escala mediante la concatenación horizontal de características de diferentes capas de convolución que tienen las mismas dimensiones espaciales. Observe que la pila de características se crea con el mismo conjunto de pesos de convolución compartidos (que se muestran en el mismo color) desde el tercer nivel en adelante. Esto asegura que todas las funciones sean similares, lo que nos permite compartir aún más los pesos en el estimador de movimiento posterior. La siguiente figura muestra este proceso usando cuatro niveles de pirámide, pero en la práctica usamos siete.

Estimación de flujo bidireccional

Después de la extracción de características, FILM realiza una estimación de flujo residual basada en pirámides para calcular los flujos desde la imagen central aún no pronosticada hasta las dos entradas. La estimación de flujo se realiza una vez para cada entrada, comenzando desde el nivel más profundo, utilizando una pila de convoluciones. Estimamos el flujo en un nivel dado agregando una corrección residual a la estimación de la muestra superior del siguiente nivel inferior. Este enfoque toma como entrada: (1) las características de la primera entrada en este nivel y (2) las características de la segunda entrada después de haber sido sesgada con la estimación de muestreo ascendente. Los mismos pesos de convolución se comparten en todos los niveles excepto en los dos niveles más finos.

Los pesos comunes permiten que los movimientos pequeños en niveles más profundos se interpreten como los mismos movimientos grandes en niveles poco profundos, lo que aumenta la cantidad de píxeles disponibles para monitorear movimientos grandes. Además, los pesos compartidos no solo permiten el entrenamiento de modelos de alto rendimiento que pueden lograr una mayor relación señal-ruido (PSNR), sino que también son necesarios para que los modelos encajen en la memoria GPU para aplicaciones prácticas.

|

|

| La influencia de la distribución del peso en la calidad de la imagen. Izquierda: sin compartir, Derecha: Separar. Para esta ablación, usamos una versión más pequeña de nuestro modelo (denominada FILM-med en la publicación) porque el modelo completo se desviaría sin la distribución del peso, ya que se perdería el beneficio de regularización de la distribución del peso. |

Fusión y generación de marcos

Una vez que se estiman los flujos bidireccionales, curvamos las dos pirámides de características para alinearlas. Obtenemos una pirámide de características concatenadas apilando los dos mapas de características alineados, los flujos bidireccionales y las imágenes de entrada en cada nivel de pirámide. Finalmente, un decodificador U-Net sintetiza la imagen de salida interpolada de la pirámide de características alineada y apilada.

|

| PELÍCULA Arquitectura. EXTRACCIÓN DE CARACTERÍSTICAS: Extraemos características independientes de la escala. Las características con colores coincidentes se extraen utilizando pesos comunes. ESTIMACIÓN DE FLUJO: Calculamos los flujos bidireccionales usando ponderaciones comunes en los niveles más profundos de la pirámide y sesgando las características en alineación. FUSIÓN: Un decodificador U-Net emite el cuadro interpolado final. |

funciones de pérdida

Durante el entrenamiento nos encargamos de CINE combinando tres pérdidas. En primer lugar, utilizamos la diferencia L1 absoluta entre los fotogramas reales predichos y los reales para capturar el movimiento entre los fotogramas de entrada. Sin embargo, esto da como resultado imágenes borrosas cuando se usa solo. En segundo lugar, utilizamos la pérdida de percepción para mejorar la fidelidad de la imagen. Esto minimiza la diferencia L1 entre las características VGG-19 previamente entrenadas de ImageNet extraídas de los marcos de verdad predichos y de tierra. En tercer lugar, usamos la pérdida de estilo para minimizar la diferencia L2 entre la matriz Gram de las funciones VGG-19 preentrenadas de ImageNet. La pérdida de estilo permite que la red produzca imágenes nítidas y pinturas realistas de grandes regiones preocluidas. Finalmente, las pérdidas se combinan con ponderaciones elegidas empíricamente de modo que cada pérdida contribuya por igual a la pérdida total.

Como se muestra a continuación, la pérdida combinada mejora significativamente la nitidez y la fidelidad de la imagen en comparación con la película de entrenamiento con pérdida L1 y pérdidas VGG. La pérdida combinada mantiene la nitidez de las hojas del árbol.

|

| Las funciones de pérdida combinadas de FILM. pérdida L1 (Izquierda), L1 más pérdida de VGG (centro) y pérdida de estilo (A la derecha), que muestra mejoras significativas en la nitidez (recuadro verde). |

Resultados de imagen y video

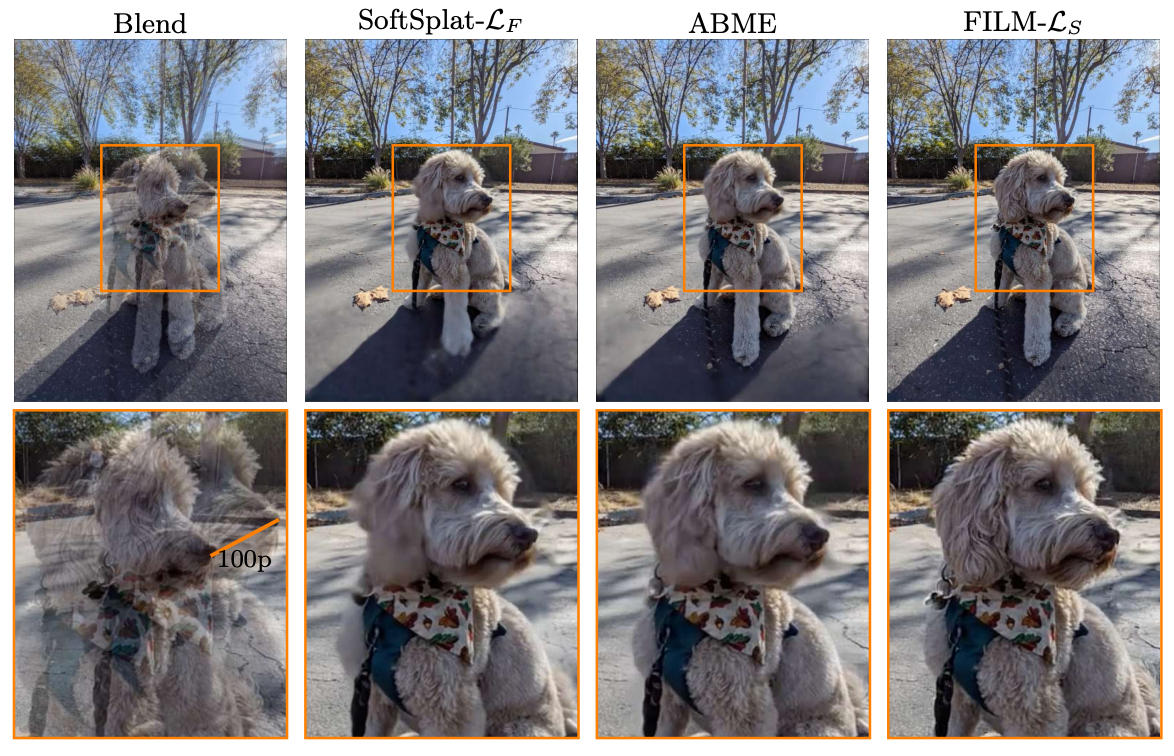

Evaluamos FILM utilizando un conjunto de datos interno con fotos casi duplicadas que muestran un gran movimiento de escena. Además, comparamos FILM con métodos de interpolación de fotogramas más nuevos: SoftSplat y ABME. FILM funciona bien cuando se interpola a través de grandes movimientos. Incluso con movimientos de hasta 100 píxeles, FILM produce imágenes nítidas que coinciden con las entradas.

|

| Interpolación de fotogramas con SoftSplat (Izquierda), ABME (centro) y PELÍCULA (A la derecha) con calidad de imagen favorable y consistencia temporal. |

|

|

| Gran interpolación de movimiento. arriba: Vídeo en cámara lenta de 64x. abajo (de izquierda a derecha): Las dos imágenes de entrada mezcladas, interpolación SoftSplat, interpolación ABME e interpolación FILM. FILM captura la cara del perro pero conserva los detalles del fondo. |

Conclusión

Presentamos FILM, una gran red neuronal de interpolación de fotogramas en movimiento. En esencia, FILM utiliza una pirámide de función independiente de la escala que distribuye pesos entre escalas, lo que nos permite construir un estimador de movimiento bidireccional «agnóstico de la escala» que aprende de fotogramas de movimiento normal y puede generalizarse bien a fotogramas de movimiento grande. Para manejar oclusiones amplias causadas por grandes movimientos de la escena, monitoreamos FILM haciendo coincidir la matriz Gram de las funciones VGG-19 preentrenadas de ImageNet, lo que da como resultado una pintura interior realista e imágenes nítidas. FILM funciona bien con movimientos grandes, pero también maneja bien movimientos pequeños y medianos, produciendo videos fluidos y de alta calidad.

Inténtalo tú mismo

Con el código fuente ahora disponible públicamente, puede probar FILM en sus fotos.

Gracias

Agradecemos a Eric Tabellion, Deqing Sun, Caroline Pantofaru y Brian Curless por sus contribuciones. Agradecemos a Marc Comino Trinidad por sus contribuciones al Scale-Agnostic Feature Extractor, Orly Liba y Charles Herrmann por sus comentarios sobre el texto, Jamie Aspinall por las imágenes del trabajo, Dominik Kaeser, Yael Pritch, Michael Nechyba, William T. Freeman, David Salesin, Catherine Wah e Ira Kemelmacher-Shlizerman por su apoyo. Muchas gracias a Tom Small por crear el gráfico animado en esta publicación.

[ad_2]