[ad_1]

La investigación en el campo del aprendizaje automático y la IA, ahora una tecnología clave en prácticamente todas las industrias y todas las empresas, es demasiado extensa para que alguien la lea en su totalidad. Esta columna, Perceptron, tiene como objetivo recopilar algunos de los descubrimientos y artículos recientes más relevantes, particularmente en inteligencia artificial, entre otros, y explicar por qué son importantes.

Un earable que utiliza un sonar para leer las expresiones faciales ha sido uno de los proyectos que nos ha llamado la atención en las últimas semanas. Lo mismo ocurre con ProcTHOR, un marco del Instituto Allen para la IA (AI2) que genera entornos de forma procesal que se pueden usar para entrenar robots del mundo real. Entre otras cosas, Meta ha creado un sistema de IA que puede predecir la estructura de una proteína basándose en una única secuencia de aminoácidos. Y los investigadores del MIT han desarrollado un nuevo hardware que, según afirman, proporcionará cálculos más rápidos para la IA utilizando menos energía.

El auricular, desarrollado por un equipo de Cornell, parece un par de auriculares gruesos. Los parlantes envían señales acústicas al costado de la cara del usuario, mientras que un micrófono capta los ecos apenas perceptibles creados por la nariz, los labios, los ojos y otras características faciales. Estos «perfiles de eco» permiten que Earable capture movimientos como levantar las cejas y mirar como flechas, que un algoritmo de IA traduce en expresiones faciales completas.

Autor de la foto: Cornell

El earable tiene algunas limitaciones. Solo dura tres horas con la energía de la batería y necesita descargar el procesamiento a un teléfono inteligente, y el algoritmo de IA de traducción de eco necesita entrenarse con 32 minutos de datos faciales antes de que pueda comenzar a reconocer las expresiones faciales. Pero los investigadores argumentan que es una experiencia mucho más optimizada que las grabadoras utilizadas tradicionalmente en la animación para películas, televisión y videojuegos. Por ejemplo, para el juego de misterio LA Noire, Rockstar Games construyó una plataforma con 32 cámaras dirigidas a la cara de cada actor.

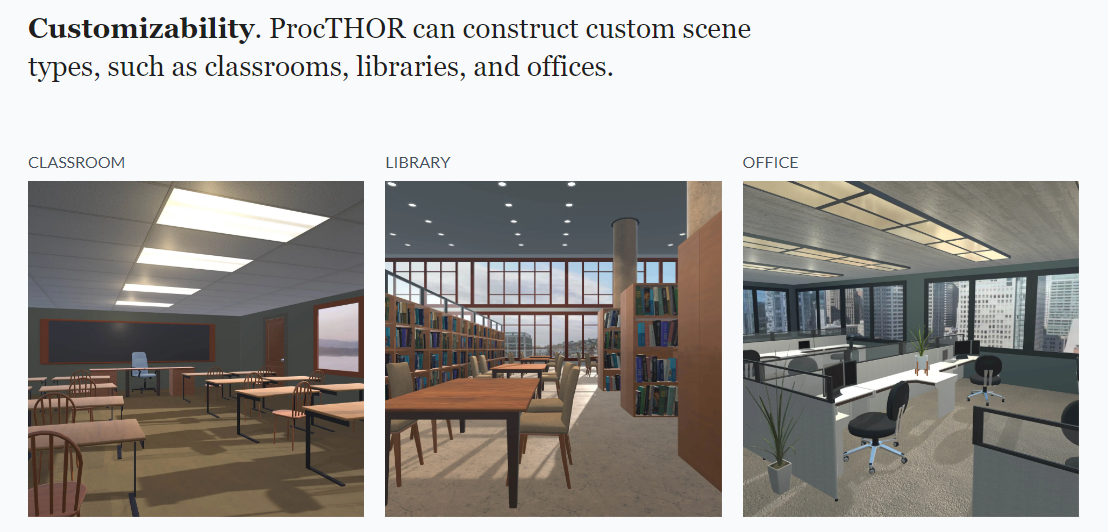

Quizás algún día Earable de Cornell se utilice para crear animaciones para robots humanoides. Pero estos robots primero deben aprender a navegar por una habitación. Afortunadamente, ProcTHOR de AI2 da un paso (sin juego de palabras) en esa dirección, creando miles de escenas personalizadas, que incluyen aulas, bibliotecas y oficinas, en las que los robots simulados deben completar tareas como recoger objetos y mover muebles.

La idea detrás de escena, que presenta iluminación simulada y contiene un subconjunto de una amplia gama de materiales de superficie (por ejemplo, madera, azulejos, etc.) y artículos para el hogar, es exponer a los robots simulados a la mayor variedad posible. Es una teoría establecida en IA que el rendimiento en entornos simulados puede mejorar el rendimiento de los sistemas reales; Las empresas de automóviles autónomos como Waymo de Alphabet están simulando vecindarios enteros para optimizar el comportamiento de sus automóviles en el mundo real.

Autor de la foto: Instituto Allen de Inteligencia Artificial

Con respecto a ProcTHOR, AI2 afirma en un artículo que escalar la cantidad de entornos de capacitación mejora constantemente el rendimiento. Esto es un buen augurio para los robots destinados a hogares, lugares de trabajo y otros lugares.

Por supuesto, entrenar este tipo de sistemas requiere mucha potencia informática. Pero ese puede no ser el caso para siempre. Investigadores del MIT dicen que han desarrollado un procesador «analógico» que se puede usar para crear redes súper rápidas de «neuronas» y «sinapsis», que a su vez se pueden usar para realizar tareas como reconocer imágenes, traducir de idiomas y más.

El procesador de los investigadores utiliza «resistencias protónicas programables» dispuestas en una matriz para «aprender» habilidades. Aumentar y disminuir la conductividad eléctrica de las resistencias imita el fortalecimiento y el debilitamiento de las sinapsis entre las neuronas del cerebro, parte del proceso de aprendizaje.

La conductividad está controlada por un electrolito que controla el movimiento de los protones. A medida que se empujan más protones en un canal en la resistencia, aumenta la conductancia. Cuando se eliminan los protones, la conductividad disminuye.

Procesador en una placa de circuito de computadora

Un material inorgánico, el vidrio de fosfosilicato, hace que el procesador del equipo del MIT sea extremadamente rápido porque contiene poros de tamaño nanométrico cuyas superficies proporcionan vías perfectas para la difusión de proteínas. Como beneficio adicional, el vidrio se puede operar a temperatura ambiente y las proteínas no lo dañarán a medida que se mueven a lo largo de los poros.

«Una vez que tiene un procesador analógico, ya no va a entrenar redes en las que todos los demás están trabajando», dijo el autor principal y postdoctorado del MIT, Murat Onen, en un comunicado de prensa. “Entrenarán redes de una complejidad sin precedentes que nadie más puede permitirse y, por lo tanto, las superarán con creces. En otras palabras, este no es un automóvil más rápido, es una nave espacial”.

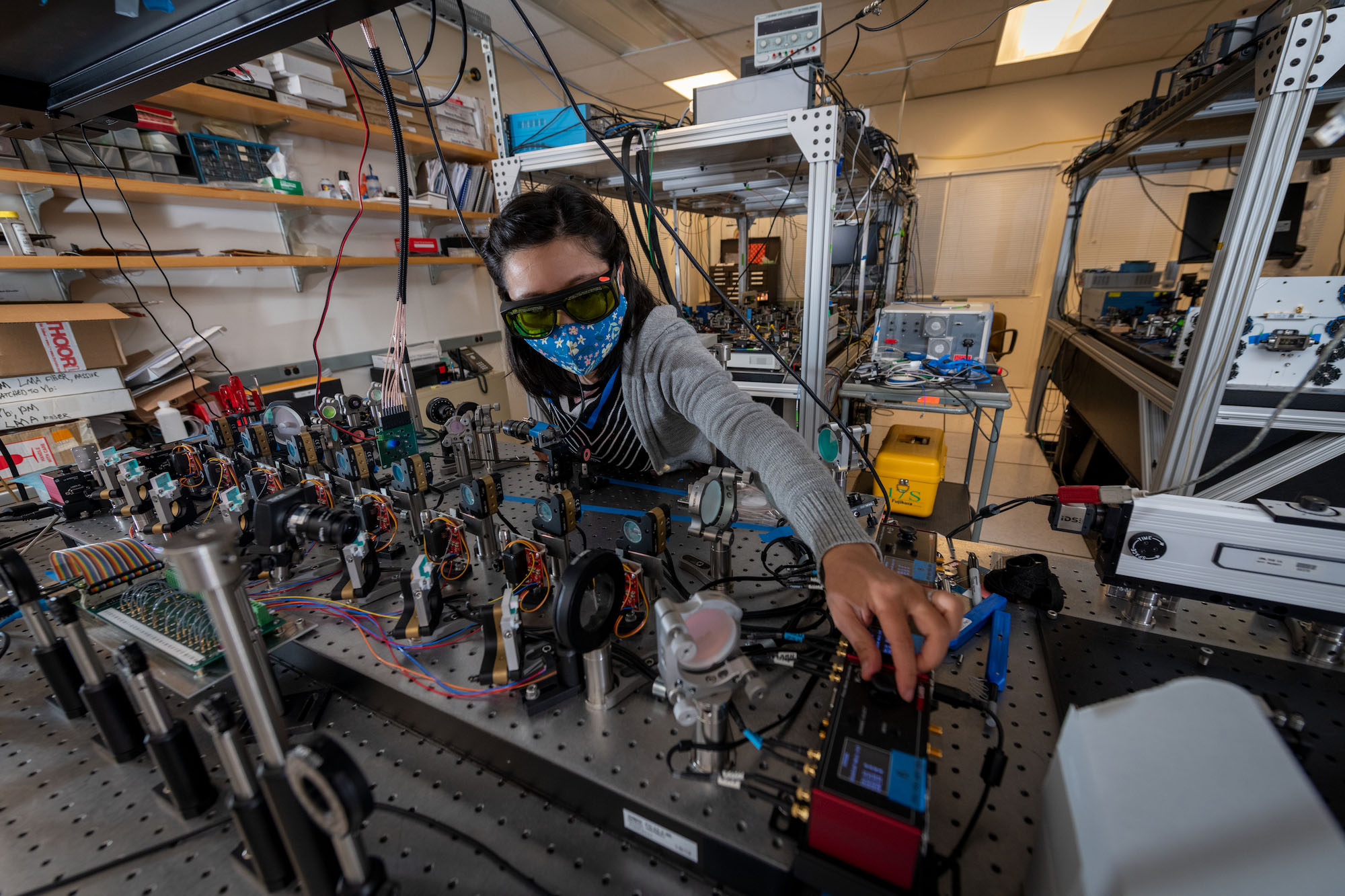

Hablando de aceleración, el aprendizaje automático ahora se está utilizando, al menos de forma experimental, para gestionar los aceleradores de partículas. En el Laboratorio Nacional Lawrence Berkeley, dos equipos han demostrado que la simulación basada en ML de toda la máquina y el chorro les brinda una predicción altamente precisa que es 10 veces mejor que el análisis estadístico ordinario.

Autor de la foto: Thor Swift/Laboratorio de Berkeley

«Si puede predecir las propiedades del haz con una precisión que supera su variabilidad, puede usar la predicción para aumentar el rendimiento del acelerador», dijo Daniele Filippetto del laboratorio. No es poca cosa simular toda la física y el equipo, pero, sorprendentemente, los primeros esfuerzos de los distintos equipos para hacerlo arrojaron resultados prometedores.

Y en el Laboratorio Nacional de Oak Ridge, una plataforma impulsada por IA les hace ejecutar una tomografía computarizada hiperespectral usando dispersión de neutrones para encontrar resultados óptimos… tal vez deberíamos dejar que ellos expliquen.

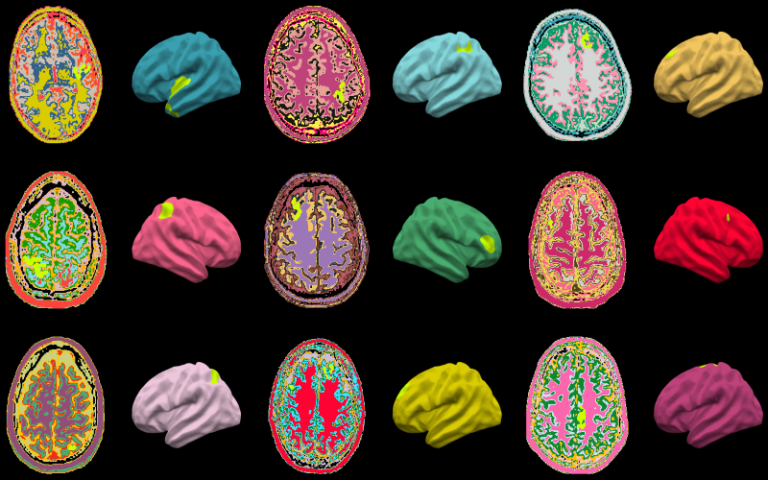

En el mundo médico, existe una nueva aplicación de análisis de imágenes basado en el aprendizaje automático en el campo de la neurología, donde investigadores del University College London han entrenado un modelo para detectar signos tempranos de lesiones cerebrales que causan epilepsia.

Resonancias magnéticas de cerebros utilizadas para entrenar el algoritmo UCL.

Una causa común de la epilepsia resistente a los medicamentos es lo que se conoce como displasia cortical focal, una región del cerebro que se ha desarrollado de manera anormal pero que, por alguna razón, no parece obvia en la resonancia magnética. La detección temprana puede ser extremadamente útil, por lo que el equipo de UCL entrenó un modelo de inspección de resonancia magnética llamado Detección de lesiones epilépticas multicéntricas en miles de muestras de regiones cerebrales sanas y afectadas por FCD.

El modelo pudo detectar dos tercios de los FCD mostrados, lo que en realidad es bastante bueno ya que las señales son muy sutiles. De hecho, se encontraron 178 casos en los que los médicos no pudieron localizar un FCD pero sí. Por supuesto, los especialistas tienen la última palabra, pero a veces una computadora que indica que algo anda mal es suficiente para mirar más de cerca y obtener un diagnóstico confiable.

“Nos esforzamos mucho en desarrollar un algoritmo de IA que sea interpretable y pueda ayudar a los médicos a tomar decisiones. Mostrar a los médicos cómo el algoritmo MELD hace sus predicciones fue una parte esencial de este proceso», dijo Mathilde Ripart de UCL.

[ad_2]