[ad_1]

Internet tuvo un momento colectivo para sentirse bien con el lanzamiento de DALL-E, un generador de imágenes basado en inteligencia artificial inspirado por el artista Salvador Dalí y el adorable robot WALL-E que usa lenguaje natural para producir cada imagen misteriosa y hermosa que crea en su deseos del corazón. Ver entradas escritas como «tuza sonriente sosteniendo un cono de helado» cobrando vida instantáneamente resonó claramente con el mundo.

No es una tarea fácil hacer que la ardilla sonriente y sus atributos aparezcan en tu pantalla. DALL-E 2 utiliza lo que se conoce como modelo de difusión, que intenta codificar todo el texto en una descripción para crear una imagen. Pero una vez que el texto tiene muchos más detalles, se vuelve difícil capturar todo en una sola descripción. Aunque son muy flexibles, a veces tienen problemas para comprender la composición de ciertos conceptos, como B. confundir los atributos o relaciones entre diferentes objetos.

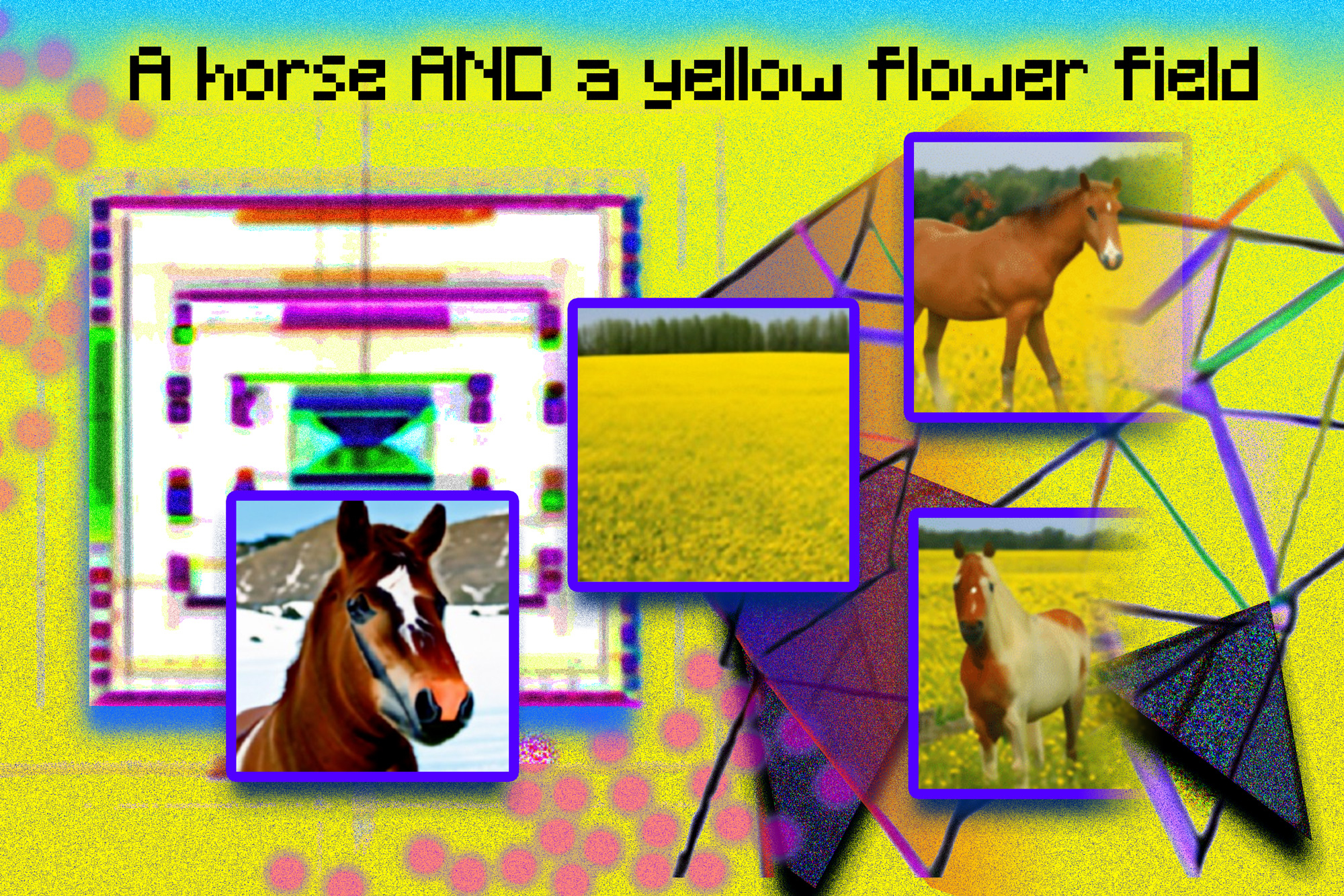

Para producir imágenes más complejas con una mejor comprensión, los científicos del Laboratorio de Ciencias de la Computación e Inteligencia Artificial (CSAIL) del MIT estructuraron el modelo típico desde un ángulo diferente: ensamblaron una serie de modelos, todos trabajando juntos para crear las imágenes deseadas que capturan varios aspectos requeridos por el texto de entrada o las etiquetas. Por ejemplo, para crear una imagen con dos componentes, descritos por dos conjuntos descriptivos, cada modelo abordaría un componente específico de la imagen.

Los modelos aparentemente mágicos detrás de la generación de imágenes funcionan proponiendo una serie de pasos de refinamiento iterativos para llegar a la imagen deseada. Comienza con una imagen «mala» y luego la refina progresivamente hasta convertirse en la imagen seleccionada. Al ensamblar varios modelos juntos, refinan la apariencia en cada paso, por lo que el resultado es una imagen que tiene todos los atributos de cada modelo. Al colaborar con múltiples modelos, puede lograr combinaciones mucho más creativas en las imágenes generadas.

Por ejemplo, tome un camión rojo y una casa verde. El modelo confundirá los conceptos de camión rojo y casa verde cuando estas frases se vuelvan muy complicadas. Un generador típico como el DALL-E 2 puede producir un camión verde y una casa roja, por lo que intercambia esos colores. El enfoque del equipo puede manejar esta forma de vincular atributos a objetos y, en particular, cuando hay varios grupos de cosas, puede manejar cada objeto con mayor precisión.

“El modelo puede modelar efectivamente las posiciones de los objetos y las descripciones relacionales, lo que plantea un desafío para los modelos de imágenes existentes. Por ejemplo, coloque un objeto y un cubo en una posición y una esfera en otra. DALL-E 2 es bueno para generar imágenes naturales, pero a veces tiene dificultades para comprender las relaciones de los objetos», dice Shuang Li, estudiante de doctorado en MIT CSAIL y coautor principal. “Más allá del arte y la creatividad, tal vez podríamos usar nuestro modelo para la enseñanza. Si quieres decirle a un niño que ponga un cubo en una pelota y si decimos esto en el idioma, puede ser difícil que lo entiendan. Pero nuestro modelo puede generar la imagen y mostrarla”.

Enorgullecer a Dalí

Composable Diffusion, el modelo del equipo, utiliza modelos de difusión junto con operadores de composición para combinar descripciones textuales sin más capacitación. El enfoque del equipo captura los detalles del texto con mayor precisión que el modelo de difusión original, que codifica directamente las palabras como una sola oración larga. Por ejemplo, dado «un cielo rosado» Y «una montaña azul en el horizonte» Y «flores de cerezo frente a la montaña», el modelo del equipo pudo producir exactamente esa imagen, mientras que el modelo de difusión original hizo que el cielo pareciera azul. y todo frente a las montañas rosadas.

“El hecho de que nuestro modelo sea componible significa que puedes aprender diferentes partes del modelo individualmente. Primero pueden aprender un objeto sobre otro, luego aprender un objeto a la derecha de otro y luego aprender algo a la izquierda de otro”, dice el coautor principal y estudiante graduado de MIT CSAIL, Yilun Du. «Como podemos escribir esto juntos, puede imaginar que nuestro sistema nos permite aprender gradualmente el lenguaje, las relaciones o el conocimiento, lo que creemos que es una dirección bastante interesante para el trabajo futuro».

Si bien demostró su capacidad para crear imágenes fotorrealistas complejas, aún enfrentó desafíos porque el modelo se entrenó en un conjunto de datos mucho más pequeño que aquellos como DALL-E 2, por lo que hubo algunos objetos que simplemente no pudo capturar.

Ahora que la difusión componible puede construirse sobre modelos generativos como DALL-E 2, los científicos quieren explorar el aprendizaje continuo como un posible próximo paso. Como generalmente se agrega más a las relaciones de objetos, quieren ver si los modelos de difusión pueden comenzar a «aprender» sin olvidar el conocimiento aprendido previamente, a un lugar donde el modelo puede generar imágenes tanto con el conocimiento previo como con el nuevo.

«Esta investigación propone un nuevo método para ensamblar conceptos en la generación de texto a imagen, no concatenándolos en un mensaje, sino calculando puntos con respecto a cada concepto y componiéndolos usando operadores de conjunción y negación», dice Mark Chen, co-creador. de DALL-E 2 e investigador científico en OpenAI. «Es una buena idea que aprovecha la interpretación basada en la energía de los modelos de difusión. viejas ideas aplicar la composicionalidad utilizando modelos basados en energía. El enfoque también es capaz de usar guías sin clasificadores y es sorprendente ver que supera la línea de base GLIDE en varios puntos de referencia de composición y puede producir cualitativamente tipos muy diferentes de generación de imágenes”.

“Los humanos pueden ensamblar escenas con diferentes elementos de innumerables maneras, pero esta tarea es un desafío para las computadoras”, dijo Bryan Russel, científico investigador de Adobe Systems. «Este trabajo propone una formulación elegante que ensambla explícitamente un conjunto de modelos de difusión para producir una imagen dada una indicación de lenguaje natural compleja».

Junto a Li y Du, los coautores principales del artículo son Nan Liu, estudiante de posgrado en informática de la Universidad de Illinois en Urbana-Champaign, y los profesores del MIT Antonio Torralba y Joshua B. Tenenbaum. Presentarán la obra en 2022 Congreso Europeo de Visión por Computador.

La investigación fue apoyada por Raytheon BBN Technologies Corp., Mitsubishi Electric Research Laboratory y DEVCOM Army Research Laboratory.

[ad_2]