[ad_1]

(noticias nanowerk) Un algoritmo de reconocimiento de imágenes de inteligencia artificial (IA) puede predecir si un mouse se está moviendo o no utilizando datos de imágenes cerebrales funcionales. Los investigadores de la Universidad de Kobe también han desarrollado un método para identificar qué datos de entrada son relevantes, arrojando luz sobre la caja negra de la IA que tiene el potencial de contribuir a la tecnología de interfaz cerebro-máquina.

Para crear interfaces cerebro-máquina, es necesario comprender cómo se relacionan entre sí las señales cerebrales y las acciones afectadas. Esto se llama «descodificación neuronal» y la mayoría de las investigaciones en esta área se realizan utilizando la actividad eléctrica de las células cerebrales medida mediante electrodos implantados en el cerebro.

Por otro lado, las tecnologías de imágenes funcionales, como la resonancia magnética funcional o las imágenes de calcio, pueden monitorear todo el cerebro y visualizar regiones cerebrales activas a través de datos proxy. De los dos, la obtención de imágenes de calcio es más rápida y ofrece mejor resolución espacial. Sin embargo, estas fuentes de datos siguen sin explotar para los esfuerzos de decodificación neuronal.

Un obstáculo particular es la necesidad de preprocesar los datos, por ejemplo eliminando el ruido o identificando una región de interés, lo que dificulta el desarrollo de un método general para la decodificación neuronal de muchos comportamientos diferentes.

AJIOKA Takehiro, estudiante de medicina de la Universidad de Kobe, utilizó la experiencia interdisciplinaria del equipo dirigido por el neurocientífico TAKUMI Toru para abordar este problema.

“Nuestra experiencia con sistemas de seguimiento de movimiento e imágenes en tiempo real basados en realidad virtual para ratones y técnicas de aprendizaje profundo nos permitió explorar métodos de aprendizaje profundo “de extremo a extremo”, lo que significa que no requieren preprocesamiento ni requisitos específicos. funciones. y así evaluar la información de toda la corteza para la decodificación neuronal”, dice Ajioka.

Combinaron dos algoritmos diferentes de aprendizaje profundo, uno para patrones espaciales y otro para patrones temporales, con datos de películas de toda la corteza de ratones descansando o corriendo en una cinta, y entrenaron su modelo de IA para predecir con precisión, basándose en los datos de imágenes de la corteza, si el mouse se está moviendo o descansando.

en el diario Biología Computacional PLoS (“End-to-End Deep Learning Approach to Classify Mouse Behaviour Usando Cortex-Wide Calcium Imaging”), investigadores de la Universidad de Kobe informan que su modelo tiene un 95% de precisión en la predicción del verdadero estado de comportamiento del animal, sin que esto requiera eliminar el ruido o predefinir un área de interés. Es más, su modelo realizó estas predicciones precisas basándose en solo 0,17 segundos de datos, lo que significa que pudieron alcanzar velocidades casi en tiempo real. Esto también funcionó para cinco personas diferentes, lo que demuestra que el modelo pudo filtrar características individuales.

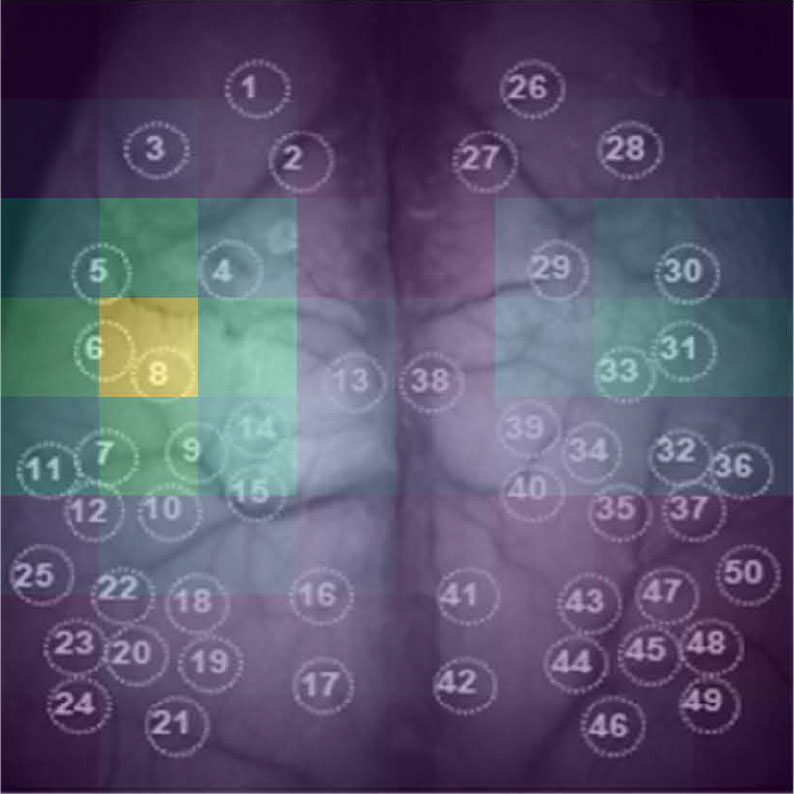

Luego, los neurocientíficos determinaron qué partes de los datos de la imagen eran las principales responsables de la predicción eliminando partes de los datos y observando el rendimiento del modelo en ese estado. Cuanto peor era la predicción, más importantes se volvían los datos. «Esta capacidad de nuestro modelo para identificar regiones corticales críticas para la clasificación del comportamiento es particularmente interesante porque abre la tapa al aspecto de 'caja negra' de las técnicas de aprendizaje profundo», explica Ajioka.

En general, el equipo de la Universidad de Kobe estableció una técnica generalizable para identificar estados de comportamiento a partir de datos de imágenes funcionales de toda la corteza y desarrolló una técnica para identificar en qué partes de los datos se basan las predicciones. Ajioka explica por qué esto es relevante. «Esta investigación sienta las bases para un mayor desarrollo de interfaces cerebro-máquina que permitan la decodificación del comportamiento casi en tiempo real utilizando imágenes cerebrales no invasivas».

[ad_2]