[ad_1]

(noticias nanowerk) Un equipo de investigación dirigido por los físicos Prof. Wolfram Pernice y Prof. Martin Salinga, así como por el informático Prof. Benjamin Risse, todos de la Universidad de Münster, ha desarrollado la llamada arquitectura basada en eventos, que utiliza procesadores fotónicos. Al igual que en el cerebro, esto permite que las conexiones dentro de la red neuronal se ajusten continuamente.

Las tesis centrales

Investigación

Los modelos informáticos modernos (por ejemplo, para aplicaciones de IA complejas y potentes) llevan los procesos informáticos digitales tradicionales al límite. Las nuevas arquitecturas informáticas que imitan los principios de funcionamiento de las redes neuronales biológicas prometen un procesamiento de datos más rápido y con mayor eficiencia energética.

Un equipo de investigadores ha desarrollado la llamada arquitectura basada en eventos. Los procesadores fotónicos se utilizan para transportar y procesar datos utilizando la luz. Al igual que en el cerebro, esto permite que las conexiones dentro de la red neuronal se ajusten continuamente. Estas conexiones cambiantes son la base de los procesos de aprendizaje.

En el estudio participó un equipo del Centro de Investigación Colaborativa 1459 (“Materia Inteligente”) formado por los físicos Prof. Wolfram Pernice y Prof. Martin Salinga, así como el informático Prof. Benjamin Risse, todos de la Universidad de Münster. investigadores de las Universidades de Exeter y Oxford Reino Unido.

El estudio fue publicado en la revista científica. Avances científicos (“Red neuronal óptica adaptativa impulsada por eventos”).

Una red neuronal en el aprendizaje automático requiere neuronas artificiales que se activen mediante señales de excitación externas y tengan conexiones con otras neuronas. Las conexiones entre estas neuronas artificiales se llaman sinapsis, al igual que en el caso del original biológico.

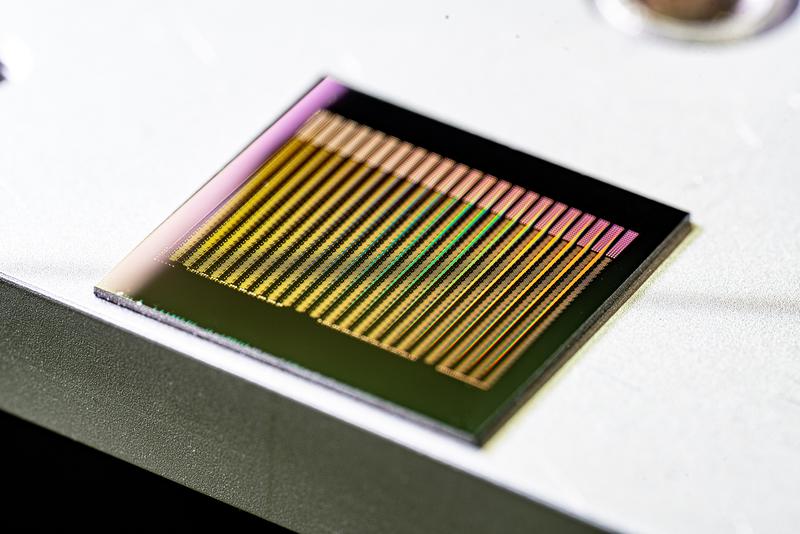

Para su estudio, los investigadores de Münster utilizaron una red de casi 8.400 neuronas ópticas hechas de material de cambio de fase acoplado a guías de ondas y demostraron que la conexión entre dos de estas neuronas puede fortalecerse o debilitarse (plasticidad sináptica) y que se pueden crear nuevas conexiones. los formados o existentes pueden romperse (plasticidad estructural).

A diferencia de otros estudios similares, las sinapsis no eran elementos de hardware, sino que estaban codificadas por las propiedades de los impulsos ópticos, es decir, por la respectiva longitud de onda e intensidad del impulso óptico. Esto permitió integrar y conectar ópticamente varios miles de neuronas en un solo chip.

En comparación con los procesadores electrónicos tradicionales, los procesadores basados en la luz ofrecen un ancho de banda significativamente mayor y permiten realizar tareas informáticas complejas con un menor consumo de energía. Este nuevo enfoque consiste en investigación básica.

«Nuestro objetivo es desarrollar una arquitectura de computación óptica que permita calcular aplicaciones de IA de forma rápida y energéticamente eficiente a largo plazo», afirma Frank Brückerhoff-Plückelmann, uno de los autores principales.

Metodología: El material de cambio de fase no volátil se puede cambiar entre una estructura amorfa y una estructura cristalina con una red atómica altamente ordenada. Esta función permite el almacenamiento permanente de datos incluso sin fuente de alimentación. Los investigadores probaron el rendimiento de la red neuronal entrenándola para distinguir entre textos en alemán e inglés mediante un algoritmo evolutivo. Utilizaron el número de vocales del texto como parámetro de reconocimiento.

[ad_2]