[ad_1]

Imagine el sonido de los acordes de un órgano de tubos haciendo eco a través del santuario cavernoso de una enorme catedral de piedra.

El sonido que escucha un visitante de la catedral se ve afectado por muchos factores, incluida la posición del órgano, dónde se encuentra el oyente, si hay pilares, bancos u otros obstáculos en el medio, de qué están hechas las paredes, la ubicación de las ventanas o puertas, etc. Oír un ruido puede ayudar a alguien a visualizar su entorno.

Investigadores del MIT y del MIT-IBM Watson AI Lab están investigando el uso de información acústica espacial para ayudar a las máquinas a visualizar mejor su entorno. Desarrollaron un modelo de aprendizaje automático que puede capturar cómo cada sonido en una habitación se propaga a través del espacio, lo que permite que el modelo simule lo que un oyente escucharía en diferentes lugares.

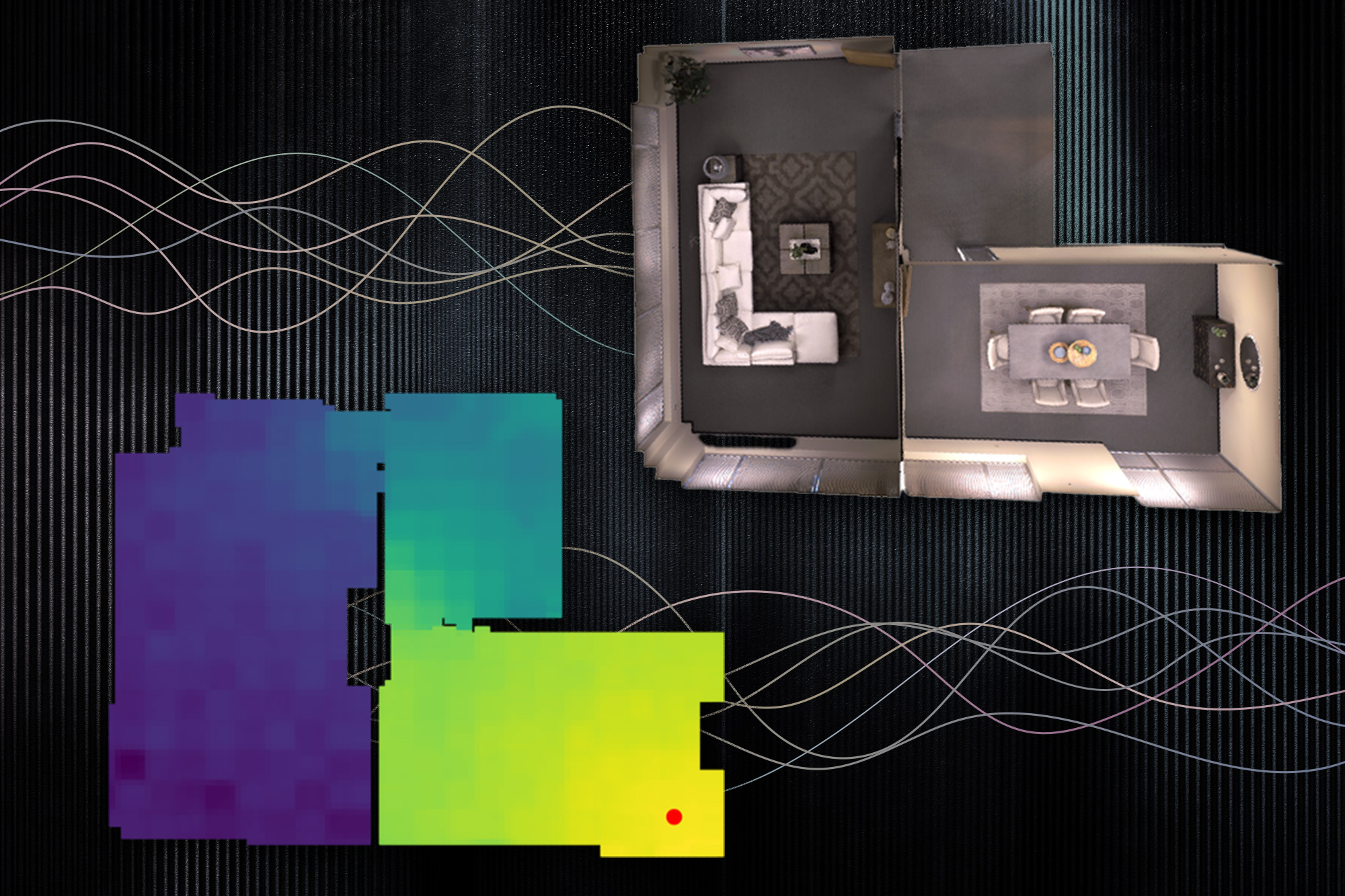

Al modelar con precisión la acústica de una escena, el sistema puede aprender la geometría 3D subyacente de una habitación a partir de grabaciones de audio. Los investigadores pueden usar la información acústica capturada por su sistema para crear representaciones visuales precisas de un espacio, de forma muy similar a cómo los humanos usan el sonido para estimar las propiedades de su entorno físico.

Además de sus aplicaciones potenciales en realidad virtual y aumentada, esta técnica podría ayudar a los agentes de inteligencia artificial a desarrollar una mejor comprensión del mundo que los rodea. Por ejemplo, al modelar las propiedades acústicas del sonido en su entorno, un robot de exploración submarina podría percibir cosas que están más lejos de lo que permitiría la mera visión, dice Yilun Du, estudiante de doctorado en la Facultad de Ingeniería Eléctrica y Ciencias de la Computación (EECS) y coautor de un artículo que describe el modelo.

“Hasta ahora, la mayoría de los investigadores solo se han centrado en modelar la visión. Pero como humanos, tenemos cognición multimodal. No solo es importante la vista, también lo es el sonido. Creo que este trabajo abre una emocionante dirección de investigación para usar mejor el sonido para modelar el mundo”, dice Du.

Junto a usted en el artículo están el autor principal Andrew Luo, estudiante graduado de la Universidad Carnegie Mellon (CMU); Michael J. Tarr, Profesor Kavčić Moura de Ciencias Cognitivas y Cerebrales en CMU; y los autores principales Joshua B. Tenenbaum, profesor de Desarrollo de Carrera Paul E. Newton de Ciencias Cognitivas y Computación en el Departamento de Cerebro y Ciencias Cognitivas del MIT y miembro del Laboratorio de Ciencias de la Computación e Inteligencia Artificial (CSAIL); Antonio Torralba, Catedrático de Ingeniería Eléctrica e Informática de Delta Electronics y miembro del CSAIL; y Chuang Gan, investigador principal del MIT-IBM Watson AI Lab. Los resultados de la investigación se presentarán en la Conferencia sobre Sistemas de Procesamiento de Información Neural.

sonido e imagen

En la investigación de la visión por computadora, se ha utilizado un tipo de modelo de aprendizaje automático llamado modelo de representación neuronal implícita para producir reconstrucciones suaves y continuas de escenas 3D a partir de imágenes. Estos modelos utilizan redes neuronales, que contienen capas de nodos interconectados, o neuronas, que procesan datos para completar una tarea.

Los investigadores del MIT usaron el mismo tipo de modelo para capturar cómo el sonido se propaga continuamente a través de una escena.

Pero descubrieron que los modelos de visión se benefician de una propiedad conocida como consistencia fotométrica que no se aplica al sonido. Si miras el mismo objeto desde dos lugares diferentes, el objeto se ve más o menos igual. Pero para el sonido, cambias de ubicación y el sonido que escuchas puede ser totalmente diferente debido a los obstáculos, la distancia, etc. Esto hace que predecir el audio sea muy difícil.

Los investigadores superaron este problema incorporando dos propiedades de la acústica en su modelo: la naturaleza recíproca del sonido y la influencia de las características geométricas locales.

El sonido es recíproco, lo que significa que cuando la fuente de un sonido y el oyente intercambian posiciones, lo que la persona escucha permanece sin cambios. Además, lo que uno escucha en un área dada está fuertemente influenciado por las especificidades locales, tales como: B. un obstáculo entre el oyente y la fuente de sonido.

Para incorporar estos dos factores en su modelo, llamado campo acústico neuronal (NAF), aumentan la red neuronal con una cuadrícula que captura objetos y características arquitectónicas en la escena, como puertas o paredes. El modelo muestrea aleatoriamente puntos en esta cuadrícula para aprender las características en ubicaciones específicas.

“Si te imaginas parado cerca de una puerta, lo que escuchas influye más fuertemente en la presencia de esa puerta, no necesariamente las características geométricas lejos de ti al otro lado de la habitación. Descubrimos que esta información permite una mejor generalización que una red simple y completamente conectada», dice Luo.

Desde la predicción de ruido hasta la visualización de escenas

Los investigadores pueden alimentar la NAF con información visual sobre una escena y algunos espectrogramas que muestran cómo sonaría una pieza de audio cuando el emisor y el oyente están en ubicaciones de destino en el espacio. Luego, el modelo predice cómo sonaría ese audio a medida que el oyente se mueve a cualquier punto de la escena.

El NAF emite una respuesta de impulso que captura cómo debe cambiar un sonido a medida que se propaga a través de la escena. Luego, los investigadores aplican esta respuesta de impulso a diferentes sonidos para escuchar cómo deberían cambiar esos sonidos cuando una persona camina por una habitación.

Por ejemplo, si una canción se reproduce desde un altavoz en el medio de una habitación, su modelo mostraría cómo ese sonido se hace más fuerte a medida que una persona se acerca al altavoz y luego se apaga cuando camina hacia un pasillo adyacente.

Cuando los investigadores compararon su técnica con otros métodos que modelan información acústica, siempre produjeron modelos de sonido más precisos. Y debido a que aprendió información geométrica local, su modelo pudo generalizarse a nuevas ubicaciones en una escena mucho mejor que otros métodos.

Además, descubrieron que aplicar la información acústica que aprende su modelo a un modelo de visualización por computadora puede conducir a una mejor reconstrucción visual de la escena.

“Por ejemplo, si solo tiene unas pocas vistas, estas características acústicas pueden ayudarlo a capturar los límites con mayor nitidez. Y tal vez eso se deba a que, para representar con precisión la acústica de una escena, debe capturar la geometría 3D subyacente de esa escena», dice Du.

Los investigadores planean mejorar aún más el modelo para que pueda generalizarse a escenas completamente nuevas. También quieren aplicar esta técnica a respuestas de impulso más complejas y escenas más grandes, como edificios completos o incluso una ciudad.

«Esta nueva técnica podría abrir nuevas posibilidades para crear una experiencia inmersiva multimodal en la aplicación Metaverse», agrega Gan.

“Mi grupo ha trabajado mucho utilizando métodos de aprendizaje automático para acelerar la simulación acústica o modelar la acústica de escenas reales. Este artículo de Chuang Gan y sus coautores es claramente un gran paso en esa dirección», dice Dinesh Manocha, profesor Paul Chrisman Iribe de Ciencias de la Computación e Ingeniería Eléctrica e Informática en la Universidad de Maryland, quien no participó en el trabajo. . “Específicamente, este artículo presenta una buena representación implícita que puede capturar cómo el sonido puede propagarse en escenas reales al modelarlo con un sistema lineal invariable en el tiempo. Este trabajo puede tener muchas aplicaciones en AR/VR, así como en la comprensión de escenas reales”.

Este trabajo cuenta con el apoyo parcial del MIT-IBM Watson AI Lab y el Tianqiao and Chrissy Chen Institute.

[ad_2]