[ad_1]

En la conferencia GTC AI 2024 de Nvidia, la compañía presentó la muy esperada plataforma Blackwell. La plataforma consta de una nueva unidad de procesamiento de gráficos (GPU) considerada como el “chip más potente del mundo”, el sistema de escala en rack GB200 NVL72 y un conjunto de herramientas de inteligencia artificial de nivel empresarial. Los principales proveedores de servicios en la nube han anunciado planes para utilizar Blackwell para continuar desarrollando servicios innovadores de inteligencia artificial generativa, aprendizaje profundo y computación basada en la nube.

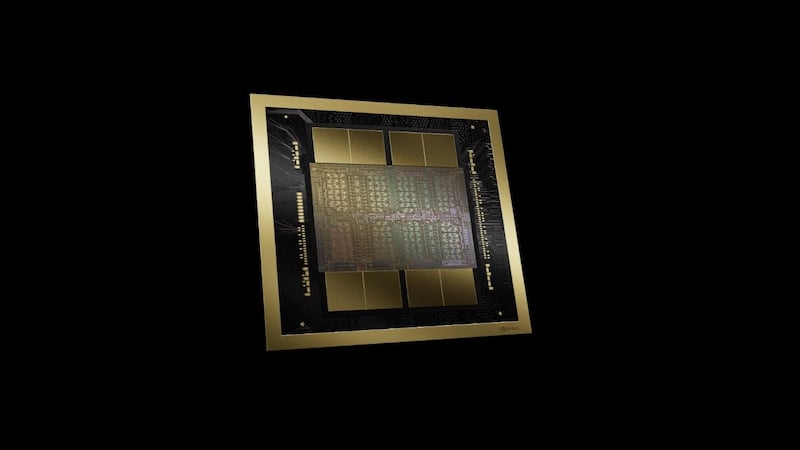

GPU Blackwell en dos chips con HBM3e en chip.

En 2012, AlexNet lanzó el auge de la IA basada en GPU con un modelo informático con 60 millones de parámetros. Los modelos actuales superan los 10 billones de parámetros: un asombroso aumento de 160.000 veces en complejidad, sin un final a la vista. Blackwell es la respuesta de Nvidia a esta dramática espiral ascendente en la demanda informática en 2024, con GPU de múltiples matrices, CPU de coprocesamiento e interconexiones a escala de terabytes.

Nvidia presenta la GPU Blackwell de 208 mil millones de transistores

Nvidia diseñó la GPU Blackwell para que sea la GPU más grande del mundo diseñada específicamente para IA generativa a escala de centros de datos. Tiene una eficiencia energética 25 veces mejor que los chips GPU de la generación anterior de Nvidia. La Arquitectura Blackwell recibió su nombre en honor a David Harold Blackwell, un estadístico y matemático que se especializó en teoría de juegos, teoría de probabilidad y estadística y fue el primer erudito negro incluido en la Academia Nacional de Ciencias. Esta arquitectura sigue la arquitectura Hopper, el último buque insignia de IA de Nvidia.

La GPU consta de dos chips conectados por un enlace de 10 TB/s (terabytes por segundo) para crear una única GPU de doble chip. No hace mucho, los límites de la retícula (un tamaño máximo dictado por limitaciones ópticas) eran un obstáculo importante para el avance de los chips de computadora de alto rendimiento. Los sistemas de interconexión ultrarrápidos han eliminado este límite y las GPU de arquitectura Blackwell aprovechan dichas interconexiones. En total, la GPU consta de 208 mil millones de transistores fabricados en un nodo de proceso personalizado de TSMC.

Blackwell: construido sobre la base de seis innovaciones

La arquitectura Blackwell (descripción técnica vinculada) presenta seis innovaciones clave, que se describen a continuación.

superchip de IA

Nvidia ve a Blackwell como una nueva clase de superchip de IA con un rendimiento que supera todo lo que Nvidia o los desarrolladores de procesadores de la competencia hayan ofrecido anteriormente. Esta afirmación está respaldada por otras cinco innovaciones de GPU.

Motor transformador de segunda generación.

Las GPU Blackwell se basan en el motor Transformer de segunda generación de Nvidia, que utiliza una arquitectura Tensor Core personalizada combinada con las innovaciones TensorRT-LLM y NeMo Framework. El motor de procesamiento resultante acelera la inferencia y el entrenamiento de LLM y MoE. Los nuevos núcleos tensoriales agregan modelos de precisión adicionales y formatos de microescala definidos por la comunidad para una mayor precisión con modelos de punto flotante de cuatro bits (FP4) y modelos de tamaño y rendimiento 2X.

IA segura

Blackwell aborda la creciente necesidad de seguridad avanzada con Nvidia Confidential Computing, una tecnología que aprovecha una sólida seguridad basada en hardware para evitar el acceso no autorizado. Es el primer entorno de ejecución confiable para GPU habilitadas para E/S (TEE-I/O). TEE-I/O actúa como una capa de seguridad de hardware junto con la innovación número cuatro, Nvlink y el conmutador Nvlink de quinta generación.

Nvlink y conmutador Nvlink

La computación a exaescala con modelos de IA de billones de parámetros depende tanto de la comunicación como de la computación. Ninguna GPU funciona sola y la capacidad de comunicarse es fundamental para la informática de IA moderna. La tecnología Nvlink es la solución de Nvidia para interconexiones de GPU y permite clústeres de hasta 576 procesadores. El chip del conmutador Nvlink ofrece un ancho de banda de GPU de 130 TB/s en un dominio de 72 GPU (NVL72) y una interconexión de clúster de 1,8 TB/s.

Máquina de descompresión

Las GPU Blackwell funcionan con una CPU Hopper para acelerar el procesamiento de datos masivos. El motor de descompresión proporciona un ancho de banda bidireccional de 900 GB/s para consultas de bases de datos completamente canalizadas en múltiples formatos de compresión, como LZ4, Deflate y Snappy.

Motor RAS (fiabilidad, disponibilidad y capacidad de servicio).

El procesamiento y la comunicación pueden ser el núcleo de la IA, pero la tolerancia a fallos y la gestión predictiva son igualmente importantes para ofrecer resultados fiables. RAS de Nvidia identifica y señala las fuentes de problemas mediante el monitoreo continuo de miles de puntos de datos de hardware y software.

El superchip Blackwell GB200 y el servidor NVL72

Implementado para obtener el máximo rendimiento, el superchip GB200 incluye dos GPU Blackwell y una CPU Nvidia Grace. Cuenta con hasta 384 GB de memoria 3e de alto ancho de banda (HBM3e) en chip con un ancho de banda de memoria de hasta 16 TB/s. Se pueden conectar varios GB200 en forma de clúster utilizando los nuevos Ethernet Quantum X800 y Spectrum X800 de Nvidia a velocidades de hasta 800 GB/s.

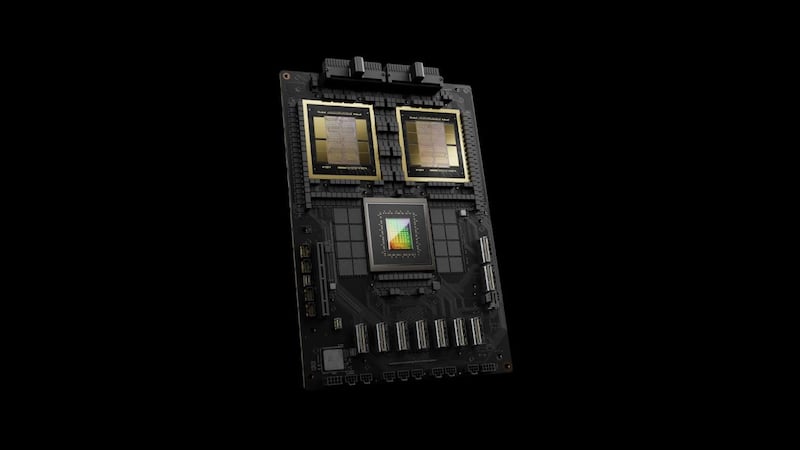

Súper chip GB200 con dos GPU Blackwell y una CPU Grace.

Nvidia también presentó su versión del rack de servidores, el GB200 NVL72. El sistema de servidor combina 36 superchips GB200 (para un total de 72 GPU) en un chasis refrigerado por líquido. El GB200 NVL72 actúa como una única GPU, con un aumento de 30 veces en el rendimiento y una reducción de 25 veces en el costo total de propiedad (TCO) en comparación con el servidor de la generación anterior de Nvidia, el H100.

El servidor GB200 NVL72 con hasta 36 superchips GB200.

No faltan socios

No sorprende que la mayor parte de la industria de centros de datos y de inteligencia artificial se haya unido a Blackwell. Nvidia fue pionera en GPU para procesamiento masivo en paralelo y continúa innovando. Google/Alphabet espera utilizar Blackwell a medida que avanza hacia la IA en su plataforma en la nube y su iniciativa Deepmind. Amazon, socio de Nvidia desde hace mucho tiempo, integrará Blackwell en AWS. Nvidia, a su vez, continuará desarrollando el Proyecto Ceiba, un proyecto de investigación de inteligencia artificial y redes avanzadas, junto con Amazon. Dell, Facebook/Meta, Microsoft, OpenAI, Oracle y Tesla también han anunciado planes para integrar Blackwell en sus iniciativas de IA.

Todas las imágenes utilizadas son cortesía de Nvidia.

[ad_2]