[ad_1]

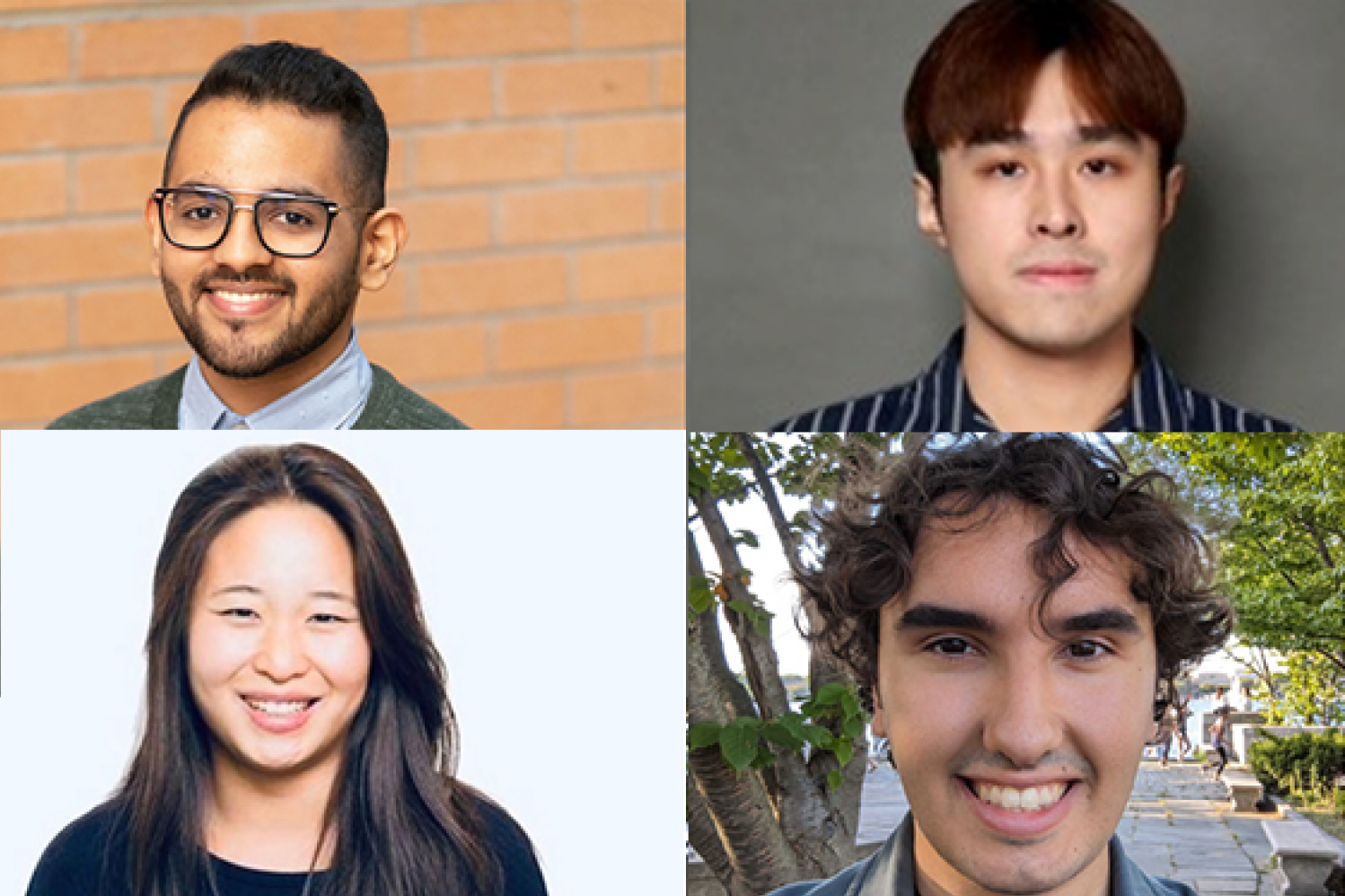

Para que el lenguaje natural sea una forma eficaz de comunicación, las partes involucradas deben poder comprender las palabras y su contexto, asumir que el contenido se compartirá en gran medida de buena fe y confianza, comentar sobre la información compartida y luego aplicarla a situaciones reales. -escenarios mundiales. Los estudiantes graduados del MIT que realizan prácticas en el MIT-IBM Watson AI Lab (Athul Paul Jacob SM ’22, Maohao Shen SM ’23, Victor Butoi y Andi Peng SM ’23) están trabajando para comprender cada paso de este proceso, que se realiza de forma natural. El lenguaje está anclado para abordar modelos para que los sistemas de inteligencia artificial puedan ser más confiables y precisos para los usuarios.

Para lograr esto, la investigación de Jacob se remonta al núcleo de los modelos de lenguaje natural existentes para mejorar los resultados utilizando la teoría de juegos. Sus intereses, dice, son dobles: “Uno es comprender el comportamiento de las personas utilizando la lente de los sistemas multiagente y la comprensión del lenguaje, y el otro es: ‘¿Cómo se puede utilizar eso como información para desarrollar una mejor IA?’ ¿Sistemas?’”. Su trabajo surge del juego de mesa “Diplomacia”, en el que su equipo de investigación desarrolló un sistema que podía aprender y predecir el comportamiento humano y negociar estratégicamente para lograr un resultado óptimo deseado.

“Fue un juego en el que hay que generar confianza; Hay que comunicarse con el lenguaje. «También tienes que jugar contra otros seis jugadores al mismo tiempo, lo cual es muy diferente de las tareas a las que se enfrentaba la gente en el pasado», dice Jacob, refiriéndose a otros juegos como el póquer y el GO que los investigadores están transfiriendo a sistemas neuronales. redes. “Hubo muchos desafíos de investigación. Uno de ellos fue: «¿Cómo se modela a las personas? ¿Cómo se sabe si las personas tienden a actuar irracionalmente?» Jacob y sus mentores de investigación, incluidos el profesor asociado Jacob Andreas y el profesor asistente Gabriele Farina del Departamento de Ingeniería Eléctrica e Informática del MIT. Science (EECS) y el MIT-IBM Watson Yikang Shen de AI Lab – replantean el problema de la generación del lenguaje como un juego de dos jugadores.

Utilizando modelos «generadores» y «discriminadores», el equipo de Jacob desarrolló un sistema de lenguaje natural para generar respuestas a preguntas, luego observar las respuestas y determinar si son correctas. Si este es el caso, el sistema de IA recibe un punto; si no, no se otorga ningún punto. Se sabe que los modelos de lenguaje son propensos a sufrir alucinaciones, lo que los hace menos dignos de confianza; Este algoritmo de aprendizaje sin arrepentimiento utiliza conjuntamente un modelo de lenguaje natural y garantiza que las respuestas del sistema sean más veraces y confiables, al mismo tiempo que mantiene las soluciones cercanas a las prioridades del modelo de lenguaje previamente entrenado. Jacob dice que usar esta técnica junto con un modelo de lenguaje más pequeño probablemente podría hacerla competitiva con el mismo rendimiento de un modelo muchas veces más grande.

Una vez que un modelo de lenguaje genera un resultado, lo ideal es que los investigadores quieran que la confianza en su generación coincida con su precisión. Sin embargo, esto no suele ser el caso. Pueden ocurrir alucinaciones si el modelo informa una confianza alta cuando debería ser baja. Maohao Shen y su grupo, con sus mentores Gregory Wornell, profesor de ingeniería Sumitomo en EECS, y los investigadores del laboratorio de investigación de IBM Subhro Das, Prasanna Sattigeri y Soumya Ghosh, pretenden abordar este problema mediante la cuantificación de la incertidumbre (UQ). «Nuestro proyecto tiene como objetivo calibrar modelos lingüísticos cuando están mal calibrados», afirma Shen. En concreto, se trata del problema de clasificación. Para hacer esto, Shen tiene un modelo de lenguaje que genera texto libre, que luego se convierte en una tarea de clasificación de opción múltiple. Por ejemplo, podrían pedirle al modelo que resuelva un problema matemático y luego preguntarle si la respuesta que genera es correcta, p. B. “Sí, no o tal vez”. Esto ayuda a determinar si el modelo tiene exceso o falta de confianza.

Para automatizar esto, el equipo desarrolló una técnica que ayuda a optimizar el resultado de confianza de un modelo de lenguaje previamente entrenado. Los investigadores entrenaron un modelo auxiliar utilizando información real sobre el terreno para que su sistema pudiera corregir el modelo de lenguaje. «Si su modelo confía demasiado en su predicción, podemos detectarlo y hacerlo menos confiable y viceversa», explica Shen. El equipo evaluó su técnica en varios conjuntos de datos de referencia populares para mostrar qué tan bien se traduce en tareas desconocidas para recalibrar la precisión y confiabilidad de las predicciones del modelo de lenguaje. «Después del entrenamiento, puedes simplemente conectar esta técnica y aplicarla a nuevas tareas sin mayor supervisión», dice Shen. «Lo único que necesitas son los datos para esta nueva tarea».

Victor Butoi también está mejorando las capacidades de modelado, pero en cambio su equipo de laboratorio, que incluye a John Guttag, profesor Dugald C. Jackson de Ciencias de la Computación e Ingeniería Eléctrica en EECS; los investigadores de laboratorio Leonid Karlinsky y Rogerio Feris de IBM Research; y los socios de laboratorio Hilde Kühne de la Universidad de Bonn y Wei Lin de la Universidad Tecnológica de Graz, están desarrollando técnicas que permiten que los modelos de lenguaje visual piensen en lo que ven y diseñan indicaciones para desbloquear nuevas habilidades de aprendizaje y comprender frases clave.

El razonamiento compositivo es sólo otro aspecto del proceso de toma de decisiones que imponemos a los modelos de aprendizaje automático para ayudarlos a ser útiles en situaciones del mundo real, explica Butoi. «Hay que ser capaz de pensar en los problemas de forma composicional y resolver subtareas», dice Butoi. «Por ejemplo, si dices que la silla está a la izquierda de la persona, tienes que reconocer tanto la silla como a la persona. Tienes que entender las instrucciones». Y una vez que el modelo entiende «izquierda», eso es lo que el equipo de investigación quiere El modelo es capaz de responder otras preguntas sobre la “izquierda”.

Sorprendentemente, los modelos de lenguaje visual no razonan bien con la composición, explica Butoi, pero puedes ayudarlos usando un modelo que pueda, por así decirlo, «guiar al testigo». El equipo desarrolló un modelo optimizado utilizando una técnica llamada Adaptación de bajo rango de modelos de lenguaje grandes (LoRA) y se entrenó en un conjunto de datos anotado llamado Visual Genome, que contiene objetos en una imagen y flechas que representan relaciones como marcar direcciones. En este caso, al modelo LoRA entrenado se le pediría que dijera algo sobre las relaciones «izquierdistas», y este resultado del título se usaría para proporcionar contexto y estimular el modelo visión-lenguaje, convirtiéndolo en una «tarea significativamente más fácil». dice Butoi .

En el mundo de la robótica, los sistemas de inteligencia artificial también interactúan con su entorno mediante la visión y el habla por computadora. Los entornos pueden variar desde almacenes hasta casas particulares. Andi Peng y sus mentores Julie Shah, profesora HN Slater de ingeniería aeroespacial en el MIT, y Chuang Gan del laboratorio y la Universidad de Massachusetts en Amherst se centran en ayudar a las personas con limitaciones físicas mediante el uso de mundos virtuales. Con este fin, el grupo de Peng está desarrollando dos modelos de IA incorporados (un «humano» que necesita apoyo y un agente auxiliar) en un entorno simulado llamado ThreeDWorld. El equipo se centra en las interacciones entre humanos y robots y utiliza prioridades semánticas capturadas por grandes modelos de lenguaje para ayudar a la IA de asistencia a inferir, utilizando medios naturales, qué habilidades el agente «humano» puede no ser capaz de realizar y qué motivación hay un lenguaje detrás de las acciones de “humanos”. El equipo tiene como objetivo fortalecer la toma de decisiones secuencial, la comunicación bidireccional y la capacidad del socorrista para comprender la escena física y cuál es la mejor manera de contribuir.

«Mucha gente piensa que los programas de IA deberían ser autónomos, pero creo que una parte importante del proceso es que queremos construir robots y sistemas para humanos e impartir conocimiento humano», dice Peng. “No queremos que un sistema haga algo de forma extraña; Queremos que lo hagan de una manera humana que podamos entender”.

[ad_2]