[ad_1]

Figura 1: Comportamiento gradual en el aprendizaje autosupervisado. Al entrenar algoritmos SSL comunes, encontramos que la pérdida disminuye gradualmente (arriba a la izquierda) y las incorporaciones aprendidas aumentan iterativamente en dimensionalidad (abajo a la izquierda). La visualización directa de las incrustaciones (derecha; se muestran las tres direcciones PCA superiores) confirma que las incrustaciones se reducen inicialmente a un punto, que luego se expande simultáneamente con pasos en la pérdida a una variedad 1D, una variedad 2D y más allá.

Se cree ampliamente que el éxito abrumador del aprendizaje profundo se debe en parte a su capacidad para descubrir y extraer representaciones útiles de datos complejos. El aprendizaje autosupervisado (SSL) se ha convertido en un marco líder para aprender estas representaciones de imágenes directamente a partir de datos sin etiquetar, de forma similar a cómo los LLM aprenden representaciones de voz directamente a partir de texto extraído de la web. Sin embargo, a pesar del papel clave de SSL en modelos de vanguardia como CLIP y MidJourney, faltan respuestas fundamentales a preguntas fundamentales como «¿Qué aprenden realmente los sistemas de imágenes autosupervisados?» y «¿Cómo ocurre realmente este aprendizaje?».

Nuestro artículo actual (que se publicará en ICML 2023) presenta lo que proponemos. la primera imagen matemática convincente del proceso de formación de métodos SSL a gran escala. Nuestro modelo teórico simplificado, que resolvemos exactamente, aprende aspectos de los datos en una serie de pasos discretos y bien separados. Luego mostramos que este comportamiento se puede observar en muchos sistemas actuales de última generación. Este descubrimiento abre nuevas vías para mejorar los métodos SSL y permite un conjunto completamente nuevo de preguntas científicas que, si se responden, proporcionarán una perspectiva poderosa para comprender algunos de los sistemas de aprendizaje profundo más importantes de la actualidad.

fondo

Aquí nos centramos en los métodos SSL de incrustación comunes (un superconjunto de métodos contrastivos) que aprenden representaciones que obedecen a criterios de invariancia de vista. La función de pérdida de estos modelos incluye un término que impone incrustaciones apropiadas para «vistas» semánticamente equivalentes de una imagen. Sorprendentemente, este enfoque simple produce representaciones poderosas en tareas de imágenes, incluso cuando las vistas son tan simples como recortes aleatorios y ruido de color.

Teoría: aprendizaje paso a paso en SSL con modelos linealizados

Primero describimos un modelo SSL lineal con solución exacta en el que tanto las trayectorias de entrenamiento como las incorporaciones finales se pueden escribir en forma cerrada. En particular, encontramos que el aprendizaje de representación se divide en una serie de pasos discretos: el rango de incorporaciones comienza pequeño y aumenta iterativamente en un proceso de aprendizaje paso a paso.

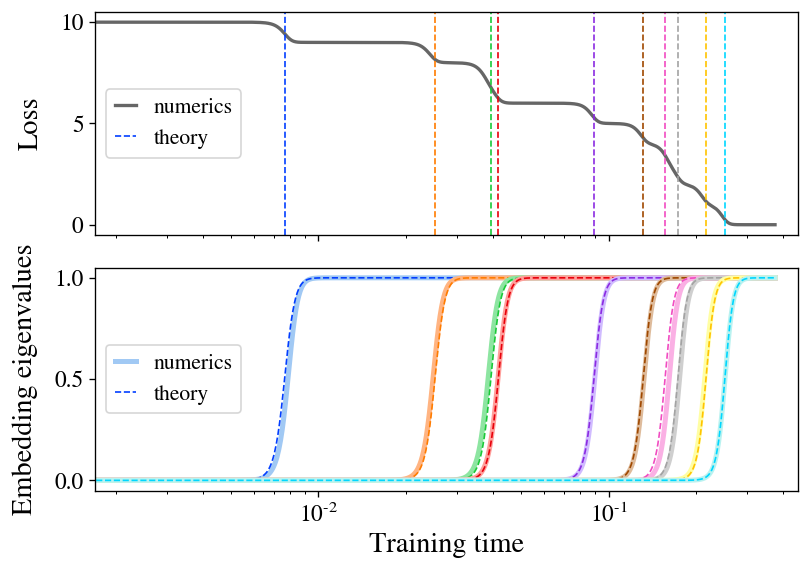

La principal contribución teórica de nuestro trabajo es resolver con precisión la dinámica de entrenamiento de la función de pérdida gemela de Barlow bajo flujo gradiente para el caso especial de un modelo lineal \(\mathbf{f}(\mathbf{x}) = \mathbf{W )}\mathbf{x}\). Para resumir nuestros resultados aquí: Encontramos que con una inicialización pequeña, el modelo aprende representaciones que están compuestas exactamente por las \(d\) direcciones propias superiores de la de rasgo Matriz de correlación cruzada \(\boldsymbol{\Gamma} \equiv \mathbb{E}_{\mathbf{x},\mathbf{x}’} [ \mathbf{x} \mathbf{x}’^T ]\). Además, encontramos que estas direcciones propias se aprenden uno después del otro en una secuencia de pasos de aprendizaje discretos en momentos determinados por sus correspondientes valores propios. La Figura 2 ilustra este proceso de aprendizaje, mostrando tanto el crecimiento de una nueva dirección en la función representada como la disminución resultante de la pérdida en cada paso de aprendizaje. Como ventaja adicional, encontramos una ecuación de forma cerrada para las incorporaciones finales aprendidas por el modelo tras la convergencia.

Figura 2: El aprendizaje paso a paso aparece en un modelo SSL lineal. Entrenamos un modelo lineal con pérdida de Barlow Twins en una pequeña muestra de CIFAR-10. La pérdida (arriba) desciende en forma de escalera, con tiempos de paso bien predichos por nuestra teoría (líneas discontinuas). Los valores propios incorporados (abajo) aparecen uno tras otro y corresponden en gran medida a la teoría (curvas discontinuas).

Nuestro hallazgo de aprendizaje incremental es una manifestación del concepto más amplio de sesgo espectralÉsta es la observación de que muchos sistemas de aprendizaje con dinámicas aproximadamente lineales prefieren aprender direcciones propias con valores propios más altos. Esto se ha estudiado ampliamente recientemente en el caso del aprendizaje supervisado estándar, donde se encontró que los modos propios con valores propios más altos se aprenden más rápido durante el entrenamiento. Nuestro trabajo encuentra resultados análogos para SSL.

La razón por la que un modelo lineal merece un estudio cuidadoso es que las redes neuronales suficientemente amplias también exhiben dinámicas de parámetros lineales, como lo muestra la línea de trabajo Neural Tangent Kernel (NTK). Este hecho es suficiente para extender nuestra solución de modelo lineal a redes neuronales amplias (o incluso a cualquier máquina central). En este caso, el modelo aprende preferentemente las direcciones propias \(d\) superiores de un operador determinado en el contexto de NTK. El estudio del NTK ha proporcionado muchos conocimientos sobre el entrenamiento y la generalización incluso de redes neuronales no lineales, lo que es una indicación de que algunos de los conocimientos que hemos obtenido pueden ser transferibles a casos realistas.

Experimento: aprendizaje paso a paso en SSL con ResNets

Como experimentos principales, entrenamos varios métodos SSL líderes con codificadores ResNet-50 completos y, sorprendentemente, descubrimos que vemos claramente este patrón de aprendizaje gradual incluso en entornos realistas, lo que sugiere que este comportamiento es fundamental para el comportamiento de aprendizaje SSL.

Para ver el aprendizaje incremental con ResNets en configuraciones realistas, todo lo que necesitamos hacer es ejecutar el algoritmo y rastrear los valores propios de la matriz de covarianza incorporada a lo largo del tiempo. En la práctica, ayuda a enfatizar el comportamiento gradual, también entrenar a partir de una inicialización de parámetros que es más pequeña de lo normal y entrenar con una tasa de aprendizaje pequeña. Por lo tanto, usaremos estas modificaciones en los experimentos de los que hablamos aquí y discutiremos el caso estándar en nuestro artículo.

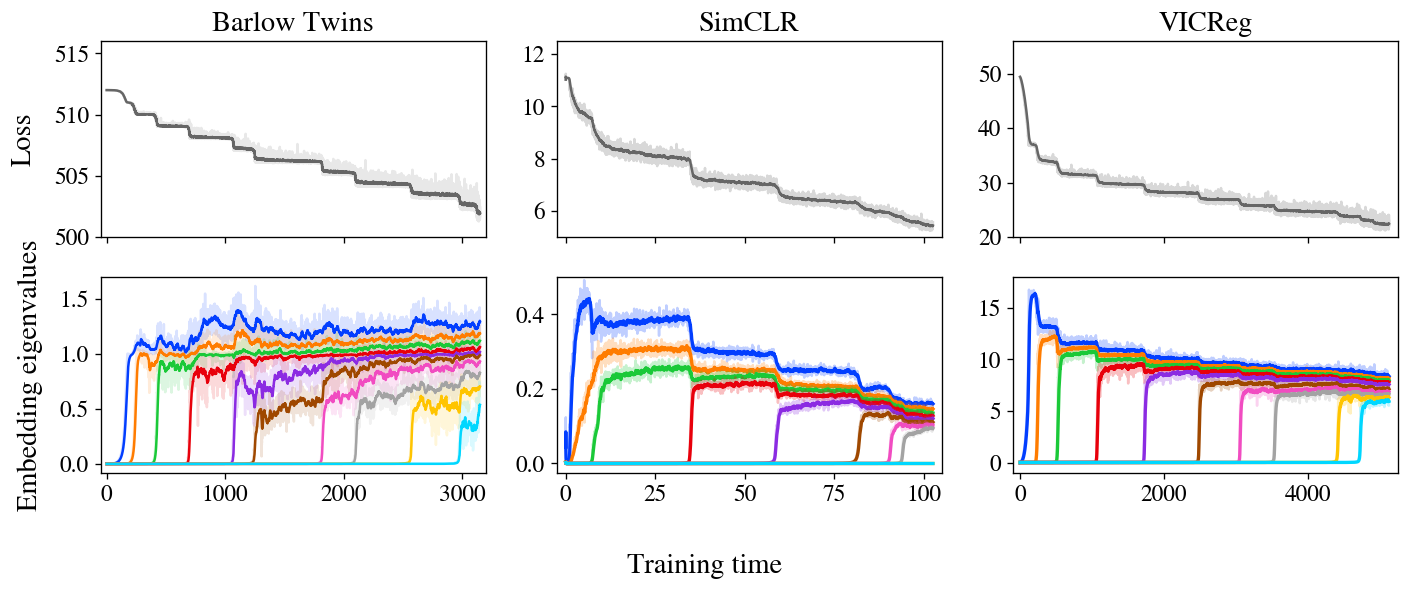

Figura 3: El aprendizaje incremental es evidente en Barlow Twins, SimCLR y VICReg. La pérdida y la incorporación de los tres métodos muestran un aprendizaje gradual, y las incorporaciones ganan importancia de forma iterativa, como lo predice nuestro modelo.

La Figura 3 muestra las pérdidas y la incorporación de valores propios de covarianza para tres métodos SSL (Barlow Twins, SimCLR y VICReg) entrenados en el conjunto de datos STL-10 con extensiones estándar. Notable, los tres muestran un aprendizaje gradual muy claro, donde la pérdida disminuye en una curva de escalera y un nuevo valor propio de cero aumenta con cada paso adicional. También mostramos un zoom animado de los primeros pasos de los gemelos Barlow en la Figura 1.

Vale la pena señalar que, si bien estos tres métodos son bastante diferentes a primera vista, desde hace algún tiempo se sospecha en el folclore que hacen algo similar bajo el capó. En particular, estos y otros métodos SSL integrados compartidos logran un rendimiento similar en tareas de referencia. El desafío, entonces, es identificar el comportamiento común subyacente a estos diferentes métodos. Gran parte del trabajo teórico previo se ha centrado en las similitudes analíticas en sus funciones de pérdida, pero nuestros experimentos sugieren un principio unificador diferente: Todos los métodos SSL aprenden incorporaciones para una dimensión y agregan nuevas dimensiones de forma iterativa en orden de importancia.

En un último experimento incipiente pero prometedor, comparamos las incorporaciones del mundo real aprendidas utilizando estos métodos con predicciones teóricas calculadas a partir del NTK después del entrenamiento. No solo encontramos una buena concordancia entre la teoría y el experimento dentro de cada método, sino que también comparamos diferentes métodos y descubrimos que diferentes métodos aprenden incorporaciones similares, lo que respalda aún más la idea de que estos métodos, en última instancia, hacen cosas similares y pueden unificarse.

Por qué es importante

Nuestro trabajo pinta una imagen teórica básica del proceso mediante el cual los métodos SSL ensamblan representaciones aprendidas a lo largo del curso de la formación. Ahora que tenemos una teoría, ¿qué podemos hacer con ella? Creemos que esta imagen respaldará la práctica de SSL desde una perspectiva técnica y permitirá una mejor comprensión de SSL y quizás un aprendizaje de representación más amplio.

Desde una perspectiva práctica, el entrenamiento de modelos SSL es notoriamente lento en comparación con el entrenamiento supervisado, y se desconoce el motivo de esta diferencia. Nuestro panorama de entrenamiento sugiere que el entrenamiento SSL tarda mucho en converger porque los modos propios posteriores tienen constantes de tiempo largas y tardan mucho en crecer significativamente. Si la imagen es correcta, acelerar el entrenamiento sería tan simple como enfocar selectivamente el gradiente en pequeñas direcciones propias incrustadas para llevarlas al nivel de las demás, lo que en principio se puede lograr con una simple modificación de la función de pérdida o del optimizador. . Analizamos estas opciones con más detalle en nuestro artículo.

Desde el punto de vista científico, el marco de SSL como proceso iterativo permite plantear muchas preguntas sobre los modos propios individuales. ¿Son más útiles los que se aprenden primero que los que se aprenden después? ¿Cómo cambian las diferentes extensiones los modos aprendidos? ¿Depende esto del método SSL utilizado? ¿Podemos asignar contenido semántico a (subconjuntos de) formas propias arbitrarias? (Hemos descubierto, por ejemplo, que los primeros modos aprendidos a veces representan funciones bien interpretables, como el tono y la saturación promedio de una imagen). Si otras formas de aprendizaje de representaciones convergen en representaciones similares, un hecho que es fácilmente verificable, entonces respuestas Estas preguntas dadas pueden tener implicaciones que se extienden al aprendizaje profundo de manera más amplia.

En general, somos optimistas sobre las perspectivas de trabajo futuro en este ámbito. El aprendizaje profundo sigue siendo un importante enigma teórico, pero creemos que nuestros resultados aquí proporcionan una base útil para futuros estudios sobre el comportamiento del aprendizaje profundo en redes.

Esta publicación se basa en el artículo «Sobre la naturaleza gradual del aprendizaje autosupervisado», que es un trabajo colaborativo con Maksis Knutins, Liu Ziyin, Daniel Geisz y Joshua Albrecht. Este trabajo se realizó con General Intelligent, donde Jamie Simon es investigador asociado. Esta publicación de blog está publicada aquí. Estaremos encantados de recibir sus preguntas o comentarios.

[ad_2]