[ad_1]

(noticias nanowerk) Una prótesis del habla desarrollada por un equipo de neurocientíficos, neurocirujanos e ingenieros de Duke puede traducir las señales cerebrales de una persona en lo que está tratando de decir.

Las tesis centrales

Investigación

Publicado en la revista comunicación de la naturaleza (“Las grabaciones neuronales de alta resolución mejoran la precisión de la decodificación del habla”), la nueva tecnología podría algún día ayudar a las personas que no pueden hablar debido a trastornos neurológicos a recuperar la capacidad de comunicarse a través de una interfaz cerebro-computadora.

«Muchos pacientes sufren trastornos motores debilitantes como ELA (esclerosis lateral amiotrófica) o síndrome de enclaustramiento, que pueden afectar su capacidad para hablar», dijo Gregory Cogan, Ph.D., profesor de neurología en la Facultad de Medicina de la Universidad de Duke y a de los principales investigadores involucrados en el proyecto. «Pero las herramientas disponibles actualmente para permitirles comunicarse son generalmente muy lentas y engorrosas».

Imagínate escuchar un audiolibro a media velocidad. Esta es la mejor velocidad de decodificación de voz disponible actualmente, que ronda las 78 palabras por minuto. Sin embargo, los humanos hablamos unas 150 palabras por minuto.

El retraso entre la velocidad del lenguaje hablado y decodificado se debe en parte a los relativamente pocos sensores de actividad cerebral que pueden montarse en una fina pieza de material que se encuentra en la superficie del cerebro. Menos sensores proporcionan información menos descifrable para decodificar.

Para superar las limitaciones anteriores, Cogan se asoció con Jonathan Viventi, Ph.D., miembro de la facultad del Instituto Duke de Ciencias del Cerebro, cuyo laboratorio de ingeniería biomédica se especializa en la fabricación de sensores cerebrales flexibles, ultrafinos y de alta densidad.

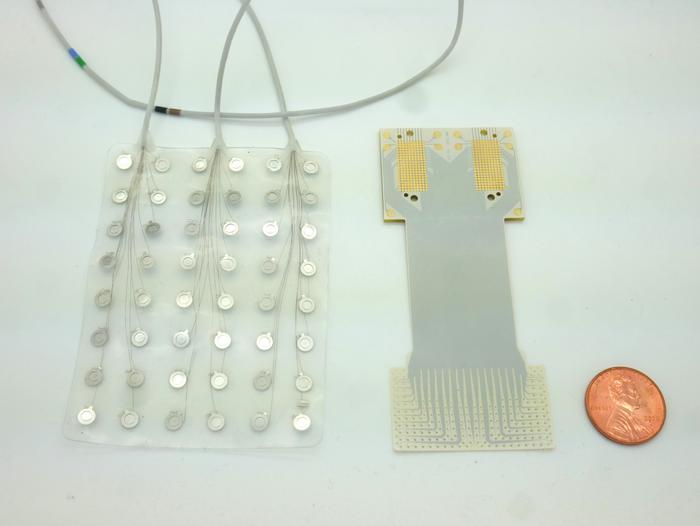

Para este proyecto, Viventi y su equipo empaquetaron la impresionante cantidad de 256 sensores cerebrales microscópicos en una pieza de plástico flexible de grado médico del tamaño de un sello postal. Las neuronas que están a sólo un grano de arena de distancia pueden tener patrones de actividad completamente diferentes a la hora de coordinar el habla. Por lo tanto, es necesario distinguir las señales de las células cerebrales vecinas para poder hacer predicciones precisas sobre el habla prevista.

Después de crear el nuevo implante, Cogan y Viventi se asociaron con varios neurocirujanos del Hospital de la Universidad de Duke, incluidos Derek Southwell, MD, Ph.D., Nandan Lad, MD, Ph.D. y Allan Friedman, MD, quien ayudó a reclutar a cuatro pacientes para probar los implantes. El experimento requirió que los investigadores usaran temporalmente el dispositivo en pacientes sometidos a una cirugía cerebral por otra afección, como el tratamiento de la enfermedad de Parkinson o la extirpación de un tumor. El tiempo que tuvieron Cogan y su equipo para probar su dispositivo en el quirófano fue limitado.

«Me gusta compararlo con un equipo de boxes de NASCAR», dijo Cogan. “No queríamos perder más tiempo en el proceso operativo, así que teníamos que entrar y salir en 15 minutos. Tan pronto como el cirujano y el equipo médico dijeron “¡Vamos!” Inmediatamente entramos en acción y el paciente completó la tarea”.

La tarea consistió en una actividad sencilla de escucha y repetición. Los participantes escucharon una serie de palabras sin sentido, como “ava”, “kug” o “vip”, y luego las dijeron en voz alta. El dispositivo registró la actividad de la corteza motora del habla de cada paciente mientras coordinaban casi 100 músculos que mueven los labios, la lengua, la mandíbula y la laringe.

Luego, Suseendrakumar Duraivel, el primer autor del nuevo informe y estudiante de posgrado en ingeniería biomédica en Duke, tomó los datos neuronales y del habla del quirófano y los introdujo en un algoritmo de aprendizaje automático para ver con qué precisión podía predecir qué sonido emitiría. be se realizó basándose únicamente en registros de la actividad cerebral.

Para algunos sonidos y participantes, como /g/ en la palabra «gak», el decodificador acertó el 84% de las veces cuando era el primer sonido de una secuencia de tres que formaba una palabra sin sentido en particular.

Sin embargo, la precisión disminuyó a medida que el decodificador rechazaba los ruidos en medio o al final de una palabra sin sentido. También era difícil cuando dos sonidos eran similares, como /p/ y /b/.

En general, el decodificador fue preciso el 40% del tiempo. Puede parecer un resultado de prueba modesto, pero fue bastante impresionante considerando que proezas técnicas similares de convertir el cerebro en habla requieren horas o días de datos. Sin embargo, el algoritmo de decodificación de voz utilizado por Duraivel sólo funcionó con 90 segundos de datos hablados de la prueba de 15 minutos.

Duraivel y sus mentores esperan desarrollar una versión inalámbrica del dispositivo con una reciente subvención de 2,4 millones de dólares de los Institutos Nacionales de Salud.

«Ahora estamos desarrollando el mismo tipo de equipo de grabación, pero sin cables», dijo Cogan. «Podías moverte y no estar atado a una toma de corriente, lo cual es realmente emocionante».

Aunque su trabajo es alentador, todavía queda un largo camino por recorrer antes de que la prótesis del habla de Viventi y Cogan llegue pronto al mercado.

«Estamos en un punto en el que todavía es mucho más lento que el lenguaje natural», dijo Viventi, «pero se puede ver el camino por el cual potencialmente se puede llegar allí».

[ad_2]