[ad_1]

La inteligencia artificial (IA) es un campo en rápido desarrollo con el potencial de mejorar y transformar muchos aspectos de la sociedad. En 2023, el ritmo de adopción de la tecnología de IA se ha acelerado aún más con el desarrollo de potentes modelos base (FM) y el consiguiente avance de las capacidades de IA generativa.

En Amazon, hemos lanzado varios servicios de IA generativa, como Amazon Bedrock y Amazon CodeWhisperer, y hemos puesto a disposición una serie de modelos generativos de alto rendimiento a través de Amazon SageMaker JumpStart. Estos servicios están diseñados para ayudar a nuestros clientes a desbloquear las nuevas posibilidades de la IA generativa, incluida la creatividad mejorada, la creación de contenido dinámico y personalizado y el diseño innovador. También pueden permitir que los profesionales de la IA comprendan el mundo como nunca antes: abordando las barreras del idioma, el cambio climático, acelerando los descubrimientos científicos y más.

Sin embargo, para aprovechar todo el potencial de la IA generativa, es importante considerar cuidadosamente los posibles riesgos. Esto beneficia principalmente a las partes interesadas del sistema de IA al fomentar el desarrollo y la implementación responsables y seguros y fomentar la adopción de medidas proactivas para abordar los posibles impactos. En consecuencia, establecer mecanismos de evaluación y gestión de riesgos es un proceso importante que deben considerar los profesionales de la IA y se ha convertido en una parte central de muchos nuevos estándares de la industria de la IA (por ejemplo, ISO 42001, ISO 23894 y NIST RMF) y legislación (por ejemplo, B. la UE). se ha convertido en ley de IA).

En esta publicación, analizamos cómo evaluar el riesgo potencial de su sistema de inteligencia artificial.

¿Qué diferentes niveles de riesgo existen?

Si bien puede ser más fácil considerar un único modelo de aprendizaje automático (ML) y sus riesgos asociados de forma aislada, es importante considerar los detalles de la aplicación específica de dicho modelo y el caso de uso correspondiente como parte de un sistema de IA completo. De hecho, es probable que un sistema de IA típico se base en varios modelos de ML diferentes que funcionan juntos, y es posible que una organización desee construir varios sistemas de IA diferentes. En consecuencia, los riesgos se pueden evaluar para cada caso de uso y en diferentes niveles, a saber, riesgo de modelo, riesgo del sistema de IA y riesgo empresarial.

El riesgo empresarial abarca la amplia gama de riesgos que una organización puede enfrentar, incluidos los riesgos financieros, operativos y estratégicos. El riesgo del sistema de IA se centra en los impactos asociados con la implementación y operación de los sistemas de IA, mientras que el riesgo del modelo de ML se refiere específicamente a las vulnerabilidades e incertidumbres inherentes a los modelos de ML.

En esta publicación, nos centramos principalmente en el riesgo del sistema de IA. Sin embargo, es importante señalar que se deben considerar y alinear todos los diferentes niveles de gestión de riesgos dentro de una organización.

¿Cómo se define el riesgo del sistema de IA?

La gestión de riesgos en el contexto de un sistema de IA puede ser una forma de minimizar el impacto de la incertidumbre o los posibles impactos negativos, al tiempo que brinda oportunidades para maximizar los impactos positivos. El riesgo en sí no es un daño potencial, sino el impacto de la incertidumbre en los objetivos. Según el Marco de Gestión de Riesgos del NIST (NIST RMF), el riesgo se puede estimar como una medida multiplicativa de la probabilidad de que ocurra un evento, medida por la magnitud de las consecuencias del evento correspondiente.

Hay dos aspectos del riesgo: riesgo inherente y riesgo residual. El riesgo inherente representa el nivel de riesgo que presenta el sistema de IA sin mitigaciones ni controles. El riesgo residual captura los riesgos restantes después de que se han tenido en cuenta las estrategias de mitigación.

Recuerde siempre que la evaluación de riesgos es una actividad centrada en el ser humano que requiere un esfuerzo de toda la organización. Estos esfuerzos van desde garantizar que todas las partes interesadas relevantes estén incluidas en el proceso de evaluación (por ejemplo, equipos de productos, ingeniería, ciencia, ventas y seguridad) hasta evaluar cómo las perspectivas y normas sociales influyen en la probabilidad percibida e influyen en las consecuencias de ciertos eventos.

¿Por qué su organización debería preocuparse por la evaluación de riesgos?

El establecimiento de marcos de gestión de riesgos para los sistemas de IA puede beneficiar a la sociedad en su conjunto al promover el diseño, desarrollo y operación seguros y responsables de los sistemas de IA. Los marcos de gestión de riesgos también pueden beneficiar a las organizaciones a través de:

- Toma de decisiones mejorada – Al comprender los riesgos asociados con los sistemas de IA, las empresas pueden tomar mejores decisiones sobre cómo mitigar estos riesgos y utilizar los sistemas de IA de manera segura y responsable.

- Mayor planificación de cumplimiento – Un marco de evaluación de riesgos puede ayudar a las organizaciones a prepararse para los requisitos de evaluación de riesgos establecidos en las leyes y regulaciones pertinentes.

- generar confianza – Al demostrar que están tomando medidas para mitigar los riesgos de los sistemas de IA, las empresas pueden mostrar a sus clientes y partes interesadas que están comprometidas con el uso seguro y responsable de la IA.

¿Cómo se evalúa el riesgo?

Como primer paso, una organización debería considerar describir el caso de uso de IA que se evaluará e identificar a todas las partes interesadas relevantes. Un caso de uso es un escenario o situación específica que describe cómo los usuarios interactúan con un sistema de IA para lograr un objetivo específico. Al crear una descripción de caso de uso, puede resultar útil especificar el problema empresarial que se está resolviendo, enumerar las partes interesadas involucradas, caracterizar el flujo de trabajo y proporcionar detalles sobre las entradas y salidas clave del sistema.

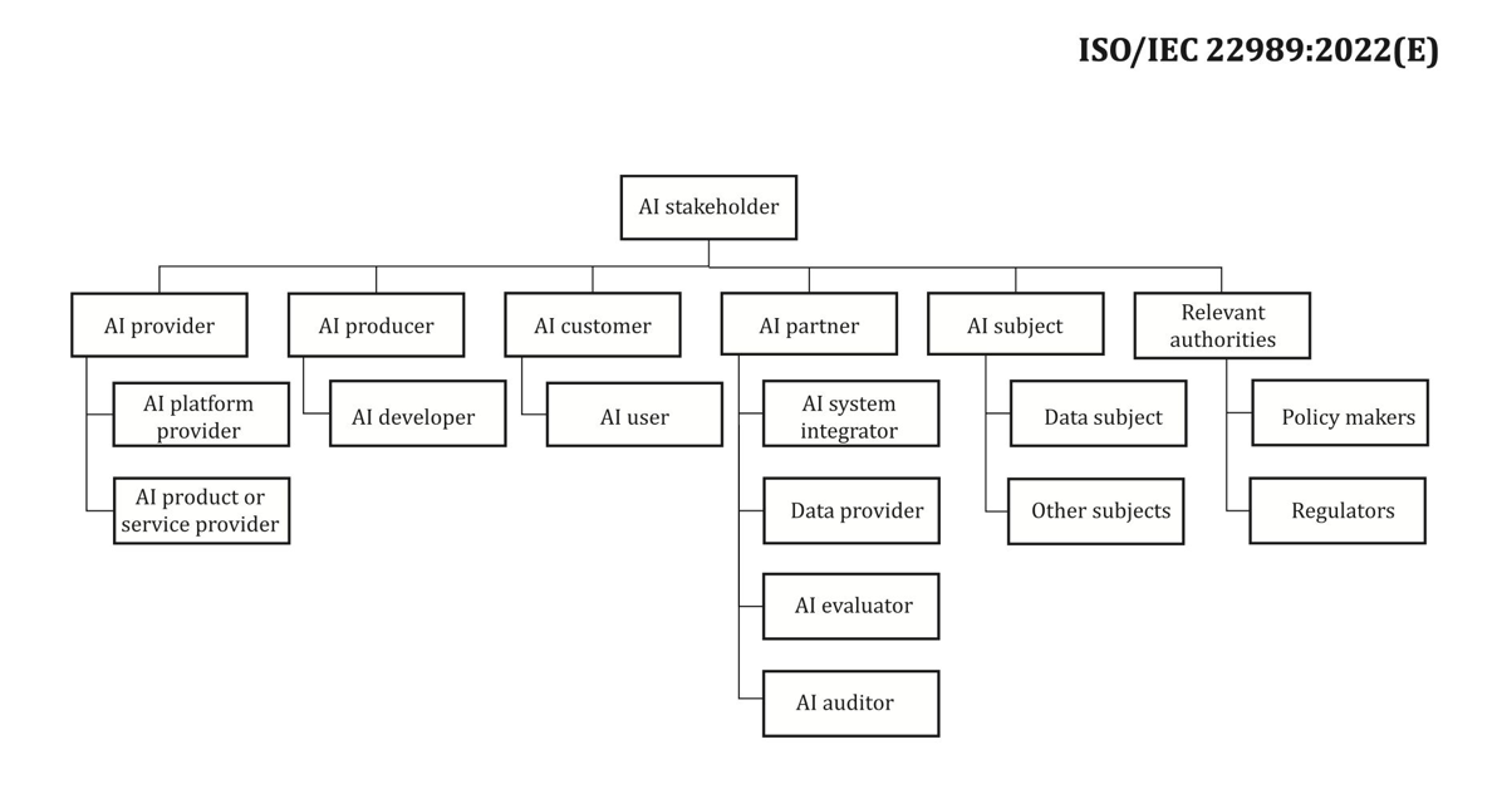

Cuando se trata de partes interesadas, es fácil pasar por alto algunas. La siguiente figura es un buen punto de partida para mapear los roles de las partes interesadas en la IA.

Fuente: “Tecnologías de la Información – Inteligencia Artificial – Conceptos y Terminología de Inteligencia Artificial”.

Un siguiente paso importante en la evaluación de riesgos del sistema de IA es identificar eventos potencialmente dañinos relacionados con el caso de uso. Al considerar estos eventos, puede resultar útil pensar en diferentes dimensiones de la IA responsable, como la equidad y la solidez. Diferentes partes interesadas pueden verse afectadas en diferentes grados y en diferentes dimensiones. Por ejemplo, un riesgo de robustez bajo para un usuario final podría deberse a que un sistema de IA tenga fallas menores, mientras que un riesgo de equidad bajo podría deberse a que un sistema de IA produzca resultados insignificantemente diferentes para diferentes grupos demográficos.

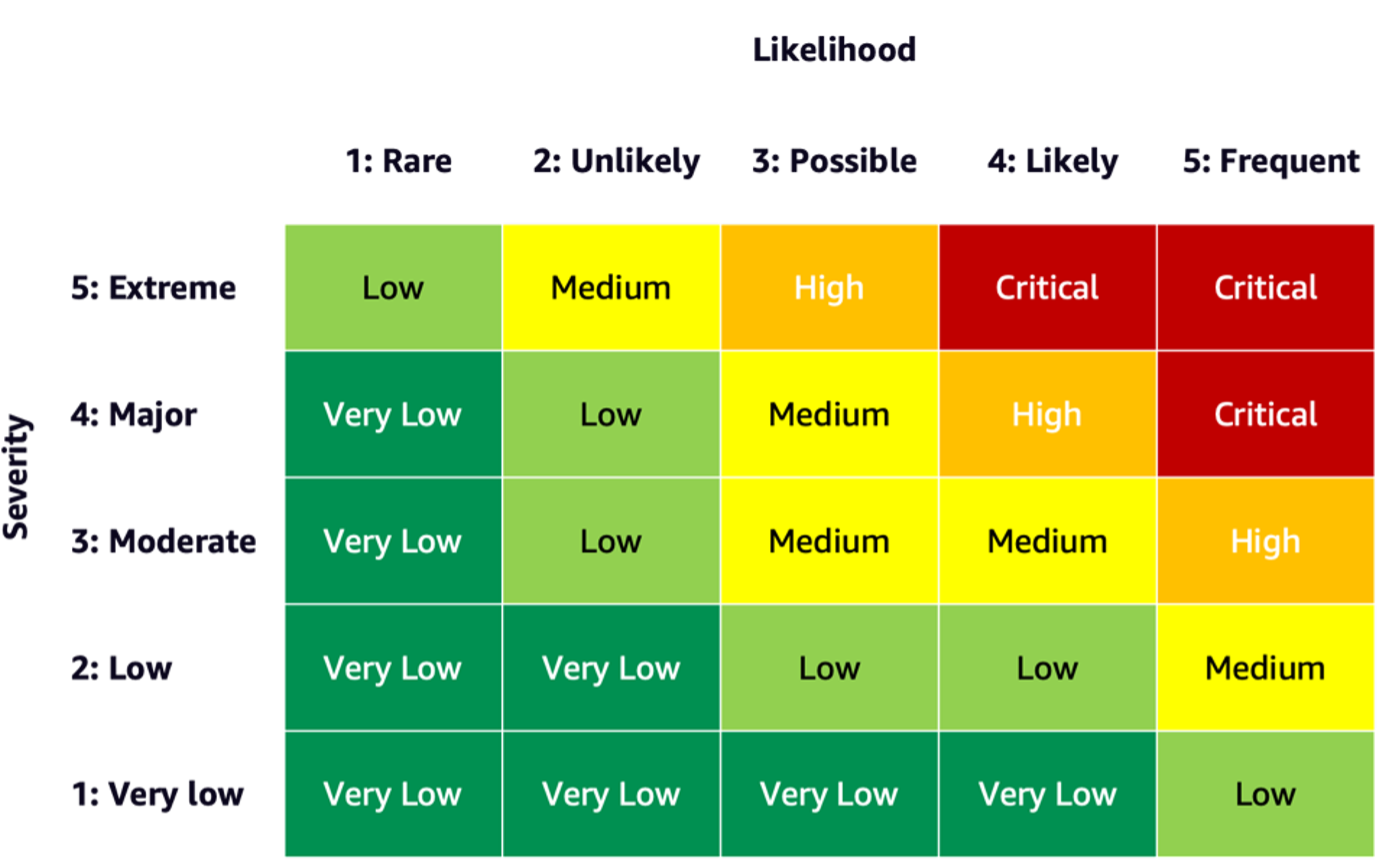

Para estimar el riesgo de un evento, se puede utilizar una escala de probabilidad en combinación con una escala de gravedad para medir la probabilidad de que ocurra y el grado de consecuencias. Un punto de partida útil para desarrollar estas escalas podría ser el NIST RMF, que sugiere el uso de categorías cualitativas no numéricas desde muy bajo a muy alto riesgo o principios de puntuación semicuantitativos como escalas (por ejemplo, 1 a 10), contenedores o otros números representativos. Una vez que haya definido las escalas de probabilidad y gravedad para todas las dimensiones relevantes, puede utilizar un esquema de matriz de riesgo para cuantificar el riesgo general por parte interesada a lo largo de cada dimensión relevante. La siguiente figura muestra un ejemplo de matriz de riesgos.

Usando esta matriz de riesgo, podemos considerar un evento con baja gravedad y una rara probabilidad de ocurrencia como un riesgo muy bajo. Recuerde que la evaluación inicial es una evaluación del riesgo inherente y las estrategias de mitigación del riesgo pueden ayudar a reducir aún más el nivel de riesgo. Luego, el proceso se puede repetir para crear una evaluación del riesgo restante por evento. Cuando se identifican varios eventos en la misma dimensión, puede resultar útil seleccionar el nivel de riesgo más alto entre todos para crear un resumen de evaluación final.

Utilizando el resumen de evaluación final, las organizaciones deben definir qué niveles de riesgo son aceptables para sus sistemas de IA y considerar las regulaciones y políticas relevantes.

Compromiso de AWS

A través de nuestro trabajo con la Casa Blanca y las Naciones Unidas, entre otros, nos comprometemos a compartir nuestro conocimiento y experiencia para promover el uso responsable y seguro de la IA. Con eso en mente, Adam Selipsky de Amazon representó recientemente a AWS en la Cumbre de Seguridad de IA en presencia de jefes de estado y líderes de la industria, demostrando una vez más nuestro compromiso de trabajar juntos para avanzar de manera responsable en la inteligencia artificial.

Diploma

A medida que la IA siga avanzando, la evaluación de riesgos será cada vez más importante y útil para las empresas que quieran construir e implementar IA de manera responsable. Al establecer un marco de evaluación de riesgos y un plan de mitigación, las empresas pueden reducir el riesgo de posibles incidentes relacionados con la IA y ganarse la confianza de sus clientes, además de obtener beneficios como una mayor confiabilidad, una mayor equidad entre poblaciones diversas y más.

Comience a desarrollar un marco de evaluación de riesgos en su organización y comparta sus opiniones en los comentarios.

Consulte también una descripción general de los riesgos de la IA generativa publicada en Amazon Science: Responsible AI in the generative era y explore la gama de servicios de AWS que pueden respaldar su evaluación y mitigación de riesgos: Amazon SageMaker Clarify, Amazon SageMaker Model Monitor, AWS CloudTrail y el modelo. marco de gobernanza.

Sobre los autores

Mia Mayer es científico aplicado e instructor de ML en AWS Machine Learning University; donde investiga y enseña seguridad, explicabilidad y equidad del aprendizaje automático y los sistemas de inteligencia artificial. A lo largo de su carrera, Mia estableció varios programas de extensión universitaria, se desempeñó como conferenciante invitada y oradora principal y presentó en numerosas conferencias de aprendizaje importantes. También ayuda a los equipos internos y a los clientes de AWS a comenzar su viaje hacia la IA responsable.

Mia Mayer es científico aplicado e instructor de ML en AWS Machine Learning University; donde investiga y enseña seguridad, explicabilidad y equidad del aprendizaje automático y los sistemas de inteligencia artificial. A lo largo de su carrera, Mia estableció varios programas de extensión universitaria, se desempeñó como conferenciante invitada y oradora principal y presentó en numerosas conferencias de aprendizaje importantes. También ayuda a los equipos internos y a los clientes de AWS a comenzar su viaje hacia la IA responsable.

Denis V. Batalov Denis es un veterano de 17 años en Amazon y tiene un doctorado en aprendizaje automático. Denis ha trabajado en proyectos tan interesantes como Search Inside the Book, aplicaciones móviles de Amazon y Kindle Direct Publishing. Desde 2013, ha ayudado a los clientes de AWS a introducir la tecnología AI/ML como arquitecto de soluciones. Actualmente, Denis es un líder tecnológico global en AI/ML y es responsable del funcionamiento de los arquitectos de soluciones especialistas en ML de AWS en todo el mundo. Denis es un orador frecuente, puedes seguirlo en Twitter @dbatalov.

Denis V. Batalov Denis es un veterano de 17 años en Amazon y tiene un doctorado en aprendizaje automático. Denis ha trabajado en proyectos tan interesantes como Search Inside the Book, aplicaciones móviles de Amazon y Kindle Direct Publishing. Desde 2013, ha ayudado a los clientes de AWS a introducir la tecnología AI/ML como arquitecto de soluciones. Actualmente, Denis es un líder tecnológico global en AI/ML y es responsable del funcionamiento de los arquitectos de soluciones especialistas en ML de AWS en todo el mundo. Denis es un orador frecuente, puedes seguirlo en Twitter @dbatalov.

Dr. Sara Liu es gerente sénior de programas técnicos en el equipo de IA responsable de AWS. Trabaja con un equipo de científicos, líderes de conjuntos de datos, ingenieros de aprendizaje automático, investigadores y otros equipos multifuncionales para elevar el nivel de la IA responsable en todos los servicios de IA de AWS. Sus proyectos actuales incluyen el desarrollo de mapas de servicios de IA, la realización de evaluaciones de riesgos para una IA responsable, la creación de conjuntos de datos de evaluación de alta calidad y la implementación de programas de calidad. También ayuda a los equipos internos y a los clientes a cumplir con los estándares cambiantes de la industria de la IA.

Dr. Sara Liu es gerente sénior de programas técnicos en el equipo de IA responsable de AWS. Trabaja con un equipo de científicos, líderes de conjuntos de datos, ingenieros de aprendizaje automático, investigadores y otros equipos multifuncionales para elevar el nivel de la IA responsable en todos los servicios de IA de AWS. Sus proyectos actuales incluyen el desarrollo de mapas de servicios de IA, la realización de evaluaciones de riesgos para una IA responsable, la creación de conjuntos de datos de evaluación de alta calidad y la implementación de programas de calidad. También ayuda a los equipos internos y a los clientes a cumplir con los estándares cambiantes de la industria de la IA.

[ad_2]