[ad_1]

En esta publicación, analizamos las prácticas recomendadas para mejorar el rendimiento de sus modelos de visión artificial mediante el uso de etiquetas personalizadas de Amazon Rekognition. Rekognition Custom Labels es un servicio completamente administrado para crear modelos de visión por computadora personalizados para casos de uso de clasificación de imágenes y reconocimiento de objetos. Las etiquetas personalizadas de Rekognition se basan en los modelos previamente entrenados en Amazon Rekognition, que ya se han entrenado en decenas de millones de imágenes en muchas categorías. En lugar de miles de imágenes, puede comenzar con un pequeño conjunto de imágenes de entrenamiento (algunos cientos o menos) específicas para su caso de uso. Las etiquetas personalizadas de Rekognition abstraen la complejidad asociada con la creación de un modelo personalizado. Examina automáticamente los datos de entrenamiento, elige los algoritmos de ML correctos, elige el tipo de instancia, entrena múltiples modelos candidatos con diferentes configuraciones de hiperparámetros y genera el modelo mejor entrenado. Las etiquetas personalizadas de Rekognition también proporcionan una interfaz fácil de usar desde la Consola de administración de AWS para administrar todo el flujo de trabajo de ML, incluido el etiquetado de imágenes, el entrenamiento del modelo, la implementación del modelo y la visualización de los resultados de las pruebas.

Hay momentos en que la precisión de un modelo no es la mejor y no tiene muchas opciones para ajustar los parámetros de configuración del modelo. Detrás de escena, varios factores juegan un papel clave en la creación de un modelo poderoso, tales como: B. lo siguiente:

- Punto de vista

- resolución de imagen

- relación de aspecto

- exposición

- Claridad y vitalidad del fondo.

- contraste de color

- tamaño de datos de muestra

Los siguientes son los pasos generales a seguir para entrenar un modelo de etiquetas personalizadas Rekognition de calidad de producción:

- Consulta la taxonomía – Esto define la lista de atributos/elementos que desea identificar en una imagen.

- Reúne datos relevantes – Este es el paso más importante en el que necesita recopilar imágenes relevantes que deberían parecerse a lo que vería en un entorno de producción. Estas pueden ser imágenes de objetos con diferentes fondos, iluminación o ángulos de cámara. A continuación, crea conjuntos de datos de prueba y entrenamiento dividiendo las imágenes recopiladas. Solo debe incluir imágenes reales como parte del conjunto de datos de prueba y no imágenes generadas sintéticamente. Las anotaciones en los datos que recopila son fundamentales para el rendimiento del modelo. Asegúrese de que los cuadros delimitadores estén ajustados alrededor de los objetos y que las etiquetas sean correctas. Discutimos algunos consejos a tener en cuenta al crear un conjunto de datos adecuado más adelante en esta publicación.

- Consulta las métricas de entrenamiento – Utilice los conjuntos de datos anteriores para entrenar un modelo y revisar las métricas de entrenamiento para la puntuación, precisión y recuperación de F1. Más adelante en esta publicación entraremos en detalles sobre cómo analizar las métricas de entrenamiento.

- Evaluar el modelo entrenado – Utilice un conjunto de imágenes invisibles (no utilizadas para entrenar el modelo) con etiquetas conocidas para puntuar las predicciones. Este paso siempre debe realizarse para garantizar que el modelo funcione como se espera en un entorno de producción.

- reentrenamiento (opcional) – En general, entrenar un modelo de aprendizaje automático es un proceso iterativo para lograr los resultados deseados, un modelo de visión artificial no es diferente. Revise los resultados en el paso 4 para ver si es necesario agregar más imágenes a los datos de entrenamiento y repita los pasos 3 a 5 anteriores.

En esta publicación, nos centraremos en las mejores prácticas para recopilar datos relevantes (paso 2) y evaluar sus métricas entrenadas (paso 3) para mejorar el rendimiento de su modelo.

Reúne datos relevantes

Esta es la fase más crítica en el entrenamiento de un modelo de etiquetas personalizadas de Rekognition listo para la producción. Específicamente, hay dos conjuntos de datos: entrenamiento y prueba. Los datos de entrenamiento se utilizan para entrenar el modelo y debe tomarse la molestia de crear un conjunto de entrenamiento adecuado. Los modelos de etiquetas personalizadas de Rekognition están optimizados para la puntuación F1 en el conjunto de datos de prueba para seleccionar el modelo más preciso para su proyecto. Por lo tanto, es importante seleccionar un conjunto de datos de prueba que se asemeje al mundo real.

número de imágenes

Recomendamos al menos 15-20 imágenes por etiqueta. Tener más imágenes con más variaciones que reflejen su caso de uso mejora el rendimiento del modelo.

Conjunto de datos equilibrado

Idealmente, cada etiqueta en el conjunto de datos debería tener un número similar de muestras. No debería haber mucha diferencia en el número de imágenes por etiqueta. Por ejemplo, un conjunto de datos en el que la mayor cantidad de imágenes para una etiqueta es 1000 frente a 50 imágenes para otra etiqueta se parece a un conjunto de datos desequilibrado. Recomendamos evitar escenarios con una relación unilateral de 1:50 entre la etiqueta con la menor cantidad de imágenes y la etiqueta con la mayor cantidad de imágenes.

Diferentes tipos de imágenes

Incluya imágenes en el conjunto de datos de entrenamiento y prueba que sean similares a las que usará en el mundo real. Por ejemplo, si desea clasificar imágenes de salas de estar y dormitorios, debe incluir imágenes vacías y amuebladas de ambas habitaciones.

La siguiente es una imagen de ejemplo de una sala de estar amueblada.

Por el contrario, el siguiente es un ejemplo de una sala de estar sin amueblar.

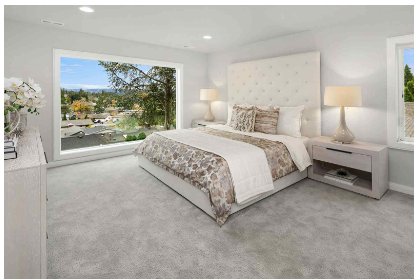

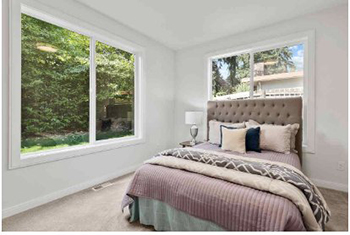

La siguiente es una imagen de ejemplo de un dormitorio amueblado.

La siguiente es una imagen de ejemplo de un dormitorio sin amueblar.

Diferentes antecedentes

Añade imágenes con diferentes fondos. Las imágenes con contexto natural pueden dar mejores resultados que un fondo simple.

La siguiente es una imagen de muestra del patio delantero de una casa.

La siguiente es una imagen de ejemplo del patio delantero de otra casa con un fondo diferente.

Diferentes condiciones de iluminación.

Agregue imágenes con diferente iluminación para cubrir las diferentes condiciones de iluminación encontradas durante la inferencia (por ejemplo, con y sin flash). También puede insertar imágenes con diferente saturación, tono y brillo.

La siguiente es una imagen de ejemplo de una flor bajo luz normal.

En contraste, la imagen de abajo muestra la misma flor bajo una luz brillante.

Diferentes ángulos

Agregue imágenes tomadas desde diferentes ángulos del objeto. Esto ayuda al modelo a aprender diferentes propiedades de los objetos.

Las siguientes imágenes muestran el mismo dormitorio desde diferentes ángulos.

|

|

Puede haber situaciones en las que no sea posible capturar imágenes de diferentes tipos. En estos escenarios, se pueden generar imágenes sintéticas como parte del conjunto de datos de entrenamiento. Consulte Aumento de datos para obtener más información sobre técnicas comunes de mejora de imágenes.

Agregar etiquetas negativas

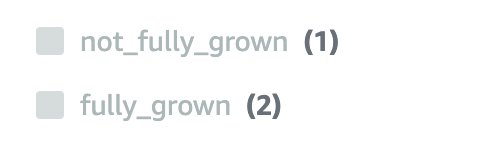

Al clasificar imágenes, agregar etiquetas negativas puede ayudar a aumentar la precisión del modelo. Por ejemplo, puede agregar una etiqueta negativa que no coincida con ninguna de las etiquetas requeridas. La siguiente imagen muestra las diferentes etiquetas que se utilizan para identificar las flores completamente desarrolladas.

Agregar la etiqueta negativa not_fully_grown ayuda al modelo a aprender características que no son parte de fully_grown Etiqueta.

Lidiando con la confusión de etiquetas

Analice los resultados en el conjunto de datos de prueba para identificar patrones que faltan en el conjunto de datos de entrenamiento o prueba. A veces es fácil detectar esos patrones examinando las imágenes visualmente. En la imagen a continuación, el modelo está luchando por decidir entre una etiqueta de patio trasero y una etiqueta de patio.

En este escenario, agregar más imágenes a estas etiquetas en el conjunto de datos y también redefinir las etiquetas para que cada etiqueta sea diferente puede ayudar a aumentar la precisión del modelo.

extensión de datos

Dentro de las etiquetas personalizadas de Rekognition, realizamos varias mejoras de datos para el entrenamiento de modelos, incluido el recorte aleatorio de imágenes, el tramado de color, el ruido gaussiano aleatorio y más. Según sus casos de uso específicos, también puede ser beneficioso agregar extensiones de datos más explícitas a sus datos de entrenamiento. Por ejemplo, si está interesado en detectar animales en imágenes en color y en blanco y negro, puede lograr una mayor precisión agregando versiones en blanco y negro y en color de las mismas imágenes a los datos de entrenamiento.

No recomendamos extensiones para datos de prueba a menos que las extensiones reflejen sus casos de uso de producción.

Consulta las métricas de entrenamiento

La puntuación F1, la precisión, la recuperación y el umbral aceptado son las métricas generadas como resultado del entrenamiento de un modelo con etiquetas personalizadas de Rekognition. Los modelos están optimizados para obtener la mejor puntuación de F1 según el conjunto de datos de prueba proporcionado. El umbral supuesto también se genera en función del conjunto de datos de prueba. Puede personalizar el umbral en función de las necesidades empresariales de precisión o recuperación.

Dado que los umbrales asumidos se establecen para el conjunto de datos de prueba, un conjunto de prueba adecuado debe reflejar el caso de uso de producción real. Si el conjunto de datos de prueba no es representativo del caso de uso, es posible que vea valores F1 artificialmente altos y un rendimiento deficiente del modelo en sus imágenes reales.

Estas métricas son útiles cuando se realiza una evaluación inicial del modelo. Para un sistema listo para producción, recomendamos evaluar el modelo con un conjunto de datos externo (500-1000 imágenes invisibles) que sea representativo del mundo real. Esto ayuda a evaluar cómo se desempeñaría el modelo en un sistema de producción e identifica los patrones que faltan y los corrige volviendo a entrenar el modelo. Si encuentra una discrepancia entre los resultados de F1 y la evaluación externa, le recomendamos verificar que los datos de su prueba reflejen el caso de uso real.

Conclusión

En esta publicación, lo guiamos a través de las mejores prácticas para mejorar los modelos de etiquetas personalizadas de Rekognition. Le recomendamos que obtenga más información sobre las etiquetas personalizadas de Rekognition y que las pruebe para los registros específicos de su empresa.

Sobre los autores

Amit Gupta es arquitecto sénior de soluciones de servicios de IA en AWS. Le apasiona ayudar a los clientes con soluciones de aprendizaje automático bien diseñadas a escala.

Amit Gupta es arquitecto sénior de soluciones de servicios de IA en AWS. Le apasiona ayudar a los clientes con soluciones de aprendizaje automático bien diseñadas a escala.

Yogesh Chaturvedi es un arquitecto de soluciones en AWS con un enfoque en visión artificial. Trabaja con los clientes para abordar sus desafíos comerciales utilizando tecnologías en la nube. Fuera del trabajo, le gusta caminar, viajar y ver deportes.

Yogesh Chaturvedi es un arquitecto de soluciones en AWS con un enfoque en visión artificial. Trabaja con los clientes para abordar sus desafíos comerciales utilizando tecnologías en la nube. Fuera del trabajo, le gusta caminar, viajar y ver deportes.

hola yang es científico aplicado sénior en el equipo de etiquetas personalizadas de Amazon Rekognition. Sus principales intereses de investigación son el reconocimiento de objetos y el aprendizaje con anotaciones limitadas. Fuera del trabajo, a Hao le gusta ver películas, tomar fotografías y realizar actividades al aire libre.

hola yang es científico aplicado sénior en el equipo de etiquetas personalizadas de Amazon Rekognition. Sus principales intereses de investigación son el reconocimiento de objetos y el aprendizaje con anotaciones limitadas. Fuera del trabajo, a Hao le gusta ver películas, tomar fotografías y realizar actividades al aire libre.

misterio pashmeen es gerente sénior de productos para etiquetas personalizadas de Amazon Rekognition. Fuera del trabajo, Pashmeen disfruta de caminatas aventureras, fotografía y pasar tiempo con su familia.

misterio pashmeen es gerente sénior de productos para etiquetas personalizadas de Amazon Rekognition. Fuera del trabajo, Pashmeen disfruta de caminatas aventureras, fotografía y pasar tiempo con su familia.

[ad_2]